《爬虫》专题

-

用爬虫找出哪个div包含“主要内容”

所以...我们如何确定哪个是页面的“主div”? 我很确定谷歌会这么做。他们肯定知道元素在页面上的位置,例如,如果某些东西位于“主要内容”或页脚中。他们怎么会知道这些? 我可以看到的在大范围内做到这一点的方法是: 编辑:我想一种渲染它的方法是不渲染每一个单独的页面。而是呈现域。例如。如果域结构是http://example.com/post/1-post-name/,我可以保存它的一个呈现,下次我

-

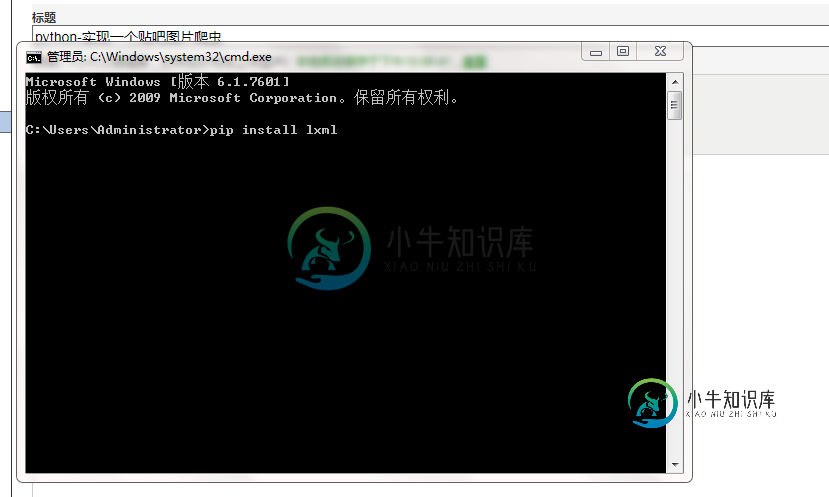

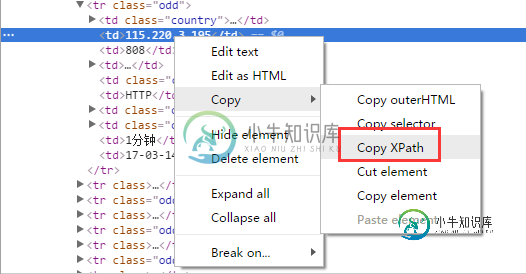

python 实现一个贴吧图片爬虫的示例

python 实现一个贴吧图片爬虫的示例本文向大家介绍python 实现一个贴吧图片爬虫的示例,包括了python 实现一个贴吧图片爬虫的示例的使用技巧和注意事项,需要的朋友参考一下 今天没事回家写了个贴吧图片下载程序,工具用的是PyCharm,这个工具很实用,开始用的Eclipse,但是再使用类库或者其它方便并不实用,所以最后下了个专业开发python程序的工具,开发环境是Python2,因为大学时自学的是python2 第一步:就是

-

python爬虫实现教程转换成 PDF 电子书

python爬虫实现教程转换成 PDF 电子书本文向大家介绍python爬虫实现教程转换成 PDF 电子书,包括了python爬虫实现教程转换成 PDF 电子书的使用技巧和注意事项,需要的朋友参考一下 写爬虫似乎没有比用 Python 更合适了,Python 社区提供的爬虫工具多得让你眼花缭乱,各种拿来就可以直接用的 library 分分钟就可以写出一个爬虫出来,今天就琢磨着写一个爬虫,将廖雪峰的 Python 教程 爬下来做成 PDF 电子

-

python并发爬虫实用工具tomorrow实用解析

本文向大家介绍python并发爬虫实用工具tomorrow实用解析,包括了python并发爬虫实用工具tomorrow实用解析的使用技巧和注意事项,需要的朋友参考一下 tomorrow是我最近在用的一个爬虫利器,该模块属于第三方的一个模块,使用起来非常的方便,只需要用其中的threads方法作为装饰器去修饰一个普通的函数,既可以达到并发的效果,本篇将用实例来展示tomorrow的强大之处。后面将对

-

如何优雅地使用c语言编写爬虫

本文向大家介绍如何优雅地使用c语言编写爬虫,包括了如何优雅地使用c语言编写爬虫的使用技巧和注意事项,需要的朋友参考一下 大家在平时或多或少地都会有编写网络爬虫的需求。一般来说,编写爬虫的首选自然非python莫属,除此之外,java等语言也是不错的选择。选择上述语言的原因不仅仅在于它们均有非常不错的网络请求库和字符串处理库,还在于基于上述语言的爬虫框架非常之多和完善。良好的爬虫框架可以确保爬虫程序

-

python3 Scrapy爬虫框架ip代理配置的方法

python3 Scrapy爬虫框架ip代理配置的方法本文向大家介绍python3 Scrapy爬虫框架ip代理配置的方法,包括了python3 Scrapy爬虫框架ip代理配置的方法的使用技巧和注意事项,需要的朋友参考一下 什么是Scrapy? Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架,非常出名,非常强悍。所谓的框架就是一个已经被集成了各种功能(高性能异步下载,队列,分布式,解析,持久化等)的具有很强通用性的项目模板。

-

Python爬虫之Selenium设置元素等待的方法

本文向大家介绍Python爬虫之Selenium设置元素等待的方法,包括了Python爬虫之Selenium设置元素等待的方法的使用技巧和注意事项,需要的朋友参考一下 一、显式等待 WebDriverWait类是由WebDirver 提供的等待方法。在设置时间内,默认每隔一段时间检测一次当前页面元素是否存在,如果超过设置时间检测不到则抛出异常(TimeoutException) 语法: WebDr

-

从零学习node.js之简易的网络爬虫(四)

本文向大家介绍从零学习node.js之简易的网络爬虫(四),包括了从零学习node.js之简易的网络爬虫(四)的使用技巧和注意事项,需要的朋友参考一下 前言 之前已经介绍了node.js的一些基本知识,下面这篇文章我们的目标是学习完本节课程后,能进行网页简单的分析与抓取,对抓取到的信息进行输出和文本保存。 爬虫的思路很简单: 确定要抓取的URL; 对URL进行抓取,获取网页内容; 对内容进行分析并

-

Java爬虫Jsoup+httpclient获取动态生成的数据

Java爬虫Jsoup+httpclient获取动态生成的数据本文向大家介绍Java爬虫Jsoup+httpclient获取动态生成的数据,包括了Java爬虫Jsoup+httpclient获取动态生成的数据的使用技巧和注意事项,需要的朋友参考一下 Java爬虫Jsoup+httpclient获取动态生成的数据 前面我们详细讲了一下Jsoup发现这玩意其实也就那样,只要是可以访问到的静态资源页面都可以直接用他来获取你所需要的数据,详情情跳转-Jsoup爬虫详

-

Python实现的异步代理爬虫及代理池

Python实现的异步代理爬虫及代理池本文向大家介绍Python实现的异步代理爬虫及代理池,包括了Python实现的异步代理爬虫及代理池的使用技巧和注意事项,需要的朋友参考一下 使用python asyncio实现了一个异步代理池,根据规则爬取代理网站上的免费代理,在验证其有效后存入redis中,定期扩展代理的数量并检验池中代理的有效性,移除失效的代理。同时用aiohttp实现了一个server,其他的程序可以通过访问相应的url来从

-

Python使用requests及BeautifulSoup构建爬虫实例代码

Python使用requests及BeautifulSoup构建爬虫实例代码本文向大家介绍Python使用requests及BeautifulSoup构建爬虫实例代码,包括了Python使用requests及BeautifulSoup构建爬虫实例代码的使用技巧和注意事项,需要的朋友参考一下 本文研究的主要是Python使用requests及BeautifulSoup构建一个网络爬虫,具体步骤如下。 功能说明 在Python下面可使用requests模块请求某个url获取响

-

python爬虫 模拟登录人人网过程解析

本文向大家介绍python爬虫 模拟登录人人网过程解析,包括了python爬虫 模拟登录人人网过程解析的使用技巧和注意事项,需要的朋友参考一下 requests 提供了一个叫做session类,来实现客户端和服务端的会话保持 使用方法 1.实例化一个session对象 2.让session发送get或者post请求 下面就用人人网来实战一下 就这么简单,模拟登录上人人网并且获取了个人首页信息页面保

-

Python爬虫 bilibili视频弹幕提取过程详解

Python爬虫 bilibili视频弹幕提取过程详解本文向大家介绍Python爬虫 bilibili视频弹幕提取过程详解,包括了Python爬虫 bilibili视频弹幕提取过程详解的使用技巧和注意事项,需要的朋友参考一下 两个重要点 1.获取弹幕的url是以 .xml 结尾 2.弹幕url的所需参数在视频url响应的 javascript 中 先看代码 先找到弹幕的url,以.xml结尾,所以先找到这串数字所在的位置,并获取这串数字发起第二次请求

-

Python 正则表达式爬虫使用案例解析

本文向大家介绍Python 正则表达式爬虫使用案例解析,包括了Python 正则表达式爬虫使用案例解析的使用技巧和注意事项,需要的朋友参考一下 现在拥有了正则表达式这把神兵利器,我们就可以进行对爬取到的全部网页源代码进行筛选了。 下面我们一起尝试一下爬取内涵段子网站: http://www.neihan8.com/article/list_5_1.html 打开之后,不难看出里面一个一个非常有内涵

-

PythonValueError:太多的值无法为爬虫程序解包

我试图运行我在网上找到的刮板,但收到一个ValueError:太多的值在这行代码上解包 这条线是这个函数的一部分 如果您有任何意见,我们将不胜感激,谢谢。