《花旗银行》专题

-

大写SQL语句在雪花存储过程中不起作用

在下面的示例中,存储过程工作,而不工作。两者之间唯一的区别是SQL语句的字母大小写。

-

火花误差-十进制精度39超过最大精度38

当我试图从Spark dataframe收集数据时,我得到一个错误,说明 下面是StackTrace: 警告tasksetmanager:在stage 0.0中丢失任务1.0(TID 1,10..***,executor 0):java.lang.IllegalArgumentException:requirement:Decimal precision 39在scala.predef超过最大精度

-

Antlr 4解析大型c文件需要花费很长时间

我有一个很大的C代码文件(>9000 LoC),并尝试使用以下语法对其进行解析: 感谢任何帮助;)

-

火花纱-集群模式-读取文件与--files一起传递

我正在使用yarn-cluster Master运行我的spark应用程序。 应用程序是做什么的? 外部服务根据对RESTService的HTTP请求生成jsonFile Spark需要在解析JSON后读取该文件并执行一些工作 我认为将文件作为--files传递会让我忘记保存和删除这个文件。类似于通过-过程-忘记。 那么,如何读取通过-files传递的文件呢?唯一的解决方案是手工创建路径,硬编码“

-

当响应延迟时,Cxf 客户端花费的时间太长

我将cxf库用于web服务客户端。 当响应延迟了大约5秒时,cxf需要大约20秒来返回响应。ws返回33912长响应。 不过,客户对快速响应没有问题。 我找不到问题所在。我测试了wsendpoint,它在8秒内返回最大值。但cxf客户端有时需要30-50秒。 我打开了调试日志,这两行之间需要9秒 2018-01-11 17:17:14.022调试10492--[nio-8086-exec-6]o.

-

如何记录Spring Boot中Rest web服务所花费的时间?

我正在使用Spring Boot编写一个web Rest web服务。

-

底层的雪花驱动程序在这里共享连接吗?

使用此代码: 连接是池连接吗?我使用的是基本的java DriverManager,但在Mark的世界中,它得到的是一个雪花驱动程序,它将连接池化。所以 正在获取池连接。对吧?

-

删除JSON中的引号,并用方括号替换花括号

我试图创建一个数据数组与FLOT图表一起使用。我使用这个CodeIgniter代码来生成数组: 这段代码的问题是无法绘制生成的JSON对象,因为“值”实际上是字符串。以下是有问题的JSON输出: 这个JSON有三个问题: 需要方括号而不是花括号;和 以下是JSON输出的格式: 清理这个JSON对象的最佳方法是什么?我应该在服务器端使用CodeIgniter代码吗?或者我应该在javascript中

-

横向视图/爆炸在火花与多个列,得到重复

我有以下数据帧,其中包含一些包含数组的列。(我们使用的是火花 1.6) 我期望得到以下结果: 我尝试过横向视图: 但是我得到了一个笛卡尔积,有很多重复。我已经尝试了相同的方法,使用带有列的方法分解所有列,但仍然得到很多重复项 当然,我可以对最终的数据帧进行区分,但这不是一个完美的解决方案。有什么方法可以分解这些列而不得到所有这些副本吗? 谢啦!

-

使用火花从csv文件中删除所有特殊字符

如何使用java spark从spark数据帧中删除csv文件中的所有特殊字符例如:以下是包含空格和特殊字符的csv文件内容 o/p我需要 提前感谢

-

确定莲花多米诺骨牌中哑剧附件的图标

我正在使用LotusDomino的JavaAPI。Domino的当前版本是8.5。我通过DIIOP/CORBA连接到Domino。我想创建一个带有附件的文档(电子邮件)。电子邮件是一个多部分MIME文档。附加一个文件很容易,而且效果很好。但是,附件会显示一个通用文档图标(灰色空白页面)。我想为实际的内容类型设置一个合适的图标,例如,一个单词的图标。文件。这有可能吗?我试图修改setContentF

-

火花窗口自定义函数-获取分区记录总数

我有一个timeseries数据集,它由id分区,并由时间戳排序。示例: 我有一些自定义逻辑,我需要计算,它应该在每个窗口,每个分区内完成。我知道Spark对窗口函数有丰富的支持,我正试图将其用于此目的。 我需要做一些类似的事情: 如何将每个分区中记录总数作为标量值获取?我还添加了计数“my_cnt”值,它添加了分区的总价值,但在我的情况下似乎无法使用它。

-

如何在雪花中将字符串列转换为日期列?

-

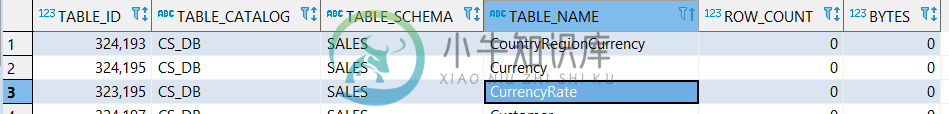

雪花式ACCOUNT_USAGE视图-表(ROW_COUNT,BYTES)在延迟期内不更新

雪花式ACCOUNT_USAGE视图-表(ROW_COUNT,BYTES)在延迟期内不更新我在收集元数据stom雪花-“帐户使用视图”时发现,表中的值(ROW_COUNT,BYTES)没有更新。我预计会有一些延迟,但对于大多数对象,我的值为“0”。我必须清楚地说明,那些桌子并不是新的。他们在那里好几个月了。 在与information_schema.tables进行比较时,我看到了最新的数字。其他(也是ACCOUNT_USAGE)视图TABLE_STORAGE_METRICS至少显示有

-

EMR中可用的纱线容器、火花执行器和节点之间的关系是什么?

假设我有一个包含1个主节点、3个核心节点和5个任务节点的集群。如果我在纱线集群模式下运行spark作业,驱动程序将在主节点上运行(主节点是否也可以运行executor?),每个容器可以有X个执行者。我是否有3个5=8个容器?或者仅仅3个容器,因为只有核心节点可以存储数据? 此外,如果我有两个火花作业同时运行,我是每个节点得到2个独立的容器,每个火花作业1个,还是2个火花作业的执行者每个节点共享1个