《算法题》专题

-

并发:Chudnovky的算法,比同步慢

问题内容: 我刚刚在朋友的推荐下开始学习go。到目前为止,我很喜欢它,但是我写了(我想会是)轻量级并发功能的完美例子,并且得到了令人惊讶的结果……所以我怀疑我做错了,或者误解了goroutine是多么昂贵。我希望这里的一些地鼠能提供见识。 我在Go中使用goroutine和简单的同步执行编写了Chudnovsky的算法。我假设,每次计算都独立于其他计算,因此并发运行至少要快一点。 注意 :我正在第

-

java编程之递归算法总结

本文向大家介绍java编程之递归算法总结,包括了java编程之递归算法总结的使用技巧和注意事项,需要的朋友参考一下 1.何为递归 个人理解就是自己调用自己,直到满足一个条件结束自己调用自己的过程,这个就是递归。举一个通俗的点的例子: 假设你在一个电影院,你想知道自己坐在哪一排,但是前面人很多,你懒得去数了,于是你问前一排的人「你坐在哪一排?」,这样前面的人 (代号 A) 回答你以后,你就知道自己在

-

PHP构造二叉树算法示例

本文向大家介绍PHP构造二叉树算法示例,包括了PHP构造二叉树算法示例的使用技巧和注意事项,需要的朋友参考一下 树(Tree)在数据结构还是很重要的,这里表示二叉树用括号表示法表示。先写一个二叉树节点类: 然后构造二叉树: 这里写上一个打印二叉树的函数(中序遍历): 运行结果: 输入一个字符串 "A(B(C,D),G(F))" 以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支持呐

-

基于python实现KNN分类算法

本文向大家介绍基于python实现KNN分类算法,包括了基于python实现KNN分类算法的使用技巧和注意事项,需要的朋友参考一下 kNN算法的核心思想是如果一个样本在特征空间中的k个最相邻的样本中的大多数属于某一个类别,则该样本也属于这个类别,并具有这个类别上样本的特性。该方法在确定分类决策上只依据最邻近的一个或者几个样本的类别来决定待分样本所属的类别。 kNN方法在类别决策时,只与极少量的相邻

-

使用python实现kNN分类算法

使用python实现kNN分类算法本文向大家介绍使用python实现kNN分类算法,包括了使用python实现kNN分类算法的使用技巧和注意事项,需要的朋友参考一下 k-近邻算法是基本的机器学习算法,算法的原理非常简单: 输入样本数据后,计算输入样本和参考样本之间的距离,找出离输入样本距离最近的k个样本,找出这k个样本中出现频率最高的类标签作为输入样本的类标签,很直观也很简单,就是和参考样本集中的样本做对比。下面讲一讲用pytho

-

原生python实现knn分类算法

本文向大家介绍原生python实现knn分类算法,包括了原生python实现knn分类算法的使用技巧和注意事项,需要的朋友参考一下 一、题目要求 用原生Python实现knn分类算法。 二、题目分析 数据来源:鸢尾花数据集(见附录Iris.txt) 数据集包含150个数据集,分为3类,分别是:Iris Setosa(山鸢尾)、Iris Versicolour(杂色鸢尾)和Iris Virginic

-

python实现感知器算法详解

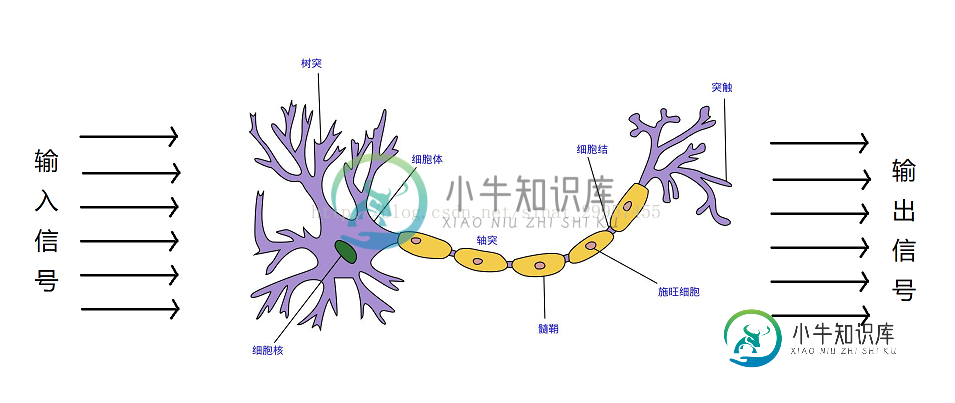

python实现感知器算法详解本文向大家介绍python实现感知器算法详解,包括了python实现感知器算法详解的使用技巧和注意事项,需要的朋友参考一下 在1943年,沃伦麦卡洛可与沃尔特皮茨提出了第一个脑神经元的抽象模型,简称麦卡洛可-皮茨神经元(McCullock-Pitts neuron)简称MCP,大脑神经元的结构如下图。麦卡洛可和皮茨将神经细胞描述为一个具备二进制输出的逻辑门。树突接收多个输入信号,当输入信号累加超过

-

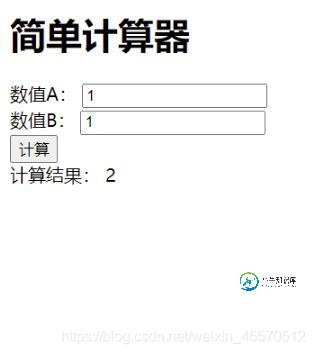

vue实现简单加法计算器

vue实现简单加法计算器本文向大家介绍vue实现简单加法计算器,包括了vue实现简单加法计算器的使用技巧和注意事项,需要的朋友参考一下 本文实例为大家分享了vue实现简单加法计算器的具体代码,供大家参考,具体内容如下 只需要简单两步 1.模板结构,设计界面 2.处理数据和控制逻辑 代码: 以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支持呐喊教程。

-

Python3运算符常见用法分析

Python3运算符常见用法分析本文向大家介绍Python3运算符常见用法分析,包括了Python3运算符常见用法分析的使用技巧和注意事项,需要的朋友参考一下 本文实例讲述了Python3运算符常见用法。分享给大家供大家参考,具体如下: 4.1算数运算符(以下假设变量a为10,变量b为21) 实例操作: 结果: 4.2赋值运算符(以下假设变量a为10,变量b为20) 4.3比较(关系)运算符(以下假设变量a为10,变量b为20)

-

java实现Base64加密解密算法

本文向大家介绍java实现Base64加密解密算法,包括了java实现Base64加密解密算法的使用技巧和注意事项,需要的朋友参考一下 Base64是网络上最常见的用于传输8Bit字节代码的编码方式之一,大家可以查看RFC2045~RFC2049,上面有MIME的详细规范。Base64编码可用于在HTTP环境下传递较长的标识信息。例如,在Java Persistence系统Hibernate中,就

-

Python hashlib常见摘要算法详解

本文向大家介绍Python hashlib常见摘要算法详解,包括了Python hashlib常见摘要算法详解的使用技巧和注意事项,需要的朋友参考一下 这篇文章主要介绍了Python hashlib常见摘要算法详解,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友可以参考下 Python的hashlib提供了常见的摘要算法,如MD5,SHA1等等 计算出一个字

-

python实现八大排序算法(1)

本文向大家介绍python实现八大排序算法(1),包括了python实现八大排序算法(1)的使用技巧和注意事项,需要的朋友参考一下 排序 排序是计算机内经常进行的一种操作,其目的是将一组”无序”的记录序列调整为”有序”的记录序列。分内部排序和外部排序。若整个排序过程不需要访问外存便能完成,则称此类排序问题为内部排序。反之,若参加排序的记录数量很大,整个序列的排序过程不可能完全在内存中完成,需要访问

-

python实现八大排序算法(2)

本文向大家介绍python实现八大排序算法(2),包括了python实现八大排序算法(2)的使用技巧和注意事项,需要的朋友参考一下 本文接上一篇博客python实现的八大排序算法part1,将继续使用python实现八大排序算法中的剩余四个:快速排序、堆排序、归并排序、基数排序 5、快速排序 快速排序是通常被认为在同数量级(O(nlog2n))的排序方法中平均性能最好的。 算法思想: 已知一组无序

-

MySQL:计算行数的最快方法

问题内容: 在MySQL中,哪种方式计算行数应该更快? 这个: 或者,替代方案: 有人会认为第一种方法应该更快,因为在内部确定类似情况时,这显然是数据库领域,而数据库引擎应该比其他任何人都要快。 问题答案: 当您使用count列索引时,它将是最好的结果。使用 MyISAM 引擎的Mysql 实际上存储行数,每次尝试对所有行进行计数时,它都不会对所有行进行计数。(基于主键的列) 使用PHP计数行不是

-

什么是算法的摊销分析?

问题内容: 与渐进分析有何不同?您何时使用它,为什么? 我读过一些写得不错的文章,例如: http://www.ugrad.cs.ubc.ca/~cs320/2010W2/handouts/aa-nutshell.pdf http://www.cs.princeton.edu/~fiebrink/423/AmortizedAnalysisExplained_Fiebrink.pdf 但我仍然没有完