《算法实习》专题

-

阿里 通义实验室 NLP算法实习 二面

阿里 通义实验室 NLP算法实习 二面全程50分钟,不过其中有十几分钟面试官去打电话了😭 这次面试官应该是个主管 1.自我介绍 2.让我挑一个跟大模型更相关的项目介绍,我介绍一个做rag的项目,然后介绍完问了各种问题,到微调的时候他问我lora微调的原理,到缓解幻觉的时候他问我对比解码的细节;感觉他对我的项目不是很感兴趣,可能看着像玩具项目😭 3.介绍另一个项目,我的是一个论文项目,我简单整体介绍了一下,然后他对共情提出了一些问题

-

阿里 通义实验室 NLP算法实习 凉经

阿里 通义实验室 NLP算法实习 凉经全程一个小时 1.自我介绍 2.挑一个项目介绍,我介绍了我论文的项目,直接共享屏幕,分块介绍,中间穿插着很多提问,面试官貌似对共情的相关介绍有很多疑问 3.面试官看我之前有一篇论文也跟这个相关,又让我讲一下那篇论文,我就又共享开始讲,到此为止还是比较顺利的 4.反问,问部门的业务,说是做文档问答、RAG这块的 5.代码题,此时开始凉了,面试官说我笔试做的不好,要给我出一道算法题做一做,然后给我发了

-

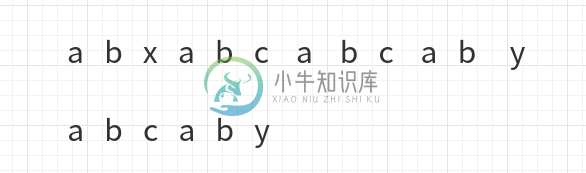

python实现kmp算法的实例代码

python实现kmp算法的实例代码本文向大家介绍python实现kmp算法的实例代码,包括了python实现kmp算法的实例代码的使用技巧和注意事项,需要的朋友参考一下 kmp算法 kmp算法用于字符串的模式匹配,也就是找到模式字符串在目标字符串的第一次出现的位置 比如 abababc 那么bab在其位置1处,bc在其位置5处 我们首先想到的最简单的办法就是蛮力的一个字符一个字符的匹配,但那样的时间复杂度会是O(m*n) kmp算

-

格灵深瞳计算机视觉算法实习生一面

格灵深瞳计算机视觉算法实习生一面格灵深瞳一面,CPU 都干烧了 面试时长:60min 1.自我介绍 2.你觉得笔试哪里做的比较好 3.简历中挑一个你最熟悉的项目介绍(我挑的单目变焦三维重建) 4.如何实现单目变焦三维重建的 5.SLAM 懂一点吗?说一下基本流程 6.讲一下如何准确建图 7.稀疏重建如何去畸变使得图像畸变影响最小 8.图像畸变的原理 9.如何计算图像位姿,本质矩阵如何得到 10.图像特征匹配中 RANSAC 方法

-

算法 - 算法分析

数学模型 1. 近似 2. 增长数量级 3. 内循环 4. 成本模型 注意事项 1. 大常数 2. 缓存 3. 对最坏情况下的性能的保证 4. 随机化算法 5. 均摊分析 ThreeSum 1. ThreeSumSlow 2. ThreeSumBinarySearch 3. ThreeSumTwoPointer 倍率实验 数学模型 1. 近似 N3/6-N2/2+N/3 ~ N3/6。使用 ~f(

-

睿初科技C++算法实习面经

睿初科技C++算法实习面经自我介绍。 面试了C++基本语法和计算几何算法。 1.C++基本语法 (1)多态是什么? (2)上一个回答提到了虚函数,接着问虚函数是怎么实现的? (3)内存溢出和内存泄漏是什么? (4)在子类是公有继承的前提下,父类的私有变量在子类能否直接访问? (5)在A函数里用指针申请好空间后,这块空间需要返回给B函数,然后B函数使用后不再使用这块内存,虽然我们可以手动释放,但往往可能忘记释放,请问用什么方

-

蓝湖算法实习生一面凉经

蓝湖算法实习生一面凉经1. 自我介绍 2. 询问实习时间,谈论简历中上一段实习经历 3. 讲一讲简历里做过的最让你印象深刻的一个项目,具体的实施过程 4. (面试前不知道是cv算法方向,讲3的时候谈到了CNN)问了三个关于神经网络的问题: 1.为什么ResNet中使用1×1的卷积核 2.介绍一下CNN的反向传播过程(这个没推过,完全不会) 3.Dropout的作用 5.问最近有没有写过代码,手撕

-

oppo机器学习算法实习面经

oppo机器学习算法实习面经前言: 岗位:机器学习算法实习 笔试情况:无笔试 一面 1.自我介绍(非科班硕,一份水实习); 2.介绍项目,并由此引出一系列八股文: 介绍gbdt算法的原理与实现 说说xgboost对于gbdt所做的主要优化 3.介绍实习工作 简单介绍resnet及其主要改进(shortcut连接,BN层),说说这些改进为什么work 介绍transformer及self-attention机制实现方式 了解哪

-

2023暑期实习-蚂蚁算法面经

2023暑期实习-蚂蚁算法面经蚂蚁很早就投了,但是直到三月底才捞起来面试,部门是支付宝事业线,岗位是计算机视觉算法 先问了一下有没有做笔试,做了笔试就先不做题了 项目中为什么使用了卡尔曼滤波,为什么跟踪模型使用了比较老的SORT 场景中相邻帧的box跳动较大对跟踪的影响 SORT的匹配是怎么做的,简述一下匈牙利算法(被面试官质疑了一下,问是不是应该是KM算法,脑子抽了没想起来,其实带权的二分图匹配就是KM算法,只记得叫匈牙利了

-

百度-NLP算法-日常实习面经

百度-NLP算法-日常实习面经一面 1. PTQ和QAT的区别 2. 如果对embedding也做量化,你觉得会有什么问题 3. 说一下常见的量化方法和原理 4. 假如现在让你对transformer模型进行量化,你觉得需要量化哪些算子 5. 矩阵乘法算子的量化过程 手撕(如流IDE) 1. 搜索二维矩阵 Ⅱ lc原题 2. Top k 3. python pep9规范 问题 二面:交叉面 1. SLU和NLU的区别 2. 其

-

vivo一面 广告算法 暑期实习

vivo一面 广告算法 暑期实习1.code 硬币换零钱问题 秒了 2.项目 严格拷打最近一个实习的项目,面试官很厉害,一下子就指出了一些当时没有考虑过的东西 3.八股 无 4.反问 组里做什么,base在哪 流程半小时结束,面试官说因为人太多了,所以面试很短 vivo hr说暑期实习技术面就一面,希望好运,进hr面

-

百度推荐算法实习一二面

百度推荐算法实习一二面一面 一小时 介绍自己的项目 项目相关问题(其中一个是问方法/论文的创新点在哪) 协方差和相关系数是什么,他们的的关系是什么 L1范数和L2范数的区别 谈谈Sigmoid ReLU函数在0点的梯度怎么处理 Transformer和Rnn的区别 谈谈Transformer多头注意力机制,多头注意力和普通注意力的区别 从普通注意力换成多头注意力会导致参数暴涨吗?如果有所增加的话,请分析主要是哪个结构导

-

百度暑期实习3.13笔试算法

百度暑期实习3.13笔试算法1.(100%)简单map,但我觉得长度这么短索性用了5个变量 https://pastebin.com/VpAaUgnV 2.(100%)连续n个d的回文子串数为n*(n+1)/2,"red"的回文子串数为3,"re"的回文子串数为2,"r"的回文子串数为1。那就先添加连续的d使其回文子串数小于目标值,再继续添加red使得回文子串数和目标值之差小于3,最后根据需要添加re或r即可。 https:

-

米哈游 图像算法实习 笔试

米哈游 图像算法实习 笔试真的好难啊啊啊🤯 单选和非定向上花了太多时间 后面只有一小时写代码... 第一次笔试,时间掌握的不太好 代码题三题只a了第二题,第一题看了一眼没有思路直接跳了,第三题明明自测代码和提供的例子都过了,但是提交就是0%,不知道为什么555 第一题:构造一个长度为n的数组,满足以下三个条件:1. 所有元素绝对值不大于3;2. 相邻两元素乘积小于0;3. 所有元素之和为0 第二题:必须且只交换一次相邻两

-

科大讯飞AIGC算法实习面试

科大讯飞AIGC算法实习面试项目问题: 1、增强纠错译码项目是怎么做的?目前有几个人在做? 2、该项目未来方向是利用bert来提取自然冗余信息,具体怎么做? 3、NLP的发展历史?(attention+transformer+bert) 4、bert的两个应用场景?(完形填空+给一句话预测下一句) 5、你生活中是怎么使用大模型的?(chat-gpt?文献检索+代码解读+图像生成) 6、yolo和R-CNN区别? 7、目标检测