《flink》专题

-

TaskManager和JobManager之间的Flink Cluster Kubernetes心跳故障

我正在尝试使用本机kubernetes运行flink集群。 下面是flink conf, 首先,JobManager和TaskManager成功启动,TM处理的事件很少。但在超时间隔之后,JM抛出如下所示的心跳错误,并将启动新的TaskManager。旧的任务管理器仍在运行,新的任务管理器在同一命名空间中启动。 无法解释这种行为。我确保检查TaskManager和jobmanager的内存,没有内

-

如何让pod在Kubernetes上以Flink应用程序模式显示普罗米修斯监控端口?

我正在运行flink run应用程序,目标是Kubernetes,使用以下选项: 我指定了一个容器图像,它将普罗米修斯插件复制到插件中。从job manager容器中,我可以下载端口9249上的Prometheus metrics。然而,flink吊舱上的kubectl描述并没有显示普罗米修斯港口已经暴露。kubectl输出中的端口线为: 因此,我希望容器外的任何东西都无法读取普罗米修斯度量。

-

使用flink/kubernetes替换etl作业(在SSI上):每个作业类型一个flink集群,或者每个作业执行创建和销毁flink集群

我正在尝试将使用SSIS包创建的数百个feed文件ETL作业替换为apache flink作业(并将kuberentes作为底层infra)的可行性。我在一些文章中看到的一条建议是“为一种工作使用一个flink集群”。 由于我每天都有少量的每种工作类型的工作,那么这意味着对我来说最好的方法是在执行工作时动态创建flinkcluster并销毁它以释放资源,这是正确的方法吗?我正在建立flinkclu

-

同时运行约10个批处理作业时,Flink纱线会话模式变得不稳定

我正在尝试设置一个flink-yarn会话来运行大约100个批处理作业。连接到大约40个任务管理器和大约10个正在运行的作业(每个任务管理器有2个插槽和1GB内存)后,会话看起来变得不稳定。有足够的资源可用。flinkUI突然变得不可用,我猜作业管理器可能已经死了。最终,纱线应用程序也被杀死了。 作业管理器正在4核16GB节点上运行,可用容量为12 gb 是否有任何指南来计算作业管理器资源与它可以

-

Flink Statefun HA kubernetes集群

我正在尝试在kubernetes上部署高可用的flink集群。在下面的示例中,工作节点被复制,但我们只有一个主pod。 https://github.com/apache/flink-statefun 据我所知,有两种方法可以让job manager成为HA。 https://ci.apache.org/projects/flink/flink-docs-stable/ops/jobmanager

-

Kubernetes中的Flink会话集群和作业提交

我们的团队在我们的K8S集群中设置了Flink会话集群。我们选择Flink会话集群而不是作业集群,因为我们有许多不同的Flink作业,因此我们希望将Flink的开发和部署与我们的作业分离。我们的Flink设置包含: 单个JobManager作为K8S吊舱,无高可用性(HA)设置 我们在一个单独的存储库中开发工作,并在代码合并时部署到Flink集群。 现在,我们注意到在K8S中作为pod的JobMa

-

Apache Flink作业群集rpc。在kubernetes上绑定到本地主机的地址

我正在尝试在kubernetes环境中运行Flink作业集群(1.8.1)。我使用此文档使用我的作业jar创建了docker映像。 按照kubefiles创建作业、作业管理器和任务管理器。问题是任务管理器无法连接到作业管理器,并持续崩溃。 调试作业管理器日志时,

-

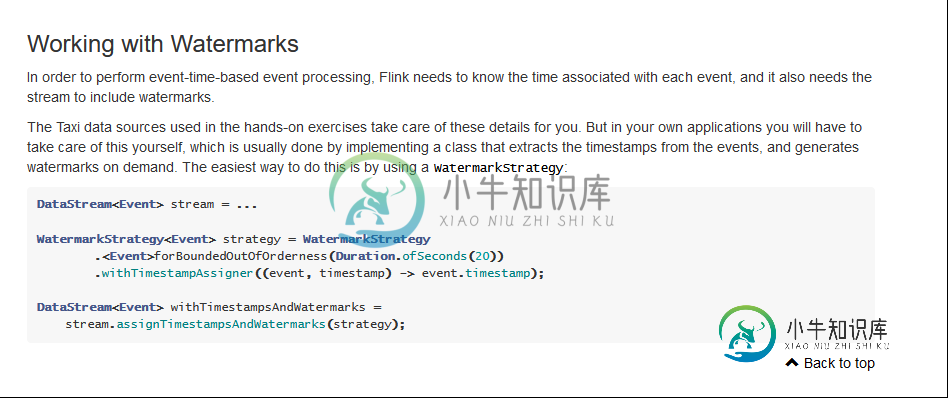

Flink-如何使用TimestampAssigner从事件有效负载获取时间(不使用Kafka时间戳)

Flink-如何使用TimestampAssigner从事件有效负载获取时间(不使用Kafka时间戳)我试图理解如何在Kafka源代码的水印策略中使用withTimestampAssigner()。我需要使用的“时间”在消息负载内。 为此,我有以下代码: 其中EventDeserializationSchema()是: 和事件: 我想了解的是如何为withTimeStampAssigner()提供时间: 变量应该是Event.time但从flink页面我不太明白。 我一直在寻找 这让我有点困惑,因

-

如何在Apache Flink中平面映射到数据库?

我正在使用Apache Flink尝试从Kafka获取JSON记录到InfluxDB,并在过程中将它们从一个JSON记录拆分为多个InfluxDB点。 我找到了转换,感觉它符合目的。核心代码如下所示: 出于某种原因,我只将其中一个收集的点流式传输到数据库中。 即使我打印出所有映射的条目,它似乎也能正常工作:产生: 我是否误解了平面图,或者流入连接器中是否存在一些错误?

-

Apache Flink连续拆分奇怪的行为

我相信,当连续完成两个拆分时,Flink的行为很奇怪。我可能在我的实现逻辑中有一些错误,这就是为什么我在这里发帖征求您的意见。 最小示例:我有一个包含单词Apple、Banana和Orange的文本文件。我将其作为源在流执行环境中传递。我进行了第一次拆分,其中选择条件是参数是否为单词“Apple”。如果是,我将其放在“主题”Apples中,否则放在“主题”NotApples中。然后我在此拆分流中选

-

阿帕奇·Flink:地图vs平面地图

在闪光灯下,平面图也可以发出一条记录。似乎平面图可以代替地图。有人能告诉我这种情况下的区别吗?谢谢你。

-

具有数百万输出的Apache Flink flatMap

每当我收到消息时,我都想从数据库中读取,可能会返回数百万行,然后我想将这些行传递到流中。这在Flink被认为是良好的做法吗? 编辑: 背景:我想动态运行报告。db基本上是一个巨大的窗口。该报告基于该窗口实时数据。该报告具有高度的可定制性,因此很难预先处理结果或定义管道。 我今天使用的是vanilla java,管道大致是这样的:报告定义-

-

Apache Flink:MapPartition Vs.FlatMap

我对MapPartition没有清楚的理解。请有人解释一下Mappartition的一些用例,以及它与FlatMap的区别?

-

如何将Protobuf数据从Flink转发到Kafka和stdout?

我想在这里添加一些代码,并对来自Flink的protobuf数据进行stdout。 我正在使用Flink的Apache Kafka连接器将Flink连接到Kafka。 这是我的Flink密码。 这是我的Kafka代码。

-

Flink Kafka连接器至eventhub

我正在使用Apache Flink,并尝试通过使用Apache Kafka协议从它接收消息来连接到Azure eventhub。我设法连接到Azure eventhub并接收消息,但我不能使用这里(https://ci.apache.org/projects/flink/flink-docs-stable/dev/connectors/kafka.html#kafka-consumers-star