《tensorflow》专题

-

Tensorflow ValueError:没有要保存的变量

问题内容: 我已经写了一个tensorflow CNN,它已经受过训练。我希望将其还原以在几个示例上运行它,但不幸的是它吐出来了: ValueError:没有要保存的变量 我的评估代码可以在这里找到: 问题答案: 在必须创建 后 要恢复(或保存)的变量。此外,必须在与这些变量相同的图形中创建它。 假设还可以在模型中创建变量,则在此行之后添加保护程序创建应该可以: 另外,您必须将创建的新内容传递给构

-

Tensorflow模型的超参数调整

问题内容: 我之前曾使用Scikit-learn的GridSearchCV优化模型的超参数,但只是想知道是否存在类似的工具来优化Tensorflow的超参数(例如 历元数,学习率,滑动窗口大小等 )。 如果没有,如何实现有效运行所有不同组合的代码段? 问题答案: 使用Tensorflow进行网格搜索的另一个可行的(已记录)选项是Ray Tune 。它是用于超参数调整的可扩展框架,专门用于深度学习/

-

了解Tensorflow LSTM输入形状

问题内容: 我有一个由 N = 4000个样本 组成的数据集X ,每个样本都包含 d = 2个特征 (连续值),这些特征跨越 t = 10个时间步长 。在时间步骤11,我还具有每个样本的相应“标签”,它们也是连续值。 目前,我的数据集的形状为X:[4000,20],Y:[4000]。 给定d个功能的10个先前输入,我想使用TensorFlow训练LSTM来预测Y值(回归),但是我在TensorFl

-

在TensorFlow培训期间打印损失

问题内容: 我正在看TensorFlow“ MNIST对于ML初学者”教程,我想在每个训练步骤之后打印出训练损失。 我的训练循环目前看起来像这样: 现在,定义为: 我要打印的损失在哪里: 一种打印方式是在训练循环中显式计算: 我现在有两个问题: 鉴于已经在期间进行了计算,因此将其计算两次效率低下,这需要所有训练数据的前向通过次数的两倍。有没有一种方法可以访问在计算期间的value ? 我如何打印?

-

ValueError:没有为任何变量提供渐变-Tensorflow 2.0 / Keras

问题内容: 我正在尝试使用Keras实现一个简单的序列到序列模型。但是,我一直看到以下内容: 像其他的问题这个还是看这个问题在Github上认为,这可能有一些做的交叉熵损失函数; 但我看不到我在做什么错。 我不认为这是问题所在,但我要提一提,确切地说,我是每晚构建的TensorFlow 。 以下代码是一个独立的示例,应从上面重现异常: 更新资料 要点链接 Github问题链接 问题答案: 您的代码

-

Tensorflow执行时间

问题内容: 我在Python脚本中有多次调用的函数(https://github.com/sankhaMukherjee/NNoptExpt/blob/dev/src/lib/NNlib/NNmodel.py):为此,我已大大简化了该函数例。 我从另一个函数多次调用此函数。当我看到程序日志时,似乎此功能花费的时间越来越长。显示了部分日志: 有没有其他人经历过这样的事情?这完全让我感到困惑… 编辑

-

TensorFlow:如何发布没有源代码的模型?

问题内容: 我正在使用Tensorflow + Python。 我很好奇是否可以在没有详细源代码的情况下发布保存的Tensorflow模型(体系结构+训练有素的变量)。我知道,但是它看起来只保存变量,并且为了还原/运行它们,用户需要“定义”相同的体系结构。 仅出于测试/运行目的,有没有办法释放没有源代码的保存的{architecture + trained variables},以便用户可以进行查

-

Tensorflow的tensorflow variable_scope values参数含义

问题内容: 我目前正在阅读基于Tensorflow的苗条库的源代码,并且它们将参数用于很多方法,例如here。 从API页面,我可以看到: 该上下文管理器验证(可选)值是否来自同一图,确保该图是默认图,并推送名称范围和变量范围。 我的问题是:仅检查来自的变量是否来自同一张图?有哪些用例?为什么有人需要它? 问题答案: variable_scope参数有助于确保变量的唯一性并在需要时重用变量。 是的

-

从TensorFlow高效地获取梯度?

问题内容: 我正在尝试使用TensorFlow实现异步参数服务器DistBelief样式。我发现最小化()分为两个函数,compute_gradients和apply_gradients,所以我的计划是在它们之间插入网络边界。我有一个问题,如何同时评估所有梯度并将其全部拉出。我知道eval仅评估必要的子图,但它也仅返回一个张量,而不返回计算该张量所需的张量链。 我怎样才能更有效地做到这一点?我以D

-

TensorFlow变量和常量

问题内容: 我是tensorflow的新手,我无法理解变量和常量的区别,我知道我们将变量用于方程式,将常量用于直接值,但是为什么代码#1仅工作,为什么代码#2和# 3,请说明在哪种情况下我们必须先运行图形(a),然后运行变量(b),即 在这种情况下,我可以直接执行此命令,即 代码1: 代码2: 代码3: 问题答案: 在TensorFlow中,常量和变量之间的区别在于,当您声明某个常量时,其值以后将

-

如何在tensorflow 2.0中加载和保存模型?[副本]

在tenstorflow 2.0中,一旦模型被训练,我们如何保存模型以防止从一开始就重新训练它?

-

如何使用tensorflow[duplicate]保存DNN模型

我有训练DNN网络的代码。我不想每次都训练这个网络,因为它占用了太多的时间。如何保存模型? 运行此函数后,我得到一个,我想保存它。

-

如何在tensorflow中恢复会话?[副本]

我想使用我的神经网络,而不需要再次训练网络。我读到关于 现在我在文件夹中有3个文件:检查点、model.ckpt和model.ckpt.meta 我想在python的另一个类中恢复数据,得到我的神经网络的权重,并进行一次预测。 我该怎么做呢?

-

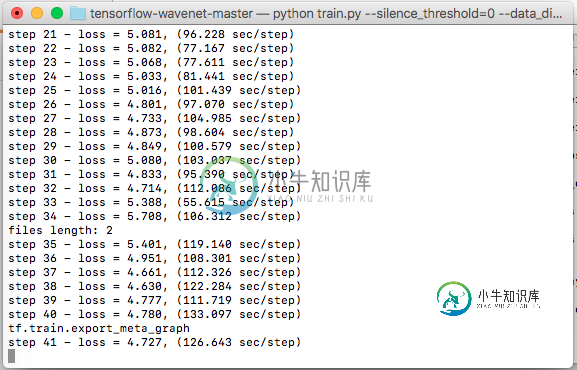

完成正在进行的Tensorflow培训

完成正在进行的Tensorflow培训数据丢失:不是sstable(错误的幻数):可能您的文件格式不同,您需要使用不同的还原运算符? 我看过这篇文章,但是tf。火车导出元图不起任何作用。另外,如果我尝试在新的终端选项卡中生成输出,如下所示: 我得到这个错误,基本上说我不能生成输出,因为训练数据还没有保存。如何保存并完成培训?

-

TensorFlow 1.14.0未使用GPU

我在我的Ubuntu 19.04笔记本电脑上使用设置了TensorFlow。所有依赖项,如CUDA,CUDNN都安装并工作。但是,当导入TensorFlow并检查给我False。我尝试过完全卸载和重新安装TensorFlow,这不起作用。输出: 2019-06-27 14:06:18.359739: I tenstorflow/core/平台/cpu_feature_guard.cc:142]您的