《神策数据》专题

-

卷积神经网络不收敛

卷积神经网络不收敛我一直在看一些关于深度学习/卷积神经网络的视频,比如这里和这里,我试图用C语言实现我自己的。在我第一次尝试时,我试图保持输入数据相当简单,所以我的想法是区分十字和圆,我有一个大约25个的小数据集(64*64个图像),它们如下所示: 网络本身有五层: 我的问题是我的网络没有收敛到任何东西上。权重似乎都没有改变。如果我运行它,预测基本保持不变,除了偶尔出现的异常值,它会在下一次迭代返回之前跳起来。 卷

-

卷积神经网络-多通道

然而,我不明白如何扩展这个模型来处理多个通道。每个特征图是否需要三个独立的权重集,并在每种颜色之间共享? 参考本教程的“共享权重”部分:http://deeplearning.net/tutorial/lenet.html特征图中的每个神经元都引用层m-1,颜色是从单独的神经元引用的。我不明白他们在这里表达的关系。神经元是核还是像素?为什么它们引用图像的不同部分? 根据我的例子,一个神经元内核似乎

-

增强图形和精神[副本]

谁能解释一下这最后一行吗?我需要最终确定两个顶点是否相连。

-

井字游戏的神经网络

我写的神经网络可以玩井字游戏。网络有9个输入神经元,它们描述板的状态(1-代表网络移动,1.5-代表对手移动,0-代表空单元)和9个输出神经元(具有最高值的输出神经元表示给定状态下的最佳动作)。网络没有隐藏层。激活函数-乙状结肠。学习方法--Q学习+反向传播。 网络是经过训练的,但很差(继续踩在被占用的单元格上)。所以我决定添加一个隐藏层。我想问: 在隐藏层中使用多少个神经元,在隐藏层和输出层中使

-

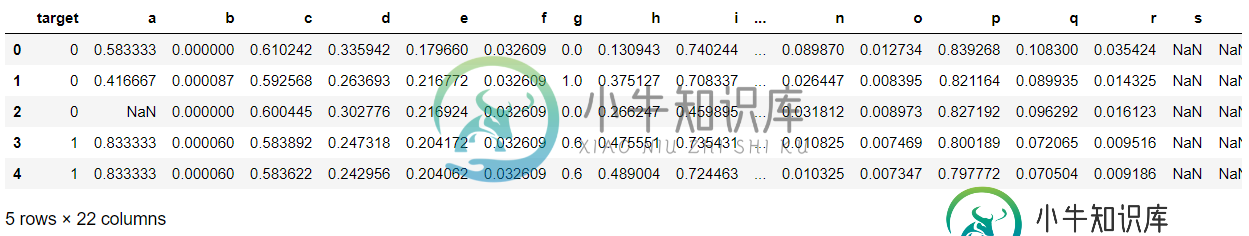

分类神经网络不学习

分类神经网络不学习我正在建立一个分类神经网络,以便对两个不同的类进行分类。 所以这是一个二元分类问题,我正尝试用一个前馈神经网络来解决这个任务。 但是网络是不能学习的,事实上,在训练过程中,网络的精度是不变的。 具体而言,数据集由以下人员组成: 65673行22列。 其中一列是具有值(0,1)的目标类,而其他21列是预测器。数据集是这样平衡的: null 可以看到也有NaN值,但我不能删除它,因为在其他列中有值0是

-

神经网络与图像分类

我用两个输出神经元会得到更好的结果吗?(一个激活为“是音乐”,另一个激活为“不是音乐”)。 (您可以在这里看到这方面的C++源代码:https://github.com/mcmenaminadrian/musonet--尽管在任何给定的时间,公开回购中的内容可能并不完全是我在机器上使用的内容。)

-

Nox夜神测开实习面经

Nox夜神测开实习面经7.18 一面 腾讯会议面试 没手撕代码 没问项目 一面比较基础 自我介绍 计算机网络 分层以及各层协议、TCP UDP区别 TCP三次握手、为何不是4次或2次 流量控制、网页输入url的过程 操作系统 进程和线程区别、进程开销为何比线程大 内核级线程与用户级线程区别 Linux 查看进程、查看日志后十行 数据库 关键字:分组 排序 联表 Java 数组和链表的区别、collections.sor

-

第八章:神奇的xargs命令

xargs命令:将stdin转换成传入其它命令的参数 xargs命令的作用在于给别的命令传递参数,其一般配合管道符|来使用,把前一命令的stdout作为自己的stdin,再转换成command line形式的参数传给其它命令。 xargs命令的语法 其一般出现的形式如下: OtherCommand [options] | xargs [options] [TargetCommand [option

-

十、人工神经网络介绍

鸟类启发我们飞翔,牛蒡植物启发了尼龙绳,大自然也激发了许多其他发明。从逻辑上看,大脑是如何构建智能机器的灵感。这是启发人工神经网络(ANN)的关键思想。然而,尽管飞机受到鸟类的启发,但它们不必拍动翅膀。同样的,ANN 逐渐变得与他们的生物表兄弟有很大的不同。一些研究者甚至争辩说,我们应该完全放弃生物类比(例如,通过说“单位”而不是“神经元”),以免我们把我们的创造力限制在生物学的系统上。 人工神经

-

图解递归神经网络(RNN)

递归神经网络 递归神经网络(RNN)是两种人工神经网络的总称。一种是时间递归神经网络(recurrent neural network),另一种是结构递归神经网络(recursive neural network)。时间递归神经网络的神经元间连接构成有向图,而结构递归神经网络利用相似的神经网络结构递归构造更为复杂的深度网络。两者训练的算法不同,但属于同一算法变体(百度百科)。本节我们重点介绍时间递

-

神经网络模型的原理

人工神经网络 人工神经网络又叫神经网络,是借鉴了生物神经网络的工作原理形成的一种数学模型。下面是一张生物神经元的图示: 生物神经网络就是由大量神经元构成的网络结构如下图: 生物的神经网络是通过神经元、细胞、触电等结构组成的一个大型网络结构,用来帮助生物进行思考和行动等。那么人们就想到了电脑是不是也可以像人脑一样具有这种结构,这样是不是就可以思考了? 类似于神经元的结构,人工神经网络也是基于这样的神

-

大话WEB开发必备神器

开发的过程中经常会使用到的各种辅助软件,学会并灵活的使用这些工具,可以提高开发效率,提高排查问题的速度,达到一个事半功倍的效果; 这里我就列出在开发的过程中我会使用的一些工具,分享给大家。 抓包神器 WEB API 开发和调试,线上问题排查,总是需要有抓包工具进行请求的抓包分析 如:手机APP,PC 软件,浏览器和WEB API 交互请求的抓包 常用功能 模拟请求,get,post 等 获取请求报

-

深度卷积神经网络(AlexNet)

在LeNet提出后的将近20年里,神经网络一度被其他机器学习方法超越,如支持向量机。虽然LeNet可以在早期的小数据集上取得好的成绩,但是在更大的真实数据集上的表现并不尽如人意。一方面,神经网络计算复杂。虽然20世纪90年代也有过一些针对神经网络的加速硬件,但并没有像之后GPU那样大量普及。因此,训练一个多通道、多层和有大量参数的卷积神经网络在当年很难完成。另一方面,当年研究者还没有大量深入研究参

-

深度神经网络(Deep Neural Networks)

深度神经网络(DNN)是在输入和输出层之间具有多个隐藏层的ANN。 与浅层神经网络类似,DNN可以模拟复杂的非线性关系。 神经网络的主要目的是接收一组输入,对它们执行逐步复杂的计算,并提供输出以解决诸如分类之类的现实世界问题。 我们限制自己前馈神经网络。 我们在深层网络中有输入,输出和顺序数据流。 神经网络广泛用于监督学习和强化学习问题。 这些网络基于彼此连接的一组层。 在深度学习中,隐藏层的数量

-

人工神经网络(Artificial Neural Networks)

人工神经网络,或简称神经网络,并不是一个新概念。 它已经存在了大约80年。 直到2011年,深度神经网络才开始流行使用新技术,庞大的数据集可用性和强大的计算机。 神经网络模仿神经元,其具有树突,核,轴突和末端轴突。 对于网络,我们需要两个神经元。 这些神经元通过一个的树突和另一个的末端轴突之间的突触传递信息。 一个可能的人造神经元模型看起来像这样 - 神经网络如下图所示 - 圆是神经元或节点,它们