@小牛知识库 xnip.cn

在Spark中,groupByKey函数是一种经常使用的转换操作,它执行数据的混乱。它接收键值对(K,V)作为输入,基于键对值进行分组,并生成(K,Iterable)对的数据集作为输出。

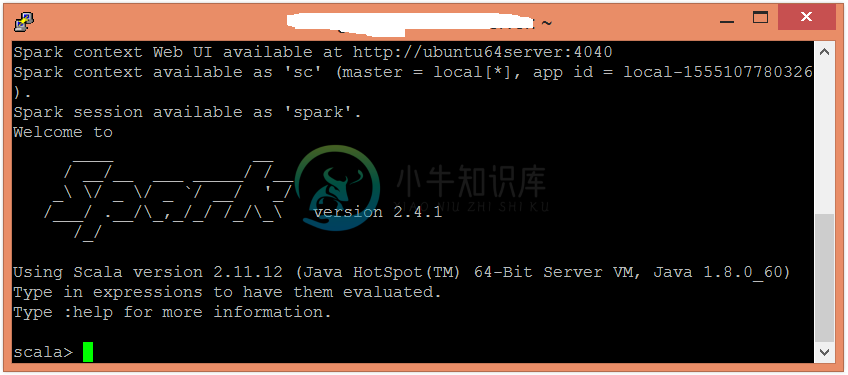

在此示例中,根据键对值进行分组。要在Scala模式下打开Spark,请按照以下命令操作。

$ spark-shell

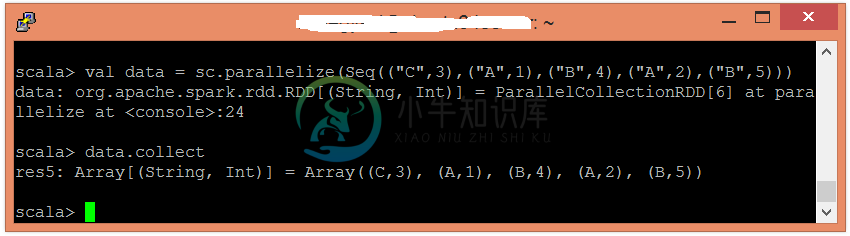

使用并行化集合创建RDD。

scala> val data = sc.parallelize(Seq(("C",3),("A",1),("B",4),("A",2),("B",5)))

现在,可以使用以下命令读取生成的结果。

scala> data.collect

应用groupByKey()函数对值进行分组。

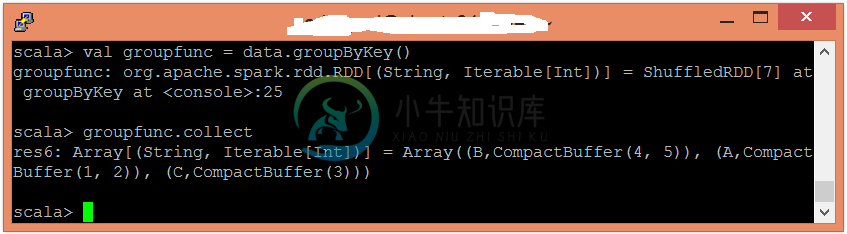

scala> val groupfunc = data.groupByKey()

现在,可以使用以下命令读取生成的结果。

scala> groupfunc.collect