《pytorch》专题

-

dpn网络的pytorch实现方式

本文向大家介绍dpn网络的pytorch实现方式,包括了dpn网络的pytorch实现方式的使用技巧和注意事项,需要的朋友参考一下 我就废话不多说了,直接上代码吧! 以上这篇dpn网络的pytorch实现方式就是小编分享给大家的全部内容了,希望能给大家一个参考,也希望大家多多支持呐喊教程。

-

关于ResNeXt网络的pytorch实现

本文向大家介绍关于ResNeXt网络的pytorch实现,包括了关于ResNeXt网络的pytorch实现的使用技巧和注意事项,需要的朋友参考一下 此处需要pip install pretrainedmodels 以上这篇关于ResNeXt网络的pytorch实现就是小编分享给大家的全部内容了,希望能给大家一个参考,也希望大家多多支持呐喊教程。

-

PyTorch实现ResNet50、ResNet101和ResNet152示例

PyTorch实现ResNet50、ResNet101和ResNet152示例本文向大家介绍PyTorch实现ResNet50、ResNet101和ResNet152示例,包括了PyTorch实现ResNet50、ResNet101和ResNet152示例的使用技巧和注意事项,需要的朋友参考一下 PyTorch: https://github.com/shanglianlm0525/PyTorch-Networks 以上这篇PyTorch实现ResNet50、ResNet1

-

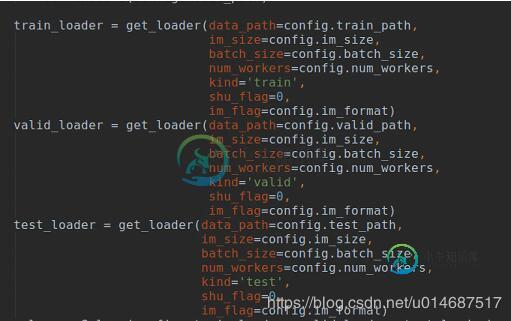

解决pytorch DataLoader num_workers出现的问题

解决pytorch DataLoader num_workers出现的问题本文向大家介绍解决pytorch DataLoader num_workers出现的问题,包括了解决pytorch DataLoader num_workers出现的问题的使用技巧和注意事项,需要的朋友参考一下 最近在学pytorch,在使用数据分批训练时在导入数据是使用了 DataLoader 在参数 num_workers的设置上使程序出现运行没有任何响应的结果 ,看看代码 (以上代码取莫烦p

-

Pytorch在dataloader类中设置shuffle的随机数种子方式

Pytorch在dataloader类中设置shuffle的随机数种子方式本文向大家介绍Pytorch在dataloader类中设置shuffle的随机数种子方式,包括了Pytorch在dataloader类中设置shuffle的随机数种子方式的使用技巧和注意事项,需要的朋友参考一下 如题:Pytorch在dataloader类中设置shuffle的随机数种子方式 虽然实验结果差别不大,但是有时候也悬殊两个百分点 想要复现实验结果 发现用到随机数的地方就是dataloa

-

为什么我们需要在PyTorch中调用zero_grad()?

问题内容: 训练期间需要调用该方法。但是文档不是很有帮助 为什么我们需要调用此方法? 问题答案: 在中,我们需要在开始进行反向传播之前将梯度设置为零,因为PyTorch 会 在随后的向后传递中 累积梯度 。在训练RNN时这很方便。因此,默认操作是在每次调用时累积(即求和)梯度。 因此,理想情况下,当您开始训练循环时,应该正确进行参数更新。否则,梯度将指向预期方向以外的其他方向,即朝向 最小值 (或

-

深度学习入门之Pytorch 数据增强的实现

深度学习入门之Pytorch 数据增强的实现本文向大家介绍深度学习入门之Pytorch 数据增强的实现,包括了深度学习入门之Pytorch 数据增强的实现的使用技巧和注意事项,需要的朋友参考一下 数据增强 卷积神经网络非常容易出现过拟合的问题,而数据增强的方法是对抗过拟合问题的一个重要方法。 2012 年 AlexNet 在 ImageNet 上大获全胜,图片增强方法功不可没,因为有了图片增强,使得训练的数据集比实际数据集多了很多'新'样本

-

Pytorch GPU显存充足却显示out of memory的解决方式

本文向大家介绍Pytorch GPU显存充足却显示out of memory的解决方式,包括了Pytorch GPU显存充足却显示out of memory的解决方式的使用技巧和注意事项,需要的朋友参考一下 今天在测试一个pytorch代码的时候显示显存不足,但是这个网络框架明明很简单,用CPU跑起来都没有问题,GPU却一直提示out of memory. 在网上找了很多方法都行不通,最后我想也许

-

PyTorch中的model.train()有什么作用?

问题内容: 它调用的?我以为我们在调用模型时会使用方法。为什么我们需要指定train()? 问题答案: 告诉模型您正在训练模型。因此,在训练和测试过程中表现不同的有效层(如辍学,batchnorm等)可以知道发生了什么,因此可以相应地表现。 更多详细信息:它设置训练模式(请参阅源代码)。您可以致电或告诉您正在测试。期望功能训练模型有些直观,但是并没有做到这一点。它只是设置模式。

-

基于pytorch 预训练的词向量用法详解

本文向大家介绍基于pytorch 预训练的词向量用法详解,包括了基于pytorch 预训练的词向量用法详解的使用技巧和注意事项,需要的朋友参考一下 如何在pytorch中使用word2vec训练好的词向量 这个方法是在pytorch中将词向量和词对应起来的一个方法. 一般情况下,如果我们直接使用下面的这种: 这种情况下, 因为没有指定训练好的词向量, 所以embedding会帮咱们生成一个随机的词

-

pytorch中的自定义数据处理详解

本文向大家介绍pytorch中的自定义数据处理详解,包括了pytorch中的自定义数据处理详解的使用技巧和注意事项,需要的朋友参考一下 pytorch在数据中采用Dataset的数据保存方式,需要继承data.Dataset类,如果需要自己处理数据的话,需要实现两个基本方法。 :.getitem:返回一条数据或者一个样本,obj[index] = obj.getitem(index). :.len

-

pytorch 自定义参数不更新方式

本文向大家介绍pytorch 自定义参数不更新方式,包括了pytorch 自定义参数不更新方式的使用技巧和注意事项,需要的朋友参考一下 nn.Module中定义参数:不需要加cuda,可以求导,反向传播 下面这个例子说明中间变量可能没有梯度,但是最终变量有梯度: cy1 cd都有梯度 以上这篇pytorch 自定义参数不更新方式就是小编分享给大家的全部内容了,希望能给大家一个参考,也希望大家多多支

-

pytorch 实现模型不同层设置不同的学习率方式

本文向大家介绍pytorch 实现模型不同层设置不同的学习率方式,包括了pytorch 实现模型不同层设置不同的学习率方式的使用技巧和注意事项,需要的朋友参考一下 在目标检测的模型训练中, 我们通常都会有一个特征提取网络backbone, 例如YOLO使用的darknet SSD使用的VGG-16。 为了达到比较好的训练效果, 往往会加载预训练的backbone模型参数, 然后在此基础上训练检测网

-

pytorch 可视化feature map的示例代码

本文向大家介绍pytorch 可视化feature map的示例代码,包括了pytorch 可视化feature map的示例代码的使用技巧和注意事项,需要的朋友参考一下 之前做的一些项目中涉及到feature map 可视化的问题,一个层中feature map的数量往往就是当前层out_channels的值,我们可以通过以下代码可视化自己网络中某层的feature map,个人感觉可视化fea

-

pytorch实现用Resnet提取特征并保存为txt文件的方法

本文向大家介绍pytorch实现用Resnet提取特征并保存为txt文件的方法,包括了pytorch实现用Resnet提取特征并保存为txt文件的方法的使用技巧和注意事项,需要的朋友参考一下 接触pytorch一天,发现pytorch上手的确比TensorFlow更快。可以更方便地实现用预训练的网络提特征。 以下是提取一张jpg图像的特征的程序: 以下是提取一个文件夹下所有jpg、jpeg图像的程