《pytorch》专题

-

pytorch 更改预训练模型网络结构的方法

本文向大家介绍pytorch 更改预训练模型网络结构的方法,包括了pytorch 更改预训练模型网络结构的方法的使用技巧和注意事项,需要的朋友参考一下 一个继承nn.module的model它包含一个叫做children()的函数,这个函数可以用来提取出model每一层的网络结构,在此基础上进行修改即可,修改方法如下(去除后两层): 那么,接下来就可以构建我们的网络了: 最后,构建一个对象,并加载

-

pytorch打印网络结构的实例

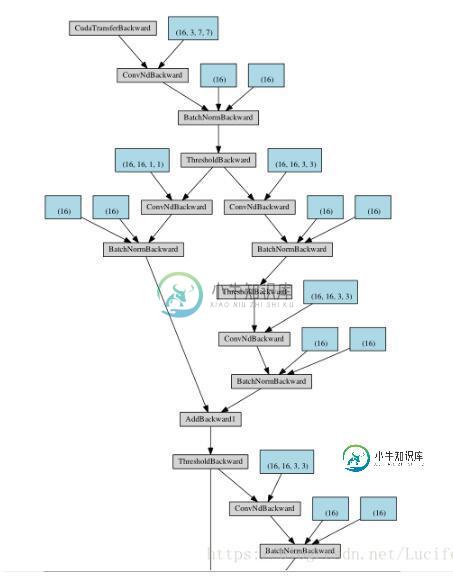

pytorch打印网络结构的实例本文向大家介绍pytorch打印网络结构的实例,包括了pytorch打印网络结构的实例的使用技巧和注意事项,需要的朋友参考一下 最简单的方法当然可以直接print(net),但是这样网络比较复杂的时候效果不太好,看着比较乱;以前使用caffe的时候有一个网站可以在线生成网络框图,tensorflow可以用tensor board,keras中可以用model.summary()、或者plot_mo

-

pytorch索引查找 index_select的例子

本文向大家介绍pytorch索引查找 index_select的例子,包括了pytorch索引查找 index_select的例子的使用技巧和注意事项,需要的朋友参考一下 index_select anchor_w = self.FloatTensor(self.scaled_anchors).index_select(1, self.LongTensor([0])) 参数说明:index_sel

-

浅谈Pytorch中的torch.gather函数的含义

浅谈Pytorch中的torch.gather函数的含义本文向大家介绍浅谈Pytorch中的torch.gather函数的含义,包括了浅谈Pytorch中的torch.gather函数的含义的使用技巧和注意事项,需要的朋友参考一下 pytorch中的gather函数 pytorch比tensorflow更加编程友好,所以准备用pytorch试着做最近要做的一些实验。 立个flag开始学习pytorch,新开一个分类整理学习pytorch中的一些踩到的泥

-

PyTorch中Tensor的维度变换实现

本文向大家介绍PyTorch中Tensor的维度变换实现,包括了PyTorch中Tensor的维度变换实现的使用技巧和注意事项,需要的朋友参考一下 对于 PyTorch 的基本数据对象 Tensor (张量),在处理问题时,需要经常改变数据的维度,以便于后期的计算和进一步处理,本文旨在列举一些维度变换的方法并举例,方便大家查看。 维度查看:torch.Tensor.size() 查看当前 tens

-

PyTorch中Tensor的拼接与拆分的实现

本文向大家介绍PyTorch中Tensor的拼接与拆分的实现,包括了PyTorch中Tensor的拼接与拆分的实现的使用技巧和注意事项,需要的朋友参考一下 拼接张量:torch.cat() 、torch.stack() torch.cat(inputs, dimension=0) → Tensor 在给定维度上对输入的张量序列 seq 进行连接操作 举个例子: 对于需要拼接的张量,维度数量必须相同

-

详解PyTorch中Tensor的高阶操作

详解PyTorch中Tensor的高阶操作本文向大家介绍详解PyTorch中Tensor的高阶操作,包括了详解PyTorch中Tensor的高阶操作的使用技巧和注意事项,需要的朋友参考一下 条件选取:torch.where(condition, x, y) → Tensor 返回从 x 或 y 中选择元素的张量,取决于 condition 操作定义: 举个例子: 把张量中的每个数据都代入条件中,如果其大于 0 就得出 a,其它情况就得出

-

浅析PyTorch中nn.Linear的使用

浅析PyTorch中nn.Linear的使用本文向大家介绍浅析PyTorch中nn.Linear的使用,包括了浅析PyTorch中nn.Linear的使用的使用技巧和注意事项,需要的朋友参考一下 查看源码 Linear 的初始化部分: 需要实现的内容: 计算步骤: 返回的是:input * weight + bias 对于 weight 对于 bias 实例展示 举个例子: 张量的大小由 140 x 100 变成了 140 x 50 执行的

-

Pytorch实现GoogLeNet的方法

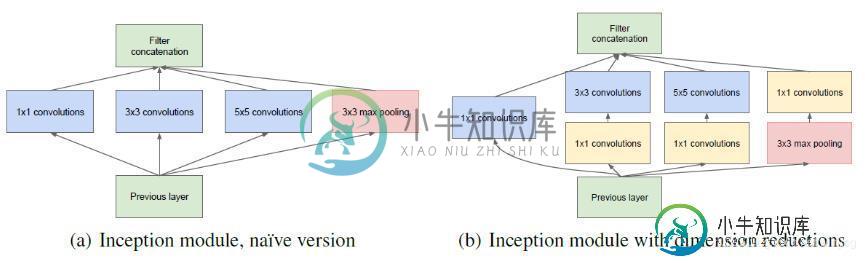

Pytorch实现GoogLeNet的方法本文向大家介绍Pytorch实现GoogLeNet的方法,包括了Pytorch实现GoogLeNet的方法的使用技巧和注意事项,需要的朋友参考一下 GoogLeNet也叫InceptionNet,在2014年被提出,如今已到V4版本。GoogleNet比VGGNet具有更深的网络结构,一共有22层,但是参数比AlexNet要少12倍,但是计算量是AlexNet的4倍,原因就是它采用很有效的Ince

-

PyTorch之图像和Tensor填充的实例

本文向大家介绍PyTorch之图像和Tensor填充的实例,包括了PyTorch之图像和Tensor填充的实例的使用技巧和注意事项,需要的朋友参考一下 在PyTorch中可以对图像和Tensor进行填充,如常量值填充,镜像填充和复制填充等。在图像预处理阶段设置图像边界填充的方式如下: 对Tensor进行填充的方式如下: 这里需要注意一点的是,transforms.Pad只能对PIL图像格式进行填充

-

Pytorch Tensor的索引与切片例子

本文向大家介绍Pytorch Tensor的索引与切片例子,包括了Pytorch Tensor的索引与切片例子的使用技巧和注意事项,需要的朋友参考一下 1. Pytorch风格的索引 根据Tensor的shape,从前往后索引,依次在每个维度上做索引。 示例代码: 上述代码创建了一个shape=[4, 3, 28, 28]的Tensor,我们可以理解为4张图片,每张图片有3个通道,每个通道是28x

-

在PyTorch中Tensor的查找和筛选例子

本文向大家介绍在PyTorch中Tensor的查找和筛选例子,包括了在PyTorch中Tensor的查找和筛选例子的使用技巧和注意事项,需要的朋友参考一下 本文源码基于版本1.0,交互界面基于0.4.1 import torch 按照指定轴上的坐标进行过滤 index_select() 沿着某tensor的一个轴dim筛选若干个坐标 where() 用于将两个broadcastable的tenso

-

对Pytorch神经网络初始化kaiming分布详解

对Pytorch神经网络初始化kaiming分布详解本文向大家介绍对Pytorch神经网络初始化kaiming分布详解,包括了对Pytorch神经网络初始化kaiming分布详解的使用技巧和注意事项,需要的朋友参考一下 函数的增益值 提供了对非线性函数增益值的计算。 增益值gain是一个比例值,来调控输入数量级和输出数量级之间的关系。 xavier分布 xavier分布解析:https://prateekvjoshi.com/2016/03/29/

-

pytorch中的embedding词向量的使用方法

本文向大家介绍pytorch中的embedding词向量的使用方法,包括了pytorch中的embedding词向量的使用方法的使用技巧和注意事项,需要的朋友参考一下 Embedding 词嵌入在 pytorch 中非常简单,只需要调用 torch.nn.Embedding(m, n) 就可以了,m 表示单词的总数目,n 表示词嵌入的维度,其实词嵌入就相当于是一个大矩阵,矩阵的每一行表示一个单词。

-

Pytorch加载部分预训练模型的参数实例

本文向大家介绍Pytorch加载部分预训练模型的参数实例,包括了Pytorch加载部分预训练模型的参数实例的使用技巧和注意事项,需要的朋友参考一下 前言 自从从深度学习框架caffe转到Pytorch之后,感觉Pytorch的优点妙不可言,各种设计简洁,方便研究网络结构修改,容易上手,比TensorFlow的臃肿好多了。对于深度学习的初学者,Pytorch值得推荐。今天主要主要谈谈Pytorch是