Python实现感知器模型、两层神经网络

本文实例为大家分享了Python实现感知器模型、两层神经网络,供大家参考,具体内容如下

python 3.4 因为使用了 numpy

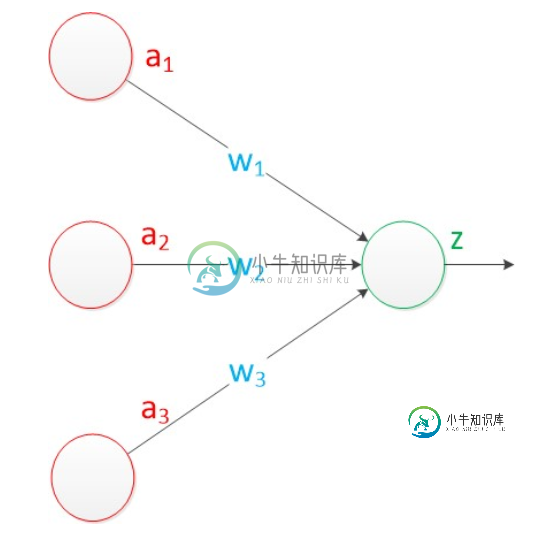

这里我们首先实现一个感知器模型来实现下面的对应关系

[[0,0,1], ——- 0

[0,1,1], ——- 1

[1,0,1], ——- 0

[1,1,1]] ——- 1

从上面的数据可以看出:输入是三通道,输出是单通道。

这里的激活函数我们使用 sigmoid 函数 f(x)=1/(1+exp(-x))

其导数推导如下所示:

L0=W*X;

z=f(L0);

error=y-z;

delta =error * f'(L0) * X;

W=W+delta;

python 代码如下:

import numpy as np

#sigmoid function

def nonlin(x, deriv = False):

if(deriv==True):

return x*(1-x)

return 1/(1+np.exp(-x))

# input dataset

X=np.array([[0,0,1],

[0,1,1],

[1,0,1],

[1,1,1]])

# output dataset

y=np.array([[0,1,0,1]]).T

#seed( ) 用于指定随机数生成时所用算法开始的整数值,

#如果使用相同的seed( )值,则每次生成的随即数都相同,

#如果不设置这个值,则系统根据时间来自己选择这个值,

#此时每次生成的随机数因时间差异而不同。

np.random.seed(1)

# init weight value with mean 0

syn0 = 2*np.random.random((3,1))-1

for iter in range(1000):

# forward propagation

L0=X

L1=nonlin(np.dot(L0,syn0))

# error

L1_error=y-L1

L1_delta = L1_error*nonlin(L1,True)

# updata weight

syn0+=np.dot(L0.T,L1_delta)

print("Output After Training:")

print(L1)

从输出结果可以看出基本实现了对应关系。

下面再用两层网络来实现上面的任务,这里加了一个隐层,隐层包含4个神经元。

import numpy as np

def nonlin(x, deriv = False):

if(deriv == True):

return x*(1-x)

else:

return 1/(1+np.exp(-x))

#input dataset

X = np.array([[0,0,1],

[0,1,1],

[1,0,1],

[1,1,1]])

#output dataset

y = np.array([[0,1,1,0]]).T

#the first-hidden layer weight value

syn0 = 2*np.random.random((3,4)) - 1

#the hidden-output layer weight value

syn1 = 2*np.random.random((4,1)) - 1

for j in range(60000):

l0 = X

#the first layer,and the input layer

l1 = nonlin(np.dot(l0,syn0))

#the second layer,and the hidden layer

l2 = nonlin(np.dot(l1,syn1))

#the third layer,and the output layer

l2_error = y-l2

#the hidden-output layer error

if(j%10000) == 0:

print "Error:"+str(np.mean(l2_error))

l2_delta = l2_error*nonlin(l2,deriv = True)

l1_error = l2_delta.dot(syn1.T)

#the first-hidden layer error

l1_delta = l1_error*nonlin(l1,deriv = True)

syn1 += l1.T.dot(l2_delta)

syn0 += l0.T.dot(l1_delta)

print "outout after Training:"

print l2

以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支持小牛知识库。

-

本文向大家介绍python实现多层感知器,包括了python实现多层感知器的使用技巧和注意事项,需要的朋友参考一下 写了个多层感知器,用bp梯度下降更新,拟合正弦曲线,效果凑合。 效果图: 以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支持呐喊教程。

-

PyTorch包含创建和实现神经网络的特殊功能。在本章中,我们将创建一个简单的神经网络,实现一个隐藏层开发单个输出单元。 我们将使用以下步骤使用PyTorch实现第一个神经网络 - 第1步 首先,需要使用以下命令导入PyTorch库 - 第2步 定义所有图层和批量大小以开始执行神经网络,如下所示 - 第3步 由于神经网络包含输入数据的组合以获得相应的输出数据,使用以下给出的相同程序 - 第4步 借

-

我在读一篇关于卷积神经网络的有趣文章。它显示了这幅图像,解释了对于5x5像素/神经元的每个感受野,计算一个隐藏值的值。 我们可以把max-pooling看作是网络询问给定特征是否在图像区域的任何地方找到的一种方式。然后它就会丢弃精确的位置信息。 因此应用了max-pooling。 我们将对每一个24×24隐藏的神经元使用相同的权重和偏差。 这也适用于隐藏层到池层,。对于max-pool层,它只是数

-

本文向大家介绍python实现多层感知器MLP(基于双月数据集),包括了python实现多层感知器MLP(基于双月数据集)的使用技巧和注意事项,需要的朋友参考一下 本文实例为大家分享了python实现多层感知器MLP的具体代码,供大家参考,具体内容如下 1、加载必要的库,生成数据集 2、定义激活函数 3、定义神经网络 4、运行结果 以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支

-

本文向大家介绍python实现感知器算法详解,包括了python实现感知器算法详解的使用技巧和注意事项,需要的朋友参考一下 在1943年,沃伦麦卡洛可与沃尔特皮茨提出了第一个脑神经元的抽象模型,简称麦卡洛可-皮茨神经元(McCullock-Pitts neuron)简称MCP,大脑神经元的结构如下图。麦卡洛可和皮茨将神经细胞描述为一个具备二进制输出的逻辑门。树突接收多个输入信号,当输入信号累加超过

-

人工神经网络 人工神经网络又叫神经网络,是借鉴了生物神经网络的工作原理形成的一种数学模型。下面是一张生物神经元的图示: 生物神经网络就是由大量神经元构成的网络结构如下图: 生物的神经网络是通过神经元、细胞、触电等结构组成的一个大型网络结构,用来帮助生物进行思考和行动等。那么人们就想到了电脑是不是也可以像人脑一样具有这种结构,这样是不是就可以思考了? 类似于神经元的结构,人工神经网络也是基于这样的神