《tensorflow》专题

-

GPU内存未释放tensorflow

我有一个问题,我的GPU内存是没有释放后关闭在Python中的tenstorflow会话。这三行足以导致问题: 在第三行之后,内存不会被释放。我在很多论坛上走来走去,尝试了各种各样的建议,但都没有效果。有关详细信息,请参见下面我的评论: https://github.com/tensorflow/tensorflow/issues/19731 在这里,我已经记录了我设法杀死进程并释放内存的方法,但

-

在模型执行后清除Tensorflow GPU内存

我已经训练了3个模型,现在正在运行代码,按顺序加载3个检查点中的每一个,并使用它们运行预测。我在用GPU。 当加载第一个模型时,它会预先分配整个GPU内存(我希望用于处理第一批数据)。但它不会在完成时卸载内存。加载第二个模型时,使用第一个型号的GPU内存仍然被完全消耗,第二个型号的内存不足。 除了使用Python子进程或多重处理来解决这个问题(这是我通过谷歌搜索找到的唯一解决方案),还有其他方法可

-

带有keras和tensorflow_插件层的tensorflow模型未加载

我用tensorflow_插件中的keras层和权重标准化层训练了一个模型。这是我以tensorflow文件格式培训和保存的模型: (它没有自定义指标) 但当我加载模型时,它会返回一个错误: ---------------------------------------------------------------------------2中的KeyError回溯(最近一次调用最后一次)返回3-

-

如何解决PyCharm中的TensorFlow错误?

如何解决PyCharm中的TensorFlow错误?tensorflow_安装_测试。派克 以下是输出: 我该如何解决这个问题?

-

在PyCharm插件市场中找不到TensorFlow开发者证书插件

我花钱参加了TensorFlow开发者证书考试,现在我应该把TensorFlow开发者证书插件安装到PyCharm中。我去PyCharm插件搜索“TensorFlow”,但是没有TensorFlow开发者证书插件可用。 PyCharm插件搜索屏幕截图 我安装了四个不同版本的PyCharm,因为我认为这是一个版本问题,但在四个版本中都找不到TensorFlow Developer证书插件: pych

-

tensorflow中的GPU警告

我最近有一个问题与Tensorflow安装,但我解决了它在anaconda导航创建一个虚拟环境。我收到警告说 2020-10-17 13:44:04.120482:W tensorflow/stream_executor/platform/default/dso_loader。cc:55]无法加载动态库“cudart64_101”。dll';错误:cudart64_101。找不到dll 2020-

-

CUDNN_STATUS_NOT_INITIALIZED:为什么Python/PyCharm中的Tensorflow如此挑剔?

每隔一段时间,我就会犯这样的错误 2020-02-26 14:17:31.605963:I tensorflow/stream_执行器/平台/默认/dso_加载器。cc:42]已成功打开动态库libcublas。所以10.0 2020-02-26 14:17:31.829898:I tensorflow/流执行器/平台/默认/dso装载器。cc:42]已成功打开动态库libcudnn。所以7 20

-

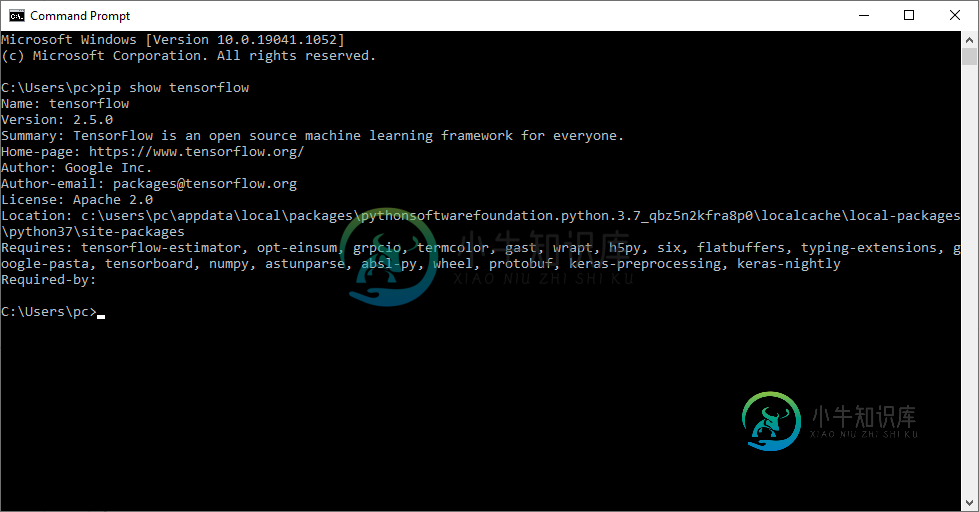

TensorFlow识别图像

TensorFlow识别图像TensorFlow包含图像识别的特殊功能,这些图像存储在特定文件夹中。出于安全目的,经常要识别相同的图像,这个逻辑很容易实现。 图像识别代码实现的文件夹结构如下所示 - dataset_image 文件夹中包含需要加载的相关图像。这里将专注于图像识别,其中定义了徽标。加载“load_data.py”脚本,它记录各种图像识别模块。 图像的训练用于将可识别的图案存储在指定的文件夹中。 上面的代码行生

-

TensorFlow成型图表

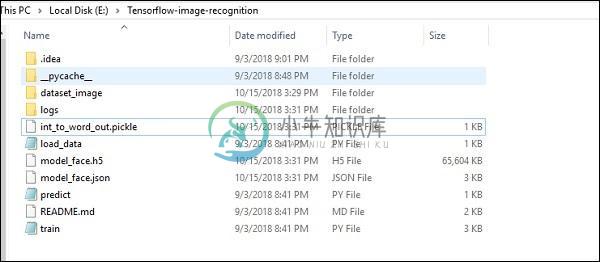

TensorFlow成型图表偏微分方程(PDE)是一个微分方程,它涉及具有几个自变量未知函数的偏导数。参考偏微分方程,我们将专注于创建新的图形。 假设有一个尺寸为平方的池塘 - 现在,将计算偏微分方程并使用它来形成相应的图。考虑下面给出的计算图的步骤。 第1步 - 导入库以进行模拟。 第2步 - 包括用于将2D阵列转换为卷积核的功能和简化的2D卷积运算。 第3步 - 包括迭代次数并计算图形以相应地显示记录。 图表如下图所示

-

TensorFlow梯度下降优化

TensorFlow梯度下降优化梯度下降优化是数据科学中的一个重要概念。考虑下面显示的步骤,以了解梯度下降优化的实现 - 第1步 包括必要的模块和声明和变量,我们将通过它来定义梯度下降优化。 第2步 初始化必要的变量并调用优化器来定义和调用相应的函数。 上面的代码行生成一个输出,如下面的屏幕截图所示 - 可以看到必要的时期和迭代的计算如上面输出中所示。

-

TensorFlow XOR实现

TensorFlow XOR实现在本章中,将了解如何使用TensorFlow来实现XOR。在开始使用TensorFlow中的XOR之前,来看一下XOR表值。这将有助于我们了解加密和解密过程。 A B A XOR B 0 0 0 0 1 1 1 0 1 1 1 0 XOR密码加密方法基本上用于加密难以用强力方法破解的数据,即通过生成与适当密钥匹配的随机加密密钥。 使用XOR Cipher实现的概念是定义XOR加密密钥,然后使用此密

-

TensorFlow优化器

优化器是扩展类,其中包括用于训练特定模型的附加信息。优化器类使用给定的参数进行初始化,但重要的是要记住不需要。优化器用于提高训练特定模型的速度和性能。 TensorFlow的基本优化器是 - 此类在 路径中定义。 以下是Tensorflow中的一些优化器 - 随机梯度下降 随机梯度下降与梯度剪裁 动量 Nesterov动量 Adagrad Adadelta RMSProp Adam Adamax

-

TensorFlow感知器隐藏层

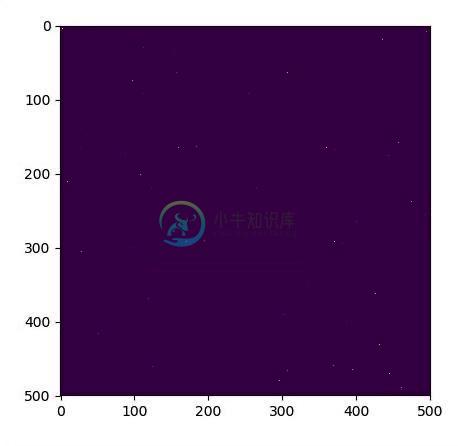

TensorFlow感知器隐藏层在本章中将重点关注我们将要从已知的一组点和中学习的网络。单个隐藏层将构建这个简单的网络。 用于解释感知器隐藏层的代码如下所示 - 以下是功能层近似的表示(输出) - 这里有两个数据以W的形状表示。两个数据是:train和validation,它们在图例中的不同颜色表示。

-

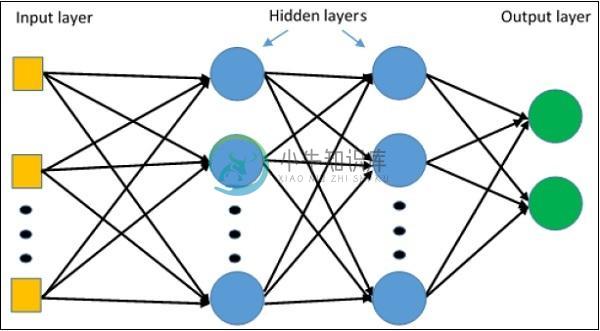

TensorFlow多层感知器学习

TensorFlow多层感知器学习多层感知器定义了人工神经网络最复杂的架构,它基本上由多层感知器构成。多层感知器学习的图示如下所示 - MLP网络通常用于监督学习格式。MLP网络的典型学习算法也称为反向传播算法。现在,我们将专注于使用MLP实现图像分类问题。 上面的代码行生成以下输出 -

-

TensorFlow导出

在这里,将重点关注和学习TensorFlow中的形成。这有助于了解TensorFlow中的导出模块。包含基本信息,这些信息是对先前训练过的图表进行训练,执行评估或运行推理所必需的。 以下是相同的代码片段 - 下面是一个典型的使用模型 -