《tensorflow》专题

-

Tensorflow,在RNN中保存状态的最佳方法?

问题内容: 我目前在tensorflow中具有一系列链接在一起的RNN的以下代码。我不使用MultiRNN,因为稍后我将对每个图层的输出进行处理。 目前,我有固定的时间步数。但是,我想将其更改为只有一个时间步长,但要记住批次之间的状态。因此,我需要为每个层创建一个状态变量,并将其分配给每个层的最终状态。这样的事情。 然后,对于每一层,我都需要评估sess.run函数中的保存状态以及调用训练函数

-

在Tensorflow中,获取图中所有张量的名称

问题内容: 我正在使用和创建神经网络;由于某种原因,我想获得某种内在的张量的值给定的输入,所以我使用的,作为一个。 但是,我发现很难找到张量名称的正确语法,即使知道它的名称也很困难(而且我对操作和张量感到困惑),因此我使用张量板绘制图形并寻找名称。 有没有一种方法可以在不使用张量板的情况下枚举图中的所有张量? 问题答案: 你可以做 另外,如果您要在IPython笔记本中进行原型制作,则可以直接在笔

-

解决tensorflow/keras时出现数组维度不匹配问题

本文向大家介绍解决tensorflow/keras时出现数组维度不匹配问题,包括了解决tensorflow/keras时出现数组维度不匹配问题的使用技巧和注意事项,需要的朋友参考一下 一、环境 Ubuntu 16.04 tensorflow 1.4.0 keras 2.1.3 二、训练数据时报错: ValueError: Error when checking target: expected m

-

Tensorflow:如何替换计算图中的节点?

问题内容: 如果您有两个不相交的图,并且想要链接它们,请执行以下操作: 到这个: 有没有办法做到这一点?在某些情况下,这似乎可以使施工更容易。 例如,如果您有一个图,其输入图像为,并且想要优化输入图像(深梦风格),是否有一种方法可以仅用节点替换占位符?还是在构建图形之前必须考虑一下? 问题答案: TL; DR:如果可以将这两个计算定义为Python函数,则应该这样做。如果不能,那么TensorFl

-

Tensorflow:如何通过名称获取张量?

问题内容: 我无法按名称恢复张量,我什至不知道是否可能。 我有一个创建图的函数: 我想在此函数之外访问变量S1_conv1。我试过了: 但这给了我一个错误: ValueError:共享不足:不允许使用变量scale_1 / Scale1_first_relu。您是说要在VarScope中设置“ reuse = None”? 但这有效: 我可以解决这个问题 但我不想那样做。 我认为我的问题是S1_c

-

TensorFlow仅在提供的训练数据的1/32上运行

问题内容: 我使用张量流实现了一个神经网络,它似乎仅在1/32数据点上运行。然后,我尝试按照以下简单示例查看是否是我: https://pythonprogramming.net/introduction-deep-learning-python-tensorflow- keras/ 即使使用相同的(复制和粘贴的)代码,我仍然可以获得正在处理的训练数据的1/32,例如 而不是示例提供的以下内容:

-

我如何使用TensorFlow GPU?

问题内容: 如何在Python 3.6 x64中使用 TensorFlow GPU 版本而不是 CPU 版本? Python正在使用我的 CPU 进行计算。 我可以注意到它,因为我有一个错误: 您的CPU支持该TensorFlow二进制文件未编译为使用的指令:AVX2 我已经安装了tensorflow和tensorflow-gpu。 如何切换到GPU版本? 问题答案: 遵循本教程Tensorflo

-

Tensorflow Summary用法学习笔记

本文向大家介绍Tensorflow Summary用法学习笔记,包括了Tensorflow Summary用法学习笔记的使用技巧和注意事项,需要的朋友参考一下 最近在研究tensorflow自带的例程speech_command,顺便学习tensorflow的一些基本用法。 其中tensorboard 作为一款可视化神器,可以说是学习tensorflow时模型训练以及参数可视化的法宝。 而在训练过

-

TENSORFLOW变量作用域(VARIABLE SCOPE)

本文向大家介绍TENSORFLOW变量作用域(VARIABLE SCOPE),包括了TENSORFLOW变量作用域(VARIABLE SCOPE)的使用技巧和注意事项,需要的朋友参考一下 举例说明 TensorFlow中的变量一般就是模型的参数。当模型复杂的时候共享变量会无比复杂。 官网给了一个case,当创建两层卷积的过滤器时,每输入一次图片就会创建一次过滤器对应的变量,但是我们希望所有图片都共

-

Tensorflow未在windows和pycharm上运行

我试图使我的第一次尝试与Tensorflow使用Windows 8.1和Py魅力,但我得到一个Tensorflow错误。 我还使用pip在虚拟环境中安装了所有东西,并在命令行中运行了代码,得到了相同的结果。 有些事我试过了 > 还找到了与降级到python 3.5相关的信息。我实际上使用的是Python 3.7,不想降级。我担心其他应用程序无法工作。有人能确认它不能与大于3.5的Python一起工

-

在PyCharm(Windows 10)中恢复到TensorFlow的旧Cuda版本的问题

一直在尝试访问Tensorflow 2.3中的Cuda。1(通过PyCharm)访问我的兼容GPU进行对象检测。TensorFlow以前是工作的,但当我安装Cuda时,我意识到它是11.1版本——TensorFlow有Cuda 10.1的先决条件。我的计算机上有这两个版本,并尝试使用Windows添加/删除工具(推荐)卸载所有11.1工具包。这似乎在删除11.1时起作用,但是,当我尝试将Tenso

-

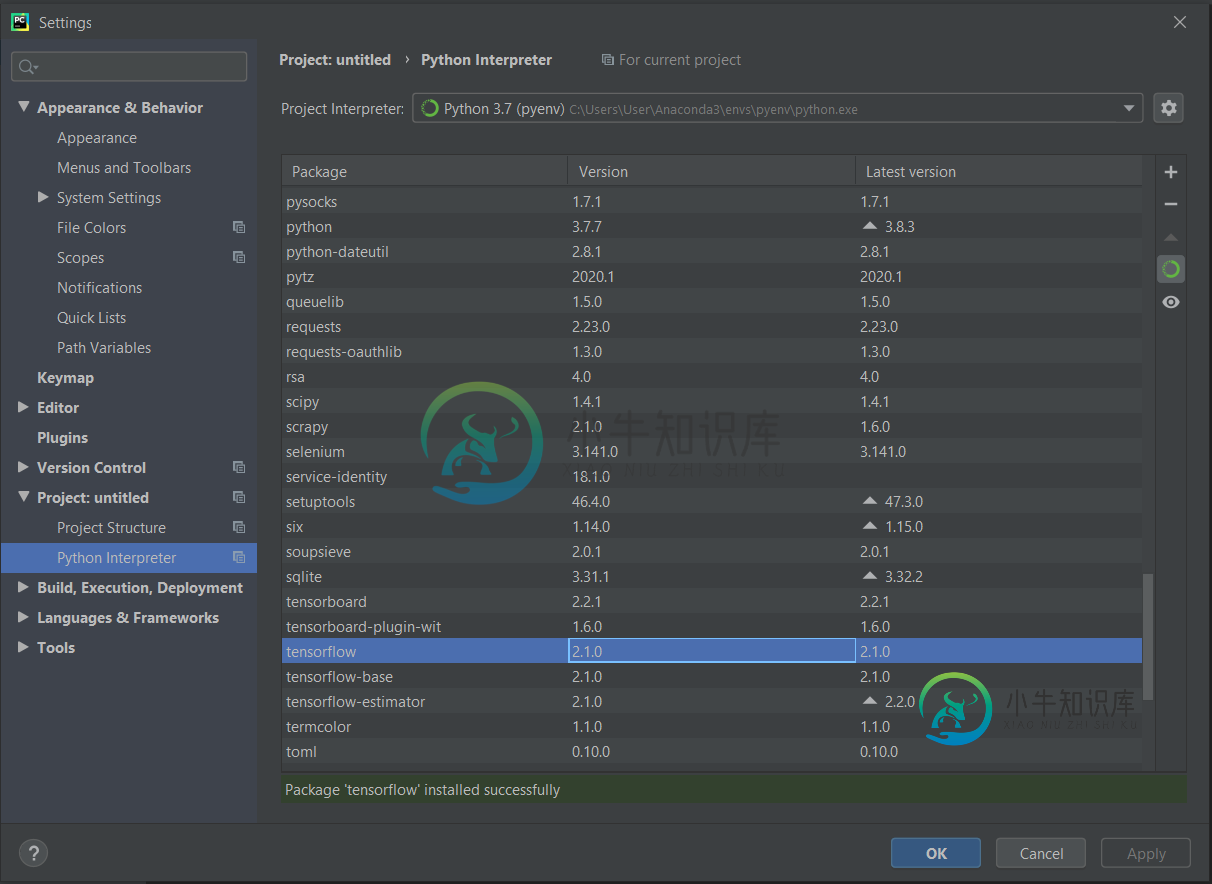

无法在PyCharm上安装Tensorflow

无法在PyCharm上安装Tensorflow我试图在PyCharm上安装TensorFlow

-

我无法让Tensorflow 2.0在我的GPU上运行

我一直在我的电脑上用Tensorflow写程序,它使用Linux薄荷。无论出于什么原因,我都无法让Tensorflow在我的图形处理器上运行。 2021-04-26 15:46:11.462612: W tenstorflow/stream_executor/平台/默认/dso_loader.cc:60]无法加载动态库'libcudart.so.11.0';libcudart.so.11.0:无法

-

Tensorflow GPU内存分配

我正在尝试使用我的GPU而不是CPU来训练一个自定义的对象检测模型。我遵循了以下教程中给出的所有说明:https://tensorflow-object-detection-api-tutorial.readthedocs.io/ 我已经测试了我的软件,一切都已安装并正常工作。 目前正在使用: Windows 10 但问题是,在训练几秒钟后,它停止使用GPU,并发出以下警告消息。 此外,我没有在我

-

Keras、Tensorflow将在模型构建时保留所有GPU内存

我的GPU是NVIDIA RTX 2080 TI Keras 2.2。4. Tensorflow gpu 1.12。0 CUDA 10.0 一旦我加载构建模型(编译前),我发现GPU内存被完全分配 [0]GeForce RTX 2080钛合金50℃下,15%钛合金10759/10989 MB钛合金issd/8067(10749米) 可能是什么原因,我如何调试它? 即使通过生成器加载,我也没有多余的