《反卷时代》专题

-

keras如何管理卷积层的权重?

我正在使用MNIST数据集,我正在使用keras来训练卷积神经网络。关于权重矩阵,有些东西我不明白。 输入层有28x28=784个神经元。然后我使用: 在我训练模型后,把W=模型。get\u weights(),I打印W[I]。每个i的形状并获得: 据我所知,这意味着对于第一个隐藏层有32个8x8=64的图像(因为(28-7)/3 1=8)因此第一个隐藏层中有64x32=2048个神经元。 下一部

-

计算卷积层中的输出大小

如果输入到神经网络卷积层的是128x128x3大小的图像,并对其应用40个5x5大小的滤波器,那么输出大小会是多少?

-

卷积神经网络的分层训练

是否有方法按层(而不是端到端)训练卷积神经网络,以了解每一层对最终架构性能的贡献?

-

CUDA小内核二维卷积--怎么做

我如何用CUDA在一个相对较大的图像和一个非常小的内核(3x3)之间执行快速的2D卷积?

-

禁止狂饮7 - 403(适用于卷发)

更新:似乎用户代理并不是某些主机提供HTML所需的唯一标头,我还必须添加“accepts”标头,最终这为我解决了许多主机的问题: 我试图使用Guzzle来检索一些网站,但收到了403禁止错误(当它们在浏览器中工作正常时),我怀疑这是由于主机禁止了非标准的用户代理。为了解决这个问题,我试图在Guzzle中设置用户代理来模仿浏览器,但是我找不到任何有效的方法。我可以浏览网站,也可以使用WGET和CUR

-

如何备份Docker-container及其数据卷?

我一直在使用这个Docker-image Tutum/Wordpress来演示一个Wordpress网站。最近,我发现该映像使用了mysql数据的卷。 所以问题是这样的:如果我想备份和恢复容器,我可以尝试提交一个映像,然后删除容器,并从提交的映像创建一个新的容器。但如果我这样做了,卷就会被删除,我的所有数据都没有了。 一定有一些简单的方法来备份我的容器加上它的卷数据,但我在任何地方都找不到。

-

如何安装docker卷与jenkins docker容器?

我让jenkins在github上的容器和项目源代码中运行。 我需要在与jenkins相同的主机上运行容器中的项目,但不是作为docker中的docker,我希望将它们作为兄弟容器运行。 我的管道如下所示: 从github中提取源文件 我现在要做的是使用jenkins容器中主机的docker套接字: jenkins容器将源代码为/var/jenkins_home/workspace/BRANCH_

-

如何使用卷曲执行PUT请求?

如何使用curl测试RESTful PUT(或DELETE)方法?

-

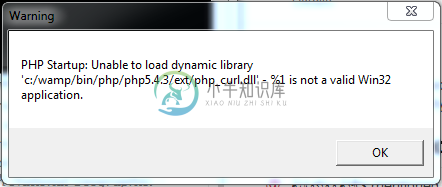

卷曲在 5.4.3 的 5.4.3 上不起作用

卷曲在 5.4.3 的 5.4.3 上不起作用我使用的wamp服务器安装了php 5.4.3版,并启用了curl扩展,编辑了php。ini文件取消对curl扩展行的注释,但问题是,当我尝试使用控制台安装composer时,它会给我一条消息,显示“PHP Startup:cannotable to load dynamic library'c:/wamp/bin/PHP/php5.4.3/ext/PHP_curl.dll”,这是它的屏幕截图 我

-

共享卷/文件权限/所有权(Docker)

我在使用Docker容器时遇到了一个有点烦人的问题(我使用的是Ubuntu,所以没有像VMWare或b2d这样的虚拟化)。我已经构建了我的映像,并且有一个正在运行的容器,其中有一个来自主机的共享(装入)目录和一个来自主机的共享(装入)文件。以下是命令的全文: 注意:许多用于编辑文件的工具,包括vi和sed--in-place可能会导致inode更改。从Docker V1.1.0开始,这将产生一个错

-

如何在卷中装入单个文件

我正在尝试对接一个PHP应用程序。在dockerfile中,我下载归档文件,解压缩文件,等等。 一切正常。但是,如果发布了一个新版本,并且我更新了dockerfile,我就必须重新安装应用程序,因为config.php会被覆盖。 所以我想我可以将文件装入一个卷,就像我对数据库所做的那样。 然而,这两种方式都行不通。有了装入的卷,我看到上传被创建了。 但它失败的原因是: /var/www/html/

-

将卷安装到OSX上的Docker映像

我得到了 我觉得我错过了一些极其简单的东西,但我却无法完全弄明白。如有任何帮助,将不胜感激。

-

第4章 OpenCL案例 - 4.4 图像卷积

卷积在图像处理中经常用到,其会根据每个像素周围的像素点修改当前像素点的值。卷积核就是用来描述每个像素点如何被附近的像素点所影响。例如,模糊滤波中,使用平均的权重方式来进行计算,这样差异比较大的像素点会减少差异。对于相同的图像,如果想要做不同的操作,我们只需要变化滤波器即可,这样就能做锐化、模糊、边缘增强和图像压花。 卷积算法会遍历原始图像中的每一个像素点。对于每个原始像素点,滤波器中心点会为于像素

-

14.3 逻辑卷轴管理员 (Logical Volume Manager)

14.3 逻辑卷轴管理员 (Logical Volume Manager) 想像一个情况,你在当初规划主机的时候将 /home 只给他 50G ,等到使用者众多之后导致这个 filesystem 不够大, 此时你能怎么作?多数的朋友都是这样:再加一颗新硬盘,然后重新分区、格式化,将 /home 的数据完整的复制过来, 然后将原本的 partition 卸载重新挂载新的 partition 。啊!好

-

卷积神经网络(CNN)模型结构

首先我们来看看CNN的基本结构。一个常见的CNN例子如下图: 图中是一个图形识别的CNN模型。可以看出最左边的船的图像就是我们的输入层,计算机理解为输入若干个矩阵,这点和DNN基本相同。 接着是卷积层(Convolution Layer),这个是CNN特有的,我们后面专门来讲。卷积层的激活函数使用的是ReLU。我们在DNN中介绍过ReLU的激活函数,它其实很简单,就是$$ReLU(x) = max