《音视频》专题

-

用于音频和视频的Gstreamer rtsp应用程序

我试图为管道开发一个应用程序: gst-launch-1.0 rtspsrc位置=”rtsp://192.168.3.30:8554/rajvi“延迟=0 name=demux demux。!queue!rtpmp4gdepay!aacparse!avdec\u aac!audioconvert!audioresample!autoaudiosink demux。!queue!rtph264dep

-

如何加入一个音频和视频文件-Xuggler

问题内容: 我想使用Xuggler 将无音频的视频文件与音频文件合并。此刻,我已经采取了两个流,并将这些流的视频和音频部分分别合并为画中画。现在,我想将音频和视频文件相互组合。任何建议或提示将不胜感激。我正在使用red5服务器。谢谢。 问题答案: 使用MediaConcatenator。请参见示例代码“连接音频和视频”

-

如何使用MediaCodec和MediaMuxer录制视频和音频

我能够在MediaCodec和MediaMuxer的帮助下录制(编码)视频。接下来,我需要在MediaCodec和MediaMuxer的帮助下处理音频部分和带视频的mux音频。 我面临两个问题: > 如何将音频和视频数据传递给MediaMuxer(因为writeSampleData()方法一次只接受一种类型的数据)? 我提到了MediaMuxerTest,但它使用的是MediaExtractor。

-

Android:使用MediaCodec对音频和视频进行编码

我正在尝试使用MediaCodec和MediaMuxer对来自相机的视频和来自麦克风的音频进行编码。我在录制时使用OpenGL在图像上覆盖文本。 我以这些课程为例: http://bigflake.com/mediacodec/CameraToMpegTest.java.txt https://github.com/OnlyInAmerica/HWEncoderExperiments/blob/m

-

如何使用多音频流的mpv播放视频

我试着用两种语言播放一部电影。音频1至扬声器音频2至耳机 播放视频并混合音频1 用audio1播放视频 仅播放音频2 如何结合这一点?

-

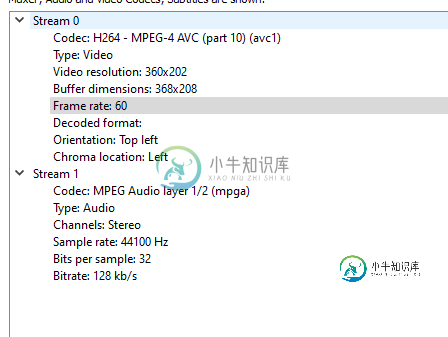

调整视频大小时出现音频问题-moviepy

调整视频大小时出现音频问题-moviepy我正在使用以下代码调整mp4视频的大小(moviepy): 当我在电脑上播放时,调整大小的剪辑的音频可以工作,但在iPhone上不行。(原始剪辑的音频确实适用于我的iPhone。) 我怎样才能解决这个问题? 第一幅图像:已调整大小的视频的编解码器 第二幅图像:原始视频的编解码器

-

ExoPlayer:使用视频文件在后台播放声音

播放视频,当应用程序转到后台时,它应继续播放音频,当我重新打开时,它应恢复有关我们在音频中的位置的视频。 我在一个服务中使用exoplayer,我可以在后台播放音频,但当我对视频执行相同操作时,音频正在播放,但当我回到应用程序时,视频只是一个黑屏,如果我再次重复(转到后台并回到应用程序)该步骤,它将继续播放视频。 据我所知,exoplayer正在缓冲下一帧,播放器视图无法一次渲染所有帧。 我有一个

-

利用AutoGen FFmpeg库实现MP4音频/视频同步

我目前有问题,使我的音频和视频流保持同步。 以下是我正在使用的AVCodecContexts: 视频: 这演奏得很完美。 然而,当我对音频做同样的操作时,视频以慢动作播放,首先播放音频,然后在没有声音的情况下继续播放视频。 我找不到任何地方的例子如何设置PTS/DTS位置的视频/音频在MP4文件。任何帮助的例子都将是伟大的! 而且,我首先写视频帧,然后(一旦它们都写好了)我写音频。我已经用注释中建

-

FFMPEG:不带filter_complex连接视频文件(包含音频)

我在尝试连接FFMPEG中的多个文件时遇到了一个问题;我的目标是通过串联不同类型的幻灯片来创建视频演示文稿: (a)图像幻灯片,通过循环帧片刻转换成视频。这些类型的幻灯片没有音频,所以我为它们添加了静音音轨: (b)视频幻灯片,它有一个覆盖的水印,并持续到视频结束。如果文件不包含音频,则添加的方式与前面的情况相同: 因此,一旦我有了所有生成的文件和一个包含所有文件名的。txt文件,我想使用简单的命

-

在回收站中播放和释放音频视图

我正在学习Android和目前的回收器视图,所以在这个例子中,我在单击播放按钮时播放特定的原始声音文件,然后在完成后释放它。我可以认真地使用一些关于最佳实践的指针,但是因为我有一些问题和疑问: 我有一个过渡状态的问题,所以如果我按播放非常快,我会得到一个IllegalStateException,可能是因为试图释放一个已经发布的播放器。 显然,我也应该在发布后nullify并在之前进行null检查

-

在 After Effects 中导入和解释视频与音频

隔行视频和分离场 隔行是针对使用有限带宽传送电视信号而开发的一种技术。在隔行系统中,每次只传送每个视频帧的一半水平行数。由于传送速度、显示器余辉和视觉暂留方面的原因,查看器以完全分辨率感知每个帧。所有模拟电视标准都使用隔行技术。数字电视标准同时包括隔行和非隔行模式。通常,从隔行扫描生成隔行信号,从逐行扫描生成非隔行信号。 每个隔行视频帧由两个场组成。每个场包含帧中的一半水平行数,高场(或场 1)包

-

24/4/2_快手音视频测开实习_面试

24/4/2_快手音视频测开实习_面试1.自我介绍 2.为什么投测开? 3.介绍项目?难点?怎么解决?怎么测试? 4.手撕代码,求数组中所有数的最大组合 5.写测试用例,本地上传文件到服务器 6.问了些ffmpeg 7.视频出现花帧,怎么测试? 8.常用的Linux命令 9.I帧、P帧、B帧都是啥? 10.自己的优缺点

-

php利用ffmpeg提取视频中音频与视频画面的方法详解

本文向大家介绍php利用ffmpeg提取视频中音频与视频画面的方法详解,包括了php利用ffmpeg提取视频中音频与视频画面的方法详解的使用技巧和注意事项,需要的朋友参考一下 前言 FFmpeg的名称来自MPEG视频编码标准,前面的“FF”代表“Fast Forward”,FFmpeg是一套可以用来记录、转换数字音频、视频,并能将其转化为流的开源计算机程序。可以轻易地实现多种视频格式之间的相互转换

-

如何使Admob中的间隙视频广告和有奖视频广告静音?

代码: 问题: 有时Admob加载带有视频的间隙广告,默认情况下该广告的音量设置为最大,有什么方法可以使其静音吗? 还有奖励视频广告,我找不到任何选项使广告静音,有人能帮忙吗?

-

如何使用MLT从给定的视频文件中分离音频和视频?

我想从给定的输入视频文件中拆分和。在网上冲浪后,我了解到使用是可能的。我打算在中实现上述功能。在ffmpeg中有很多构建过程,所以我更喜欢或任何其他可用的包。请任何人指导我如何使用或任何其他可用的框架来实现这些概念。 给定的输入视频文件(包含音频和视频) 预期的输出视频文件(只包含视频而不包含音频)