基于python的BP神经网络及异或实现过程解析

BP神经网络是最简单的神经网络模型了,三层能够模拟非线性函数效果。

难点:

- 如何确定初始化参数?

- 如何确定隐含层节点数量?

- 迭代多少次?如何更快收敛?

- 如何获得全局最优解?

'''

neural networks

created on 2019.9.24

author: vince

'''

import math

import logging

import numpy

import random

import matplotlib.pyplot as plt

'''

neural network

'''

class NeuralNetwork:

def __init__(self, layer_nums, iter_num = 10000, batch_size = 1):

self.__ILI = 0;

self.__HLI = 1;

self.__OLI = 2;

self.__TLN = 3;

if len(layer_nums) != self.__TLN:

raise Exception("layer_nums length must be 3");

self.__layer_nums = layer_nums; #array [layer0_num, layer1_num ...layerN_num]

self.__iter_num = iter_num;

self.__batch_size = batch_size;

def train(self, X, Y):

X = numpy.array(X);

Y = numpy.array(Y);

self.L = [];

#initialize parameters

self.__weight = [];

self.__bias = [];

self.__step_len = [];

for layer_index in range(1, self.__TLN):

self.__weight.append(numpy.random.rand(self.__layer_nums[layer_index - 1], self.__layer_nums[layer_index]) * 2 - 1.0);

self.__bias.append(numpy.random.rand(self.__layer_nums[layer_index]) * 2 - 1.0);

self.__step_len.append(0.3);

logging.info("bias:%s" % (self.__bias));

logging.info("weight:%s" % (self.__weight));

for iter_index in range(self.__iter_num):

sample_index = random.randint(0, len(X) - 1);

logging.debug("-----round:%s, select sample %s-----" % (iter_index, sample_index));

output = self.forward_pass(X[sample_index]);

g = (-output[2] + Y[sample_index]) * self.activation_drive(output[2]);

logging.debug("g:%s" % (g));

for j in range(len(output[1])):

self.__weight[1][j] += self.__step_len[1] * g * output[1][j];

self.__bias[1] -= self.__step_len[1] * g;

e = [];

for i in range(self.__layer_nums[self.__HLI]):

e.append(numpy.dot(g, self.__weight[1][i]) * self.activation_drive(output[1][i]));

e = numpy.array(e);

logging.debug("e:%s" % (e));

for j in range(len(output[0])):

self.__weight[0][j] += self.__step_len[0] * e * output[0][j];

self.__bias[0] -= self.__step_len[0] * e;

l = 0;

for i in range(len(X)):

predictions = self.forward_pass(X[i])[2];

l += 0.5 * numpy.sum((predictions - Y[i]) ** 2);

l /= len(X);

self.L.append(l);

logging.debug("bias:%s" % (self.__bias));

logging.debug("weight:%s" % (self.__weight));

logging.debug("loss:%s" % (l));

logging.info("bias:%s" % (self.__bias));

logging.info("weight:%s" % (self.__weight));

logging.info("L:%s" % (self.L));

def activation(self, z):

return (1.0 / (1.0 + numpy.exp(-z)));

def activation_drive(self, y):

return y * (1.0 - y);

def forward_pass(self, x):

data = numpy.copy(x);

result = [];

result.append(data);

for layer_index in range(self.__TLN - 1):

data = self.activation(numpy.dot(data, self.__weight[layer_index]) - self.__bias[layer_index]);

result.append(data);

return numpy.array(result);

def predict(self, x):

return self.forward_pass(x)[self.__OLI];

def main():

logging.basicConfig(level = logging.INFO,

format = '%(asctime)s %(filename)s[line:%(lineno)d] %(levelname)s %(message)s',

datefmt = '%a, %d %b %Y %H:%M:%S');

logging.info("trainning begin.");

nn = NeuralNetwork([2, 2, 1]);

X = numpy.array([[0, 0], [1, 0], [1, 1], [0, 1]]);

Y = numpy.array([0, 1, 0, 1]);

nn.train(X, Y);

logging.info("trainning end. predict begin.");

for x in X:

print(x, nn.predict(x));

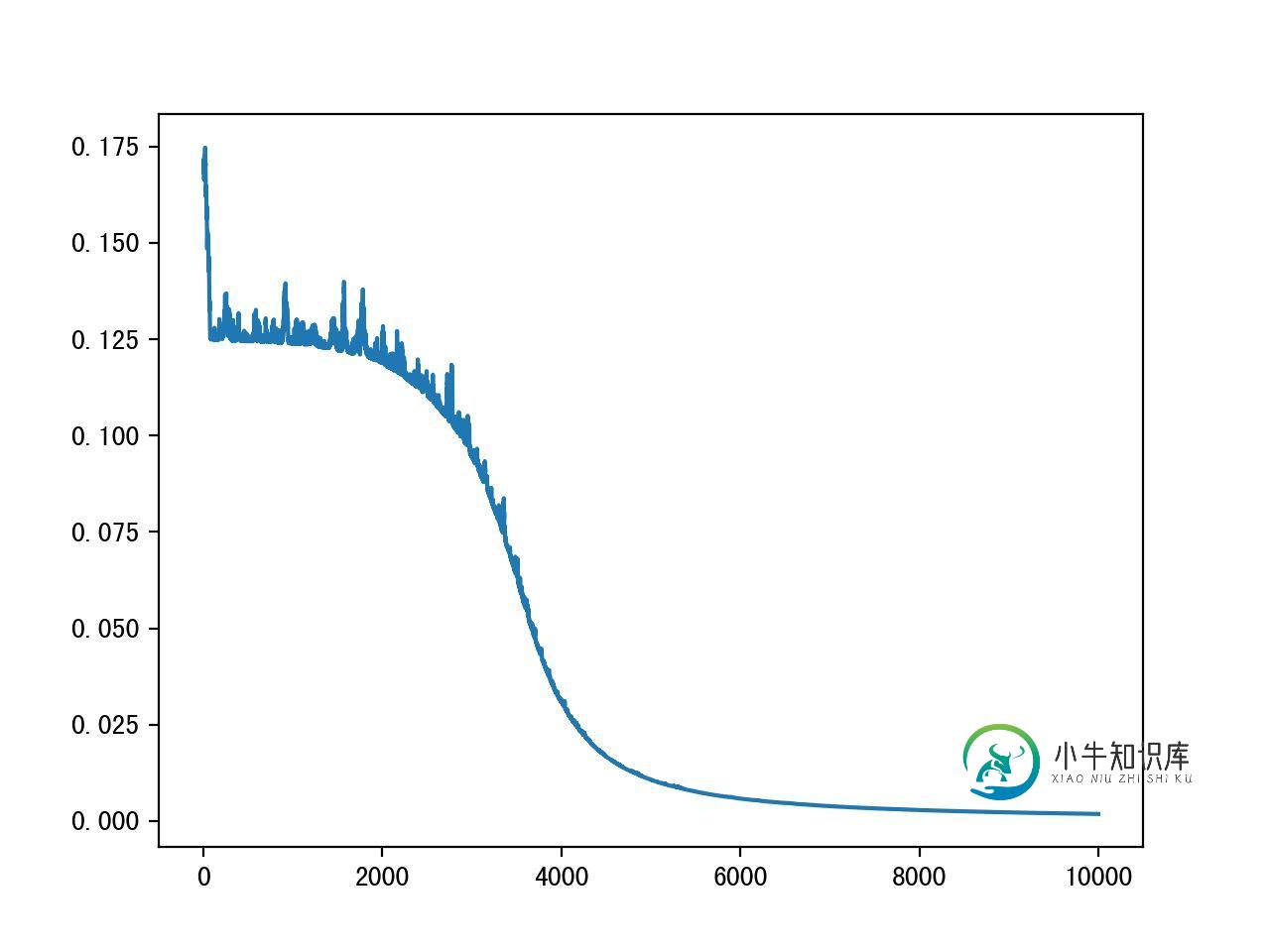

plt.plot(nn.L)

plt.show();

if __name__ == "__main__":

main();

具体收敛效果

以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支持小牛知识库。

-

本文向大家介绍神经网络(BP)算法Python实现及应用,包括了神经网络(BP)算法Python实现及应用的使用技巧和注意事项,需要的朋友参考一下 本文实例为大家分享了Python实现神经网络算法及应用的具体代码,供大家参考,具体内容如下 首先用Python实现简单地神经网络算法: 使用自己定义的神经网络算法实现一些简单的功能: 小案例: X: Y 0 0

-

我已经实现了下面的神经网络来解决Python中的异或问题。我的神经网络由3个神经元的输入层、1个2个神经元的隐层和1个神经元的输出层组成。我使用Sigmoid函数作为隐藏层和输出层的激活函数: backpropogation似乎是正确的,但我一直得到这个错误,所有的值都变成了“nan”,输出: 你能帮我解决这个问题吗?谢谢你。

-

PyTorch包含创建和实现神经网络的特殊功能。在本章中,我们将创建一个简单的神经网络,实现一个隐藏层开发单个输出单元。 我们将使用以下步骤使用PyTorch实现第一个神经网络 - 第1步 首先,需要使用以下命令导入PyTorch库 - 第2步 定义所有图层和批量大小以开始执行神经网络,如下所示 - 第3步 由于神经网络包含输入数据的组合以获得相应的输出数据,使用以下给出的相同程序 - 第4步 借

-

本文向大家介绍tensorflow构建BP神经网络的方法,包括了tensorflow构建BP神经网络的方法的使用技巧和注意事项,需要的朋友参考一下 之前的一篇博客专门介绍了神经网络的搭建,是在python环境下基于numpy搭建的,之前的numpy版两层神经网络,不能支持增加神经网络的层数。最近看了一个介绍tensorflow的视频,介绍了关于tensorflow的构建神经网络的方法,特此记录。

-

本文向大家介绍Python实现的径向基(RBF)神经网络示例,包括了Python实现的径向基(RBF)神经网络示例的使用技巧和注意事项,需要的朋友参考一下 本文实例讲述了Python实现的径向基(RBF)神经网络。分享给大家供大家参考,具体如下: 更多关于Python相关内容感兴趣的读者可查看本站专题:《Python数据结构与算法教程》、《Python编码操作技巧总结》、《Python函数使用技巧

-

人工神经网络指由大量的神经元互相连接而形成的复杂网络结构。以人的视觉系统为例,人的视觉系统的信息处理是分级的,高层的特征是低层特征的组合,从低层到高层的特征表示越来越抽象,越来越能表达语义或者意图。人工神经网络提出最初的目的是为了模拟生物神经网络传递和处理信息的功能。它按照一定规则将许多神经元连接在一起,并行的处理外接输入信息。人工神经网络的每一层都有若干神经元并用可变权重的有向弧连接,具体训练过程是通过多次迭代对已知信息的反复学习并调整改变神经元的连接权重。