Spark MLlib随机梯度下降法概述与实例

机器学习算法中回归算法有很多,例如神经网络回归算法、蚁群回归算法,支持向量机回归算法等,其中也包括本篇文章要讲述的梯度下降算法,本篇文章将主要讲解其基本原理以及基于Spark MLlib进行实例示范,不足之处请多多指教。

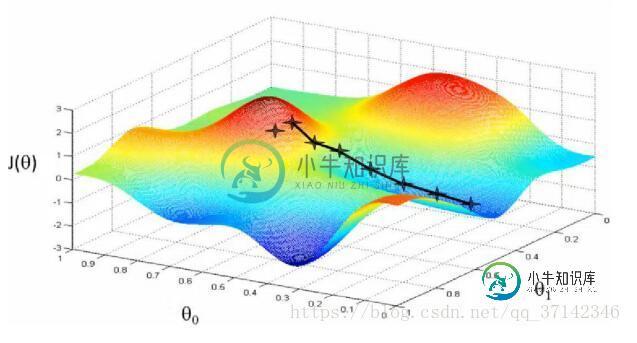

梯度下降算法包含多种不同的算法,有批量梯度算法,随机梯度算法,折中梯度算法等等。对于随机梯度下降算法而言,它通过不停的判断和选择当前目标下最优的路径,从而能够在最短路径下达到最优的结果。我们可以在一个人下山坡为例,想要更快的到达山低,最简单的办法就是在当前位置沿着最陡峭的方向下山,到另一个位置后接着上面的方式依旧寻找最陡峭的方向走,这样每走一步就停下来观察最下路线的方法就是随机梯度下降算法的本质。

随机梯度下降算法理论基础

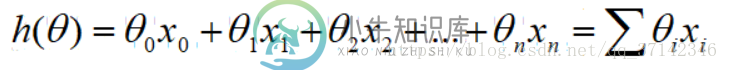

在线性回归中,我们给出回归方程,如下所示:

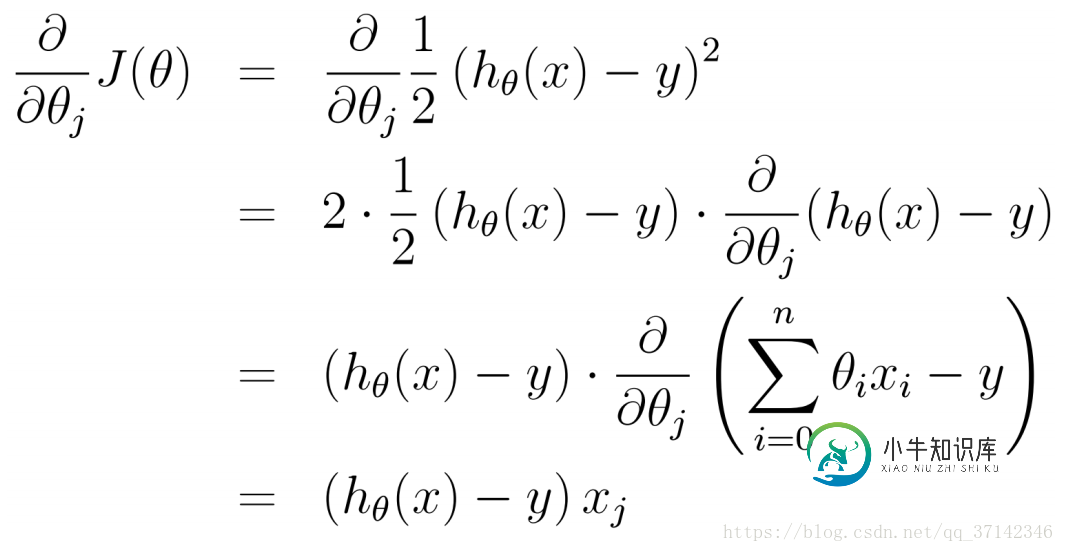

我们知道,对于最小二乘法要想求得最优变量就要使得计算值与实际值的偏差的平方最小。而随机梯度下降算法对于系数需要通过不断的求偏导求解出当前位置下最优化的数据,那么梯度方向公式推导如下公式,公式中的θ会向着梯度下降最快的方向减少,从而推断出θ的最优解。

因此随机梯度下降法的公式归结为通过迭代计算特征值从而求出最合适的值。θ的求解公式如下。

α是下降系数,即步长,学习率,通俗的说就是计算每次下降的幅度的大小,系数越大每次计算的差值越大,系数越小则差值越小,但是迭代计算的时间也会相对延长。θ的初值可以随机赋值,比如下面的例子中初值赋值为0。

Spark MLlib随机梯度下降算法实例

下面使用Spark MLlib来迭代计算回归方程y=2x的θ最优解,代码如下:

package cn.just.shinelon.MLlib.Algorithm import java.util import scala.collection.immutable.HashMap /** * 随机梯度下降算法实战 * 随机梯度下降算法:最短路径下达到最优结果 * 数学表达公式如下: * f(θ)=θ0x0+θ1x1+θ2x2+...+θnxn * 对于系数要通过不停地求解出当前位置下最优化的数据,即不停对系数θ求偏导数 * 则θ求解的公式如下: * θ=θ-α(f(θ)-yi)xi * 公式中α是下降系数,即每次下降的幅度大小,系数越大则差值越小,系数越小则差值越小,但是计算时间也相对延长 */ object SGD { var data=HashMap[Int,Int]() //创建数据集 def getdata():HashMap[Int,Int]={ for(i <- 1 to 50){ //创建50个数据集 data += (i->(2*i)) //写入公式y=2x } data //返回数据集 } var θ:Double=0 //第一步 假设θ为0 var α:Double=0.1 //设置步进系数 def sgd(x:Double,y:Double)={ //随机梯度下降迭代公式 θ=θ-α*((θ*x)-y) //迭代公式 } def main(args: Array[String]): Unit = { val dataSource=getdata() //获取数据集 dataSource.foreach(myMap=>{ //开始迭代 sgd(myMap._1,myMap._2) //输入数据 }) println("最终结果值θ为:"+θ) } }

需要注意的是随着步长系数增大以及数据量的增大,θ值偏差越来越大。同时这里也遗留下一个问题,当数据量大到一定程度,为什么θ值会为NaN,笔者心中有所疑惑,如果哪位大佬有想法可以留言探讨,谢谢!

以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支持小牛知识库。

-

本文向大家介绍随机梯度下降法?相关面试题,主要包含被问及随机梯度下降法?时的应答技巧和注意事项,需要的朋友参考一下 最小化每个样本的损失函数,迭代更新更快,但总体上是朝着整体最优前进的,与批量梯度下降的关系: 牛顿法 利用损失函数的二阶导数,收敛更快,不再是限于当前歩最优,有了往后看的整体概念,不过也没有整体的概念,只是在局部上更加细致,不过计算比较复杂,因为需要求解海森矩阵的逆矩阵比较复杂

-

在本节中,我们将介绍梯度下降(gradient descent)的工作原理。虽然梯度下降在深度学习中很少被直接使用,但理解梯度的意义以及沿着梯度反方向更新自变量可能降低目标函数值的原因是学习后续优化算法的基础。随后,我们将引出随机梯度下降(stochastic gradient descent)。 一维梯度下降 我们先以简单的一维梯度下降为例,解释梯度下降算法可能降低目标函数值的原因。假设连续可导

-

校验者: @A 翻译者: @L 校验者: @HelloSilicat @A 翻译者: @L 随机梯度下降(SGD) 是一种简单但又非常高效的方法,主要用于凸损失函数下线性分类器的判别式学习,例如(线性) 支持向量机 和 Logistic 回归 。 尽管 SGD 在机器学习社区已经存在了很长时间, 但是最近在 large-scale learning (大规模学习)方面 SGD 获得了相当大的关注。

-

在每一次迭代中,梯度下降使用整个训练数据集来计算梯度,因此它有时也被称为批量梯度下降(batch gradient descent)。而随机梯度下降在每次迭代中只随机采样一个样本来计算梯度。正如我们在前几章中所看到的,我们还可以在每轮迭代中随机均匀采样多个样本来组成一个小批量,然后使用这个小批量来计算梯度。下面就来描述小批量随机梯度下降。 设目标函数$f(\boldsymbol{x}): \mat

-

梯度下降法 梯度下降法(Gradient descent)或最速下降法(steepest descent)是求解无约束最优化问题的一种常用方法。 假设$$f(x)$$是$$R^n$$上具有一阶连续偏导数的函数。要求解的无约束最优化问题是: $$ \displaystyle\min_{x\in R^n} f(x) $$ $$x^*$$表示目标函数的极小值点。 梯度下降是一种迭代算法。选取适当的初始值

-

梯度下降法 梯度下降就好比从一个凹凸不平的山顶快速下到山脚下,每一步都会根据当前的坡度来找一个能最快下来的方向。随机梯度下降英文是Stochastic gradient descend(SGD),在scikit-learn中叫做SGDRegressor。 样本实验 依然用上一节的房价样本 X = [[50],[100],[150],[200],[250],[300]] y = [[150],[2