多变量线性回归的梯度下降法

好的,那么这个算法到底意味着什么呢?

据我所知:

i) 阿尔法:梯度下降的步骤有多大。

ii)现在,∑{hTheta[x(i)]-y(i)}:指给定θ值的总误差。

误差是指预测值{hTheta[x(i)]}与实际值之间的差值。[y(i)]

σ{hTheta[x(i)]-y(i)}给出了所有训练示例中所有误差的总和。

结尾的Xj^(i)代表什么?

在为多元线性回归实现梯度下降时,我们是否在执行以下操作?

θ(j)减:

>

阿尔法

乘以1/m

次数:

{第一个训练示例的错误乘以第一个训练示例的jth元素。加号

第二个训练示例的第j个元素乘以第二个训练示例的错误。加

.

.

.

加上第n个训练示例的误差乘以第n个训练示例的第j个元素。}

共有1个答案

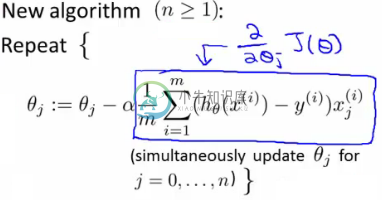

梯度下降法是一种寻找函数最小值的迭代算法。当给定一个凸函数时,保证在给定足够小的alpha的情况下找到该函数的全局最小值。这里是梯度下降算法,用于寻找函数J的最小值:

其思想是以学习速率alpha沿梯度的相反方向移动参数。最终它将下降到函数的最小值。

我们可以为θ的每个轴重写此参数更新:

在多元线性回归中,优化的目标是最小化平方误差之和:

这个代价函数的偏导数可以用代换微分法来推导,其中我们使用初等幂律,将幂2减为1,将2作为系数,去掉1/2系数。然后我们把h(x)的导数放到θ,右边是x。

这里,x_j^(i)代表h_theta(x^(i))到theta_j的偏导数。x_j^(i)是第i个数据的第j个元素。

-

我试图在java中实现线性回归。我的假设是θ0θ1*x[i]。我试图计算θ0和θ1的值,使成本函数最小。我正在用梯度下降来找出值- 在 在收敛之前,这种重复是什么?我知道这是局部最小值,但我应该在while循环中输入的确切代码是什么? 我对机器学习非常陌生,刚开始编写基本的算法以获得更好的理解。任何帮助都将不胜感激。

-

我试图在MatLab中实现一个函数,该函数使用牛顿法计算最佳线性回归。然而,我陷入了一个问题。我不知道如何求二阶导数。所以我不能实施它。这是我的密码。 谢谢你的帮助。 编辑:: 我用一些纸和笔解决了这个问题。你所需要的只是一些微积分和矩阵运算。我找到了二阶导数,它现在正在工作。我正在为感兴趣的人分享我的工作代码。

-

我用JavaScript实现了一个非常简单的线性回归和梯度下降算法,但是在查阅了多个源代码并尝试了几件事情之后,我无法使它收敛。 数据是绝对线性的,只是数字0到30作为输入,x*3作为正确的输出来学习。 这就是梯度下降背后的逻辑: 我从不同的地方取了公式,包括: 乌达城深度学习基金会纳米学位的练习 吴恩达的线性回归梯度下降课程(也在这里) 斯坦福CS229讲义 我从卡内基梅隆大学找到的其他PDF幻

-

我试图实现梯度下降的线性回归,如本文(https://towardsdatascience.com/linear-regression-using-gradient-descent-97a6c8700931)所述。我已经严格遵循了实现,但是经过几次迭代后,我的结果会溢出。我试图得到这个结果大约: y=-0.02x 8499.6。 代码: 在这里,它可以在围棋场上工作:https://play.go

-

我正在学习机器学习/线性回归的Coursera课程。下面是他们如何描述用于求解估计OLS系数的梯度下降算法: 因此,他们对系数使用,对设计矩阵(或他们称之为特征)使用,对因变量使用。它们的收敛准则通常是RSS梯度的范数小于容差ε;也就是说,他们对“不收敛”的定义是: 我很难让这个算法收敛,我想知道在我的实现中是否忽略了一些东西。下面是代码。请注意,我还通过statsmodels回归库运行了我在其中

-

在机器学习课程https://share.coursera.org/wiki/index.php/ML:Linear_Regression_with_Multiple_Variables#Gradient_Descent_for_Multiple_Variables中,它说梯度下降应该收敛。 我正在使用scikit学习的线性回归。它不提供梯度下降信息。我已经看到了许多关于stackoverflow