《常量》专题

-

Parquet write OutOfMemorySpark 上的异常

我有大约800万行500列的数据。当我试图用spark将它作为一个文件< code>coalesce(1)编写时,它失败了,并出现< code > out of memory exception 。 我知道这是一个执行器上的大量数据,但就我理解parquet的写入过程而言,它只在内存中保存一个行组的数据,然后将其刷新到磁盘,然后继续下一个。 我的执行器有16gb的内存,不能再增加了。数据包含很多字

-

运行时分级异常

-

处理JavaMailSender中的异常

我创建了简单的MailService来通过电子邮件发送内容。它工作但我不知道如何处理异常(我的想法是在HTML视图中打印一些信息或在404页重定向) 邮件服务: 在控制器中的用法:

-

Kafka的延迟非常高

Kafka的延迟非常高我不熟悉ApacheStorm和kafka,作为POC的一部分,我正在尝试使用kafka和ApacheStorm处理消息流。我使用的是暴风Kafka的来源https://github.com/apache/storm/tree/master/external/storm-kafka,我能够创建一个示例程序,该程序使用KafkaSpout读取来自kafka主题的消息,并将其输出到另一个kafka主题

-

Spring amqp Reply必需异常

我使用spring集成和amqp实现了请求/回复。由于某些原因,客户机抛出异常,处理请求可能需要很长时间(在某些情况下甚至需要一个小时)- 我的客户端配置如下。 我相信回复超时默认值是-1,表示无限期等待,但不确定为什么它不工作,任何帮助都将不胜感激。 此外,在amqp中实施如此长时间的等待操作是否存在任何已知问题,或者应该没问题? 非常感谢。

-

使用LoaderTestCase测试异常

在我的Android JUnit测试用例中,一个< code>LoaderTestCase,我想测试我的加载器是否抛出异常或返回null。我看到测试中抛出了< code > NullPointerException ,测试被中止。 我正在尝试捕捉这样的异常: 但是LoaderTestCase没有捕获异常,而是中止,并出现以下异常: 你能告诉我我该怎么做吗 在我的方法 中抛出的测试异常 将 null

-

Protobuf反序列化异常

试图在Java中使用protobuf反序列化消息,并得到以下异常。 原因:com.google.protobuf.InvalidProtocolBufferException:在解析协议消息时,输入意外地在字段中间结束。这可能意味着输入被截断,或者嵌入的消息错误报告了自己的长度。在com.google.protobuf.InvalidProtocolBufferException.Truncate

-

重复输入异常Hibernate

HTTP状态500-请求处理失败;嵌套异常是org.springframework.dao.dataIntegrityViolationException:键“groups_groupid”的重复条目“2”;SQL[N/A];约束[null];嵌套异常是org.hibernate.exception.constraintViolationException:键“groups_groupid”的重复

-

SpringBoot Elasticache JedisMovedData异常:移动

正在尝试将SpringBoot与SpringData与Elasticache一起使用: application.properties: 缓存配置: } 服务电话: 错误: 组织。springframework。数据雷迪斯。ClusterRedirectException:重定向:插槽7228到10…:6379.* redis.clients.jedis.exceptions.JedisMovedD

-

Java JAXB unmarshaller链接异常

constants.xml_path=“/acquirer.xml”;

-

Xcode经常链接失败

我有一个奇怪的问题,当我构建和运行时,我经常得到这个错误

-

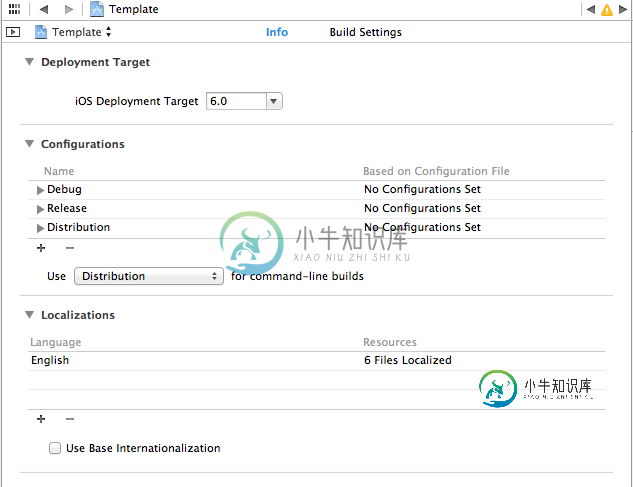

缺少常规选项卡

缺少常规选项卡我刚刚切换到使用Xcode 5。我去更改了我的应用程序的名称和一些我需要更改的其他设置,但是当我这样做时,我注意到我的“常规”选项卡丢失了。有人知道为什么会发生这种事吗?

-

在servlet中处理异常

我正在做我的一项任务。这相当直截了当。包含单个输入的HTML表单被提交到Servlet,Servlet获取参数,基于参数创建消息,将消息作为属性添加到请求,并使用requestdispatcher转发到jsp以显示消息。 我有一个要求,如果参数丢失,我需要显示一个错误页面。问题是我不能显式地检查null,也不能使用try/catch块。我的猜测是,目标是在web中定义错误页面。xml页面来处理特定

-

Java到DB连接异常

我们正在开发web应用程序,我们的tomcat服务器和mysql服务器运行在两个不同的服务器上,我们收到了错误 需要帮助来解决问题 已经尝试了这些链接的解决方案。 Hibernate会话无法打开事务 第一次登录:HTTP状态500 -请求处理失败;嵌套异常是org . spring framework . transaction . cannotcreatetransactionexception

-

Storm拓扑生成异常

我正在尝试使用storm spout作为Kafka消费者将我的数据从Kafka主题发送到HBase,并将数据发送到HBase我在storm拓扑中遇到异常。。。。