《群面攻略》专题

-

收集Spark群集外的数据时内存不足错误

null 当我运行上面的代码,然后该表以激发内存时,它占用的内存<2GB-与集群可用的内存相比很小-然后当我试图数据到驱动程序节点时,我会得到一个OOM错误。 我已尝试在以下设置上运行: 具有32个内核和244GB RAM的计算机上的本地模式 具有10 x 6.2GB执行程序和61GB驱动程序节点的独立模式 我的问题: 缓存后占用空间如此之少的数据文件怎么会导致内存问题? 在我转向可能损害性能的其

-

无法从Java应用程序连接到本地spark集群

我试图运行一个连接到本地独立spark集群的java应用程序。我使用start-all.sh以默认配置启动集群。当我转到集群的web页面时,它被启动为OK。我可以用SparkR连接到这个集群,但是当我使用相同的主URL从Java内部连接时,我会得到一条错误消息。 下面是Spark日志中的输出:

-

无法使用kubectl管理集群-“无法协商api版本”

在通过云控制台创建集群后,我试图在本地使用kubectl,但总是出现错误。以下是我采取的步骤: 通过云控制台 下面是kubectl版本的输出 客户端版本:version.info{Major:“1”,Minor:“3”,gitversion:“v1.3.5”,gitcommit:“b0deb2eb8f4037421077f77cb163dbb4c0a2a9f5”,gittreeste:“clean

-

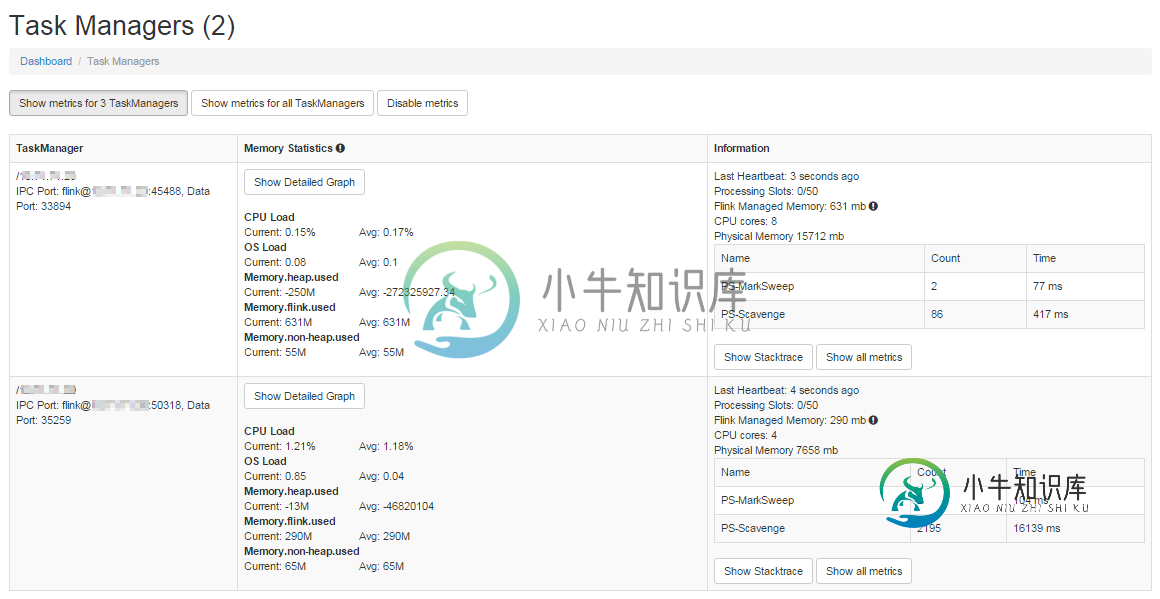

集群中的Apache Flink流不会与工人拆分作业

集群中的Apache Flink流不会与工人拆分作业我的目标是使用Kafka作为源设置一个高吞吐量集群 我在主服务器和辅助服务器上设置了一个2节点集群,配置如下。 flink-conf.yaml大师 Worker flink-conf.yaml 主节点上的文件如下所示: 两个节点上的 flink 设置位于具有相同名称的文件夹中。我通过运行 这将启动Worker节点上的任务管理器。 我的输入源是Kafka。以下是片段。 这是我的水槽功能 这是我的po

-

让telegram bot在文档发送到群聊时做出反应

当我的机器人检测到在聊天中发送文档时,我希望它发送一条消息。 我添加了一个带有文档筛选器的消息处理程序。 代码直接用于聊天到机器人, 但是如果我将机器人添加到一个组中,如果我在组中发送了一个文档,机器人将没有响应。 为什么当我在组中发送文件时机器人没有响应?谢了!

-

如何优雅地更新形成Hazelcast集群组的ECS-service?

我们有一个ECS-service(EC2 ECS),有几个任务组成一个Hazelcast集群组(Hazelcast:3.10.6,HazelCast-AWS:2.2,我们使用Hazelcast在分布式对象中存储一些共享数据和锁)。它使用滚动服务更新,最小健康百分比设置为100,最大值设置为200。 用新的任务定义更新这个服务并不是很可靠--通常由于ECS的服务更新过程的性质,Hazelcast不能

-

无法在3 HA群集架构上使用相同的clientId

我使用的是ActiveMQ Artemis集群,由3个代理(1个主代理,2个从代理)组成,使用UDP广播设置。 ActiveMQ Artemis按预期启动,但是当尝试使用SAG webMethods创建JMS连接时,它返回错误: null ActiveMQ Artemis支持JMS2.0,多个客户端指向同一个ClientID/目的地应该是可能的,对吗?它允许共享订阅。 我在这里错过了什么?我根本没

-

无法让我的功能文件被aws设备群识别

我在用设备农场运行cucumber项目时遇到了问题。我得到了这个错误: [TestNG]原因:java。lang.IllegalArgumentException:不是文件或目录:/tmp/scratchheDEgq。scratch/test-packagex5ZhYf/src/test/java/cumber/features 我从这条信息中了解到,在我的项目中,功能目录的路径有问题,但在本地它

-

hadoop多节点群集-从节点无法执行mapreduce任务

jps输出正确: 在主机上: 在5个从节点上:

-

Prometheus中部署在不同kubernetes机群中的Pod级监控

-

从WAAD获得用户群的最简单方法是什么?

我已经启动并运行了AngularJS和web.api WAAD身份验证。对于客户端,我使用了很棒的库adal.js。对于后端,我使用Microsoft.OWIN.Security.OAuth。这部分进行得相当顺利。 现在我要实现基于角色的授权(将映射到WAAD组)。组不包括在身份验证令牌中,所以我必须向Azure Graph API请求它们。我看到了各种实现方法,例如使用自定义声明提供程序、向pr

-

使用Prometheus监视Kubernetes机群中的Spring Boot应用程序

我在本地的kubernetes集群中部署了spring boot支持的微服务。微服务正在使用micrometer和prometheus registry,但由于我们公司的政策,执行器可在另一个端口上使用: 8080,用于“业务”http请求 执行器的8081/管理。因此,我可以访问并查看在本地运行进程(不使用kubernetes)时的度量。 现在,我是Prometheus的初学者,对kuberne

-

密钥斗篷独立集群配置是否需要仲裁?

据说KeyClope构建在WildFly应用服务器及其子项目Infinispan(用于缓存)和Hibernate(用于持久性)之上。 Keycloak 建议查看 WildFly 文档和高可用性指南。 如果理解正确,独立群集配置允许在群集周围进行SSO上下文的会话复制或传输。 我不明白是否需要奇数个密钥保护节点才能达到仲裁。 单子系统状态 10.1.3.Quorum网络分区对于单例服务来说尤其成问题

-

active-mq artemis springboot集群主题负载平衡(循环)问题

在花费大量时间配置和尝试大量解决方案使Artemis在集群模式下工作之后,就像发布-订阅(主题)中的本地模式一样。因此,我在不同的节点上准备了3个消费者和一个只在一个节点上发布消息的生产者。我希望3个消费者收到他们自己的消息副本,如在这里所描述的! 问题是集群(核心桥)仍然在3个节点之间循环消息。 我的项目Github回购 spring-boot-artemis-clustered-topic 代

-

无法在Apache Storm群集中使用远程从属节点

我在跟踪http://jayatiatblogs.blogspot.com/2011/11/storm-installation.html尝试在Amazon Web服务上使用带有Ubuntu14.04 LTS的少数虚拟机(EC2)配置Apache Storm远程集群。 我的主节点是10.0.0.230,从节点是10.0.0.79。我的zookeeper位于我的主节点中。当我使用storm-jar-