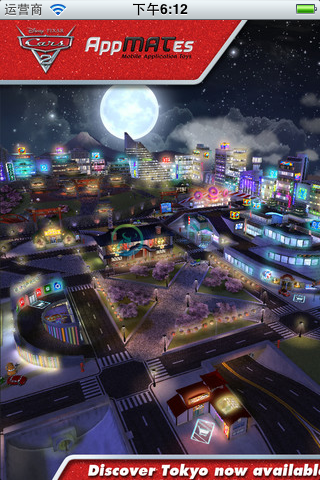

实现用Pinch手势撕破图片的效果。用pinch手势放大就可以看到效果了,即用两只手指分别左右方向拖拉图片,图片就会撕成两半。撕裂是锯齿状的,可以改成任意形状,就是计算坐标的时候会麻烦些。 [Code4App.com]

-

#import "ViewController.h" @interface ViewController () { //缩放因子 CGFloat currentScale; } @property (strong, nonatomic) UIImage *imageTrashFull; @property (strong, nonatomic) UIImageView *ima

-

当时百度的。实在没记住出处。效果很理想,就收藏了。 package com.demo.pinch; import android.content.Context; import android.graphics.Bitmap; import android.util.FloatMath; import android.view.MotionEvent; import android.view.a

-

六种手势如下: UITapGestureRecognizer [UIPinchGestureRecognizer](捏合) [UIRotationGestureRecognizer](旋转) ([UISwipeGestureRecognizer]滑动,快速移动) [UIPanGestureRecognizer](平移,慢速移动) [UILongPressGestureRecognizer](长按)

-

我写博客一般都是把在项目中遇到的一些问题记录下来,可以在以后遇到类似问题或者有新的思路时来回顾。 前两天就遇到一个需求:在手机端,把html页面的图片内容放大和缩小、移动位置。花了我一天时间才做好,本来是自己先画逻辑草图和整理思路,做着做着发现有个别细节不对,所以走了一些弯路。现在把代码直接贴出来,功能和效果比较简陋,后面会继续完善,如果有疑问或建议可以留言,3Q。 功能:双击图片放大,单点触摸图

-

<!DOCTYPE html> <html> <head> <meta charset="UTF-8"> <title></title> <style type="text/css"> .box { width: 500px; margin: 0 aut

-

基于tensorflow的手势检测和手势识别分类 https://blog.csdn.net/yyyerica/article/details/80151473 opencv 实现的静态手势识别 进而玩剪刀石头布 https://blog.csdn.net/u013480370/article/details/38389089 手势识别论文解读 https://blog.csdn.net/xiao

-

你想让自己的ImageView可以跟随手指运行,一同变大变小,旋转跳跃么?我写的图片库 原理就是处理触摸事件了。直接看源码来得直接。还是给个原理链接吧 原来还想写写原理和画画类图的,先给自己挖坑吧。 欢迎打脸pull,star,fork。

-

参考自 https://github.com/xinghaochen/awesome-hand-pose-estimation 1、Deep Hand Pose 2014年 caffe框架 Provides the source code for the deep learning components mentioned in “Depth-based hand pose estimation:

-

只能在AndroidTest里运行 UiDevice myDevice = UiDevice.getInstance(InstrumentationRegistry.getInstrumentation()); try { myDevice.findObject(new UiSelector().text("element text to be found"

-

Responding to Events with Gesture Recognizers 三、用手势识别响应事件 There are three things you do to add a built-in gesture recognizer to your app: 你需要做三件事来添加一个内建手势识别到应用程序: Create and configure a gesture recogn

-

==========无限互联IOS视频学习笔记=====UI高级===== #参考资源: IOS开发之手势——UIGestureRecognizer 共存 2、手势识别器 ·UIGestureRecognizer UIGestureRecognizer类,用于检测、识别用户使用设备时所用的手势。它是一个抽象类,定义了所有手势的基本行为。以下是UIGestureRecognizer子类,用 于处理具

-

转载([https://blog.csdn.net/u012891546/article/details/52411541](https://link.jianshu.com?t=https%3A%2F%2Fblog.csdn.net%2Fu012891546%2Farticle%2Fdetails%2F52411541)) iOS系统中,滑动返回手势,其实是一个UIPanGestureRecog

-

一个Android手势缩放图片的工具类;同时,此类还实现另外一个功能:当手指按在触屏上移动时候,图片“黏贴”在手指上随手指移动而整体移动。 具体使用方法可以是这样:先new一个此类的实例,然后在ImageView的方法setOnTouchListener(new ImageViewOnMultiTouchListener()); 例如: ImageViewOnMultiTouchListener

-

转自 http://www.cnblogs.com/devxiaobai/archive/2013/05/10/viewimage.html

-

以下内容源于本人整理,部分来源于网络,如有侵权行为或错误之处还望指正 请联系邮箱huiyutianshi@qq.com 关于touch事件的 手势和事件都是基于UIRrsponder的 UIResponder包含所有的响应事件:触摸,加速计(摇晃),远程控制(蓝牙) 只有继承与Responder的类才能响应事件,它们被成为响应者,多个响应者组成一个链状层次成为响应者链 ——————————————

-

我已经建立了一个,并使其包含18列。最初,当它是13列时,它非常适合JTable,并且没有撕裂。然而,一旦我使它包含18个表,并将自动调整大小设置为关闭,当我使用水平滚动条尝试滚动其他列时,JTable的撕裂开始发生,如图所示: Netbeans还开始向我发送大量错误消息,如: 为什么会这样?这个问题有什么解决办法吗?谢谢 真抱歉!下面是用于初始化表的代码。希望会有用!

-

我被屏幕撕裂问题困扰了大约一周。 这里是我的问题:我想做一个程序,可以显示一个PNG图片序列非常快(以30帧或以上的速度)。为此,我使用pygame库,尤其是和。 下面是一个代码示例(带有自制的延迟功能): 计时器允许我在屏幕上有相同的刷新率。我的问题是,一个人可以亲眼看到屏幕撕裂问题(https://en.wikipedia.org/wiki/Screen_tearing)。在pyplay留档他

-

Weex 封装了原生的触摸事件以提供手势系统。使用手势类似于在 Weex 中使用事件,只需在节点上监听手势即可。 手势类型 目前,仅支持以下四种手势类型: touch: 当触摸到一个点,移动或从触摸面移开时触发 touch 手势。触摸手势很精准,它会返回所有详细的事件信息。所以,监听 touch 手势可能很慢,即使只移动一丁点也需要处理大量事件。有三种类型的 touch 手势: type 描述 t

-

请问对于那种二维矩阵的题,大家在面试中怎么处理输入? 面试题目里给的示例输入可能是这样子: 输入:graph = [[4,3,1],[3,2,4],[3],[4],[]] 面试是acm模式除了main函数别的都没有,这种情况下的手撕我们需要构造输入吗?要的话怎么构造呢? 还是说这种题目面试官会允许不写输入,只用给几个case能过就行。

-

我试图移动这个图像: 在我的PyGame屏幕上,从右到左再向后,但是随着图像的移动,每隔一秒左右我就会有一点屏幕撕裂,就像这样: 我使用的代码是类似于此的循环: 到目前为止,我已经尝试了以下方法来解决这个问题: 在创建屏幕时使用,,标志,这没有效果,我也调整了更新为(因为使用?)时建议使用此选项) 在GPU和CPU之间拆分内存(我在raspberry pi 2上运行此功能)我尝试过为这两个处理器提

-

我将保持简短,知道我所说的是2009年在AS3的Box2d上发生的,今天也发生在一个完全独立的JavaScript库p2 physics中。 你会看到这样的结果:关节分离并变得有弹性。 这个问题阻止了我用物理来做任何有趣的事情。球和铁链,弹射器,叉车,破布娃娃,蜘蛛人射击网,2D车辆..... 禁忌似乎是多余的,不稳定。我认为一个物理引擎对于愤怒的小鸟,或者坠落的积木是很好的,但是当你加入约束的时