《同花顺2024春招交流讨论》专题

-

1.4.14 同一 DbContext 类型中多个模型的交替

在 OnModelCreating 中构建的模型可以使用上下文实例上的一个属性来更改模型的构建方式。例如这可以用来排除一个特定的属性: public class DynamicContext : DbContext { public bool? IgnoreIntProperty { get; set; } public DbSet<ConfigurableEntity> Ent

-

火花雪花连接器是否仅适用于databricks spark?

使用databricks spark,可以使用spark雪花连接器(spark-snowflake_2.11-2.3.0.jar,snowflake-jdbc-2.8.1.jar)将数据写入snowflake,而不使用jdbc连接。但如果没有databricks,当我尝试在安装spark的本地机器中应用相同的代码时,我无法使用spark snowflake连接器将代码写入snowflake。我面临

-

雪花在拼花地板上不是按柱分割的

雪花在拼花地板上不是按柱分割的关于雪花的新功能--推断模式表函数,我有一个问题。INFER模式函数在parquet文件上执行得很好,并返回正确的数据类型。但是,当parquet文件被分区并存储在S3中时,INFER模式的功能与pyspark Dataframes不同。 在DataFrames中,分区文件夹名称和值作为最后一列读取;在雪花推断模式中有没有一种方法可以达到同样的结果? 示例: 示例:{“AGMT_GID”:1714

-

流操作应用于列表元素的顺序是什么?[重复]

假设我们有一个流操作的标准方法链: JLS 中是否有任何关于将流操作应用于列表元素的顺序的保证? 例如,是否保证: 在将筛选器谓词应用于“a之前,将筛选器谓词应用于不会发生吗? 在将映射函数应用于之前,将映射函数应用于“def”不会发生? 会先打印 ? 注意:我在这里特别谈论的是< code>stream(),而不是< code>parallelStream(),在后者中,映射和过滤等操作是并行完

-

将流中的对象同时添加到两个不同的列表中

如何将一个流中的对象同时添加到两个不同的列表中 目前我正在做 要将流中的对象添加到linkedlist“resourceMemory”中,我还想同时将相同的对象添加到另一个列表中,但我找不到它的语法。是否可能,或者每个列表需要两份代码副本?

-

SSM框架前后端信息交互实现流程详解

本文向大家介绍SSM框架前后端信息交互实现流程详解,包括了SSM框架前后端信息交互实现流程详解的使用技巧和注意事项,需要的朋友参考一下 一、从前端向后端传送数据 常见的3种方式 1、form表单的action:此方法可以提交form表单内的输入数据,也可同时提交某些隐藏但设置有默认值的<input>,如修改问题时,我们除了提交问题的相关信息,还需要将用户的编号提交给后端,此时就可以设置一个默认值为

-

Day 8. 每日一问 --- 你的沟通交流能力如何

Day 8. 每日一问 --- 你的沟通交流能力如何今天分享的是设计面试中关于工作经验的问题:你的沟通交流能力如何? 针对这个问题的回答思路: 沟通交流能力也可以拆解为:向上沟通和平级沟通。 向上沟通(导师、甲方) 清晰明确 能够梳理当前任务状态,以及沟通目的(寻求建议、获得许可等)在拿到任务后与导师再次确认任务目的、任务内容、截止时间,保证接收到的信息无误(好的,我理解这个任务是……您看我理解的有问题吗)。 精简扼要 罗列问题123,说明我的考虑

-

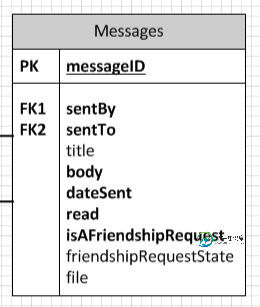

选择与我交谈过的用户,并与他们交流最后一条消息,例如whatsapp

选择与我交谈过的用户,并与他们交流最后一条消息,例如whatsapp问题内容: 我的数据库中有此表: 和FK到表。 在此表上,我有用户之间的消息: 我需要知道与用户1交谈过的 用户以及与用户1交谈过的用户 。在这种情况下,对于用户2、3和4(请注意,用户4已向用户1发送了一条消息,但用户1尚未发送任何消息)。 第二个问题是: 我该如何与每个用户获取最后一条消息? 我要求将最新消息发送给用户。 例如,如果我要询问用户1,则用户2的最新消息为:味精正文2。而用户3的最

-

京东数据分析面试3|秋招两面社交电商部

京东数据分析面试3|秋招两面社交电商部京东社交电商APP+小程序京喜,对标拼多多。 一面 1. 自我介绍+项目与实习提问。 2. 你学的这个专业,你认为对你影响最大的是什么? 3. 最大的成长或收获是什么呢?为什么?举个最近实际的例子? 4. 详细问是例子中是怎么想、怎么做、怎么实现的? 5. 运用数据分析,分析一下酒店的漏水情况?(和面试官一来一往提出假设,具化问题,分析讨论) 6. 你SQL怎么样? 7. 你有什么问题? 二面 1

-

干货|看完了解ux交互秋招|实习面试问什么

干货|看完了解ux交互秋招|实习面试问什么我想提醒大家的是,如果大家要进入这个行业,相关的作品集一定要以app设计,交互设计方法体现为主 用人单位在筛选时,有实习+对应作品集的同学,一定是优先选择的。当然对应的体现设计能力的作品也可以酌情添加。 回到正文,以校招面试为例,主要包括三次面试,均为业务面,有些公司会增加hr面 一面主要考察专业能力,提问内容包括不限于: 1、你这款产品研究的目的是?(考察你的设计需求如何得出) 2、你的这款产品

-

基于工作者、核和数据流大小确定最佳火花分区数

Spark-land中有几个类似但不同的概念,围绕着如何将工作分配到不同的节点并并发执行。具体有: Spark驱动程序节点() Spark群集可用的辅助节点数() Spark executors的数量() 所有工作人员/执行人员同时操作的DataFrame() ()中的行数 () ,最后是每个工作节点上可用的CPU核数() 我相信所有的Spark集群都只有一个Spark驱动程序,然后是0+个工作节

-

Java只是花括号

问题内容: 我正在看书,有一些带有花括号的程序示例 例如 问题答案: 这是一个代码块。在其中声明的变量在上部代码块(这些curl之外的方法体)中不可见,即它们的作用域更加有限。

-

火花基本原理

我是新来的火花...在阅读基本原理时,一些基本的东西我不清楚:

-

理想火花构型

我在我们的项目中使用了HDFS上的Apache spark和MapR。我们正面临着运行火花工作的问题,因为它在数据小幅增加后失败了。我们正在从csv文件中读取数据,做一些转换,聚合,然后存储在HBASE中。 请建议,如果上面的配置看起来很好,因为am geting的错误看起来像是要离开内存。

-

火花速度试验

我通过连接到一个有500'000'000行和14列的数据库。 下面是使用的代码: 上面的代码花了9秒来显示DB的前20行。 后来,我创建了一个SQL临时视图 上面的代码用了1355.79秒(大约23分钟)。这样可以吗?这似乎是一个大量的时间。 最后,我尝试计算数据库的行数 用了2848.95秒(约48分钟)。 是我做错了什么,还是这些数额是标准的?