《机器学习算法面试》专题

-

Python机器学习之决策树算法

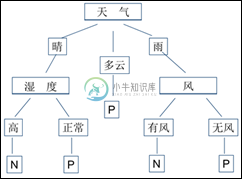

Python机器学习之决策树算法本文向大家介绍Python机器学习之决策树算法,包括了Python机器学习之决策树算法的使用技巧和注意事项,需要的朋友参考一下 一、决策树原理 决策树是用样本的属性作为结点,用属性的取值作为分支的树结构。 决策树的根结点是所有样本中信息量最大的属性。树的中间结点是该结点为根的子树所包含的样本子集中信息量最大的属性。决策树的叶结点是样本的类别值。决策树是一种知识表示形式,它是对所有样本数据的高度概括

-

24春招蚂蚁算法岗机器学习二面面经

24春招蚂蚁算法岗机器学习二面面经上周五一面结束,这周二约的二面。 全程20分钟,纯聊天。 面试官人巨好。 问了手里有的offer,为什么还在找。 然后是聊项目,论文的创新点。 之后就是反问了,给我科普了广告所做的内容。 问下一轮面试,如果通过就是HR面了。 面试官看时间还比较早,就继续聊了会儿。 面试官人巨好,也跟我说了对我的评价,需要和一面面试官讨论一下再确认结果。 真的是很愉快的一次面试。 许愿二面能够通过

-

24春招蚂蚁算法岗机器学习一面面经

24春招蚂蚁算法岗机器学习一面面经笔试ak了被捞起来了,部门是支付宝广告业务技术部。 全程30min(感觉又要凉) 项目。问GRU的原理(这里重置门和更新门具体的作用记不清哪个是哪个了) 问到线性回归(平时用深度学习比较多,机器学习接触的少一些) 然后就做题了。。 三道题选一个即可,都是leetcode原题,分别是 16最接近的三数和 22括号生成 53最大子数组和 选第三个秒了 反问:业务、新人培养(问HR比较好)、深度学习多还

-

百度机器学习算法春招一二三面面经

百度机器学习算法春招一二三面面经【一面】 1. word2vec的原理,skip-gram训练的具体流程,使用的损失函数,是怎么选择正负样本的,选择样本上有哪些优化算法,负采样的原理,还有哪些优化方法 2. 贝叶斯调优,机器学习中有哪些优化参数的方法,为什么交叉熵会作为softmax结果的损失函数?梯度下降为什么有效,关于损失求一阶导数为什么有效?刚你提到了泰勒一阶展开,泰勒二阶展开有哪些相关的优化方法呢? 3. SGD的原理,

-

oppo机器学习面经

oppo机器学习面经一面: 自我介绍、极大似然估计、假设检验、朴素贝叶斯的公式、逻辑回归损失函数是什么,怎么来的(对数损失,等价于极大似然估计)、说说xgboost(我说了目标函数推导,还有一些过拟合措施等等)、了解transformer吗(没细问)、看过源码吗(没看过)、卷积为什么叫卷积(我随便说了个卷积公式,但不对)、对卷积的理解(我说滤波,因为我跟一维卷积打交道比较多,我还举了个人脸识别例子,我说底层的卷积会提

-

Momenta机器学习面经

Momenta机器学习面经9.3一面(1h) 面试官先做了自我介绍 自我介绍 简历上项目比赛介绍、提问 附加问题:矩阵乘法,前向网络计算和反向传播计算梯度哪个更耗时?矩阵C = A*B,已知Grad(C),计算A和B的梯度 手撕算法题:类似LC上合并k个有序链表,将一个二维数组合并成一维数组,二维数组每行是有序的,合并k行到一行并保证有序。用堆做的,并分析算法的时间复杂度。 反问:业务内容?主要是做自动驾驶里的Planni

-

oppo机器学习 一面

oppo机器学习 一面1. 项目相关,问了很多 2. 数据不平衡问题怎么解决,分类指标,多分类指标是怎么计算的 3. 集成学习了解吗 4. 一般怎么调参; 5. 超参和参数的区别 6. 一般使用python哪些包?

-

淘天机器学习实习面试

淘天机器学习实习面试项目问题: 1、常用目标检测算法?区别? 2、基于人脸识别的目标检测有无研究? 3、yolo最初是谁提出的? 4、bert、trasformer的每一层具体结构? 5、transformer的输入输出? 6、如果用bert来做中译英任务,输入输出会是什么?QKV会是什么? 7、gpt的结构?gpt相当于transformer的哪一部分? 8、编码器、解码器的作用? 八股问题: 1、常用激活函数?

-

百度机器学习算法提前批一面凉经

百度机器学习算法提前批一面凉经约的8点开始, 8点面试官进来后说要上卫生间,等到8点10分开始,一共60分钟。 1、开始先聊了会儿在字节实习的内容,主要聊场景; 2、聊完后开始问xgboost(简历有写),很细,都是答完后继续往下深挖,答的不好: 和GBDT的区别 什么场景用lr,什么场景用xgboost,什么场景用nn 构造树的过程 怎么来做多分类的 。。。 3、auc指标的含义 4、分类问题为什么用交叉熵不用mse,从公式

-

蚂蚁机器学习算法一面不热不凉经

蚂蚁机器学习算法一面不热不凉经发个面经攒攒人品吧家人们😥 上来全是问基础,太烧脑了呜呜 1.面试官介绍了他们是支付宝广告技术部,主要做搜广推aigc大模型等,包括涉及的业务等 1.开始严刑拷打了呜呜。问我在阿里做aigc项目,主要负责了哪块?问相关的vision transformer有没有了解过?我说没有只看过transformer,然后就问那你说说transformer。。。 2.问了神经网络中最大池化层的反向传播怎么算

-

23秋招 oppo机器学习算法工程师 面经

23秋招 oppo机器学习算法工程师 面经9.7一面 (约40min) 自我介绍 项目比赛介绍,没有深挖 进程和线程区别 数组和链表的区别 递归和非递归的区别(除了栈这方面) 快排的时间复杂度,快排稳定吗 类似的基础问题等等(想不起来了。。。) 二叉树了解吗?还行 撕题:非递归中序遍历二叉树 反问 总体感觉面试比较简单,上午面完,下午通知下周二面 9.13二面 (约20min) 自我介绍 问了一个比赛,大概十来分钟 反问 面完下来一查秒挂

-

菜鸟 机器学习算法工程师 电话一面

菜鸟 机器学习算法工程师 电话一面上午在床上睡觉接到电话说要面试,推到下午了 时长:40min 1.自我介绍 2.项目深挖,问到了两个项目,主要包括背景,模型流程等 3.八股: 1)如何判断一个模型过拟合或者欠拟合? 2)如何解决过拟合? 3)L1L2正则有什么效果? 4.反问: 1)部门业务:菜鸟APP的推荐内容 2)是否介意没有相关背景的同学 3)后续流程?1-2轮技术面+hr面 4)base地情况 挺好的,面完秒挂

-

阿里淘天算法工程师机器学习一面

阿里淘天算法工程师机器学习一面2024/08/29 14:00(50分钟) 这个岗位是学长内推的,不是我研究的方向所以没有项目,一面也没有八股啥的,主要考察了下代码能力和思考问题的能力吧 手撕:判断序列能否划分成两个和相等的子集(背包),网格路径最小(动态规划) 还一个概率论的题目就不透露了

-

蚂蚁集团-算法工程师-机器学习 一面

蚂蚁集团-算法工程师-机器学习 一面电话面+邮箱发alitcode链接进行coding考察 ----------------------------------------------------------------------------------------------------------- 没有让做自我介绍,直接对着简历问项目。 第一个项目是用seq-to-seq做的缺陷自动修复,问我将NLP应用到软工领域有什么痛点

-

百度地图机器学习算法工程师二面

百度地图机器学习算法工程师二面这次面试官没有迟到,没有机会水了。。。 不过是个女面试官,非常亲和的感觉 开局自我介绍,讲了一下学的课程内容和做的课设项目,了解了一下大概情况 重点分析讲了一下数据竞赛的内容 八股: 1.讲一下集成学习的一些算法 2.GBDT,XGBoost,LightGBM各自有什么优势劣势,适用情况 3.独热编码和embedding的用途,各自优势,为什么用 4.为什么在项目中用了GBDT而不是RF 5.讲一