《强化学习》专题

-

开始学习基础知识

GETTING STARTED WITH THE BASICS 从本质上而言,黑客就是行动者。我们想要触摸和玩弄一些东西,我们也希望创造并且有时可能会破坏一些事物。在我们能够做我们最喜欢的事情之前,我们中很少有人想要阅读信息技术理论的长篇大论:黑客攻击。考虑到这一点,本章旨在为您提供一些基本技能,帮助您在 Kali 中启动和运行。现在! 在本章中,我们不会详细介绍任何一个概念 - 我们将覆盖足够的

-

2 为什么要学习 Prolog

为什么要学习Prolog 当我在大学的课程表里面发现Prolog这门课的时候,我十分惊讶,我在想:为什么我要学习Prolog呢?我会使用Java, C++和php编程,这些语言已经强大到几乎可以实现任何功能,而且有很多很多写好的函数库来供你使用,为什么我还要学习什么Prolog? 当我开始学Prolog的时候,我发现这个语言的语法真是太奇怪了,有别于一般的编程语言,Prolog的程式是基于谓词逻辑

-

腾讯机器学习面经

腾讯机器学习面经冬招的第一个offer 一面 先拷打项目 然后手撕多头注意力机制和一道算法题:lcr08长度最小子数组 然后问了一些八股 linux如何查看某个文件有多少行 linux如何查看某个文件的第几列 git回滚的指令 合并分支的指令 弹一弹熟悉的激活函数和优缺点 fasterrcnn的优化 yolov5v8的优化 为什么业内yolov5用的比较多而不是yolov8 多头注意力机制和单头相比有什么优势 正

-

百度机器学习一面

百度机器学习一面一共就面了半小时,有15分钟都在做题的样子😂 手撕: 判断链表有没有环,快慢指针,通过了面试官还要我讲一下思路,我就一直解释推的数学公式,不知道他听没听懂 问题: 我做的项目用了Xgboost,就从这个开始问,原理,GBDT,为什么这种模型好用等等 后来又问了我使用过paddleocr,提升准确率方法,(我也不知道,就瞎说,当时也没提升) 还问我会不会用大数据处理工具,没用过… 问了一些数据处理

-

美团机器学习面经

美团机器学习面经美团笔试4道a了3,面完挂了一次被捞起来,然后面了两轮因为不太匹配又被丢回人才库了,今天又通知被捞了起来…… 记录一下前两轮面试吧,希望这次被捞能有好结果 优选一面(1h 凉) 一直问项目,目标检测的,数据集、模型…… 问图生图的,评价指标,模型结构 以上问了四十多分钟 写题:LeetCode 152. 乘积最大子数组 题不难,脑抽了,初始化一直有问题(你这个方法应该没啥问题,过不了的话你回去再调

-

小米机器学习二面

小米机器学习二面自我介绍,三道编程题(二叉树和图,a了两道),项目深挖

-

一、Python 机器学习简介

什么是机器学习? 机器学习是自动从数据中提取知识的过程,通常是为了预测新的,看不见的数据。一个典型的例子是垃圾邮件过滤器,用户将传入的邮件标记为垃圾邮件或非垃圾邮件。然后,机器学习算法从数据“学习”预测模型,数据区分垃圾邮件和普通电子邮件。该模型可以预测新电子邮件是否是垃圾邮件。 机器学习的核心是根据数据来自动化决策的概念,无需用户指定如何做出此决策的明确规则。 对于电子邮件,用户不提供垃圾邮件的

-

小米机器学习面经

小米机器学习面经一面 自我介绍 结合项目描述RNN、LSTM结构,描述模型改进原理 残差连接的优势 梯度消失问题——对比深度网络的梯度消失和循环网络的梯度消失 数据不平衡问题原因与解决措施 性能指标F1分数的计算方式 DDQN项目的环境介绍与网络模型 深度学习和强化学习的关联 Adam优化器的原理,SGD的原理 手撕: 最长有效的括号字符子序列(返回所有最长的子序列)(10分钟) 反问: 1分钟 emmm手撕ha

-

美的机器学习群面

美的机器学习群面遇到了全是技术岗的群面,一起讨论怎么ai技术加入产品 总结:一定要读题!!!针对题来每点说自己的想法,最好把自我介绍压缩一下,组里好几个人没有说完就被下一个了,而且顺序不是按照公众号的个人编号。 读题5min,自我介绍➕想法1.5min,讨论20min,总结5min 就算没有抢到主持人,中途理清团队的思路也很重要!!!我的组两个技术大佬一直不统一。。。导致其他人也没有发表什么明确的想法和意见,我发

-

百度机器学习凉经

百度机器学习凉经提前批 过去有点久了,可能有些回忆不准确了 百度机器学习一面 (电话,很简短) 询问想做的方向 问了LSTM GRU的结构和区别 Attention 原理 Bert 原理 对做NLP怎么看 百度机器学习二面 过项目,问项目涉及到的机器学习算法 概率题 贝叶斯相关 手撕算法 二分查找 先写无重复的 再写有重复找第一个 百度机器学习三面 证明根号二是无理数 用梯度渐近法求根号2 用牛顿法求根号2 手撕

-

影石 深度学习算法

影石 深度学习算法一面 深挖实习项目,问了算法的idea产生以及部署落地后的效果,最后问进一步改进方法 二面 第一部分考察对NeRF整个领域的了解,介绍了十多个下游领域方向代表的论文并说明优缺点;第二部分针对NeRF问我关注什么样的改进以及重点看哪方面的创新点,之后对NeRF+SDF的表面表达原理细节以及公式提问,接着问实习项目的创新点;第三部分针对他们业务中存在的问题问我有哪些方法或者建议;最后一部分简单过了鼠鼠

-

快手机器学习 一面

快手机器学习 一面自我介绍 介绍项目 介绍实习,面试官问的内容和ML的关系不太大,可能是和部门的工作比较契合所以就没为难我。 面试官向我介绍部门的工作内容,了解到和我目前实习工作相关性较强。 手撕:比较版本号 反问,因为投的是深圳+北京,所以问了一下base地。

-

深度学习面经 - Attention、Transformer

深度学习面经 - Attention、Transformer简介:Attention机制是一种用于加强神经网络在处理序列数据中关注重要部分的机制。在处理长序列时,RNN可能难以捕捉到序列中不同部分的重要程度,导致信息传递不够高效。而Attention机制允许网络根据当前输入和其他位置的信息,动态地调整各个位置的权重,使得模型可以有选择地关注不同部分的输入。Transformer是一种基于Attention机制的神经网络架构,由著名且经典的"Attentio

-

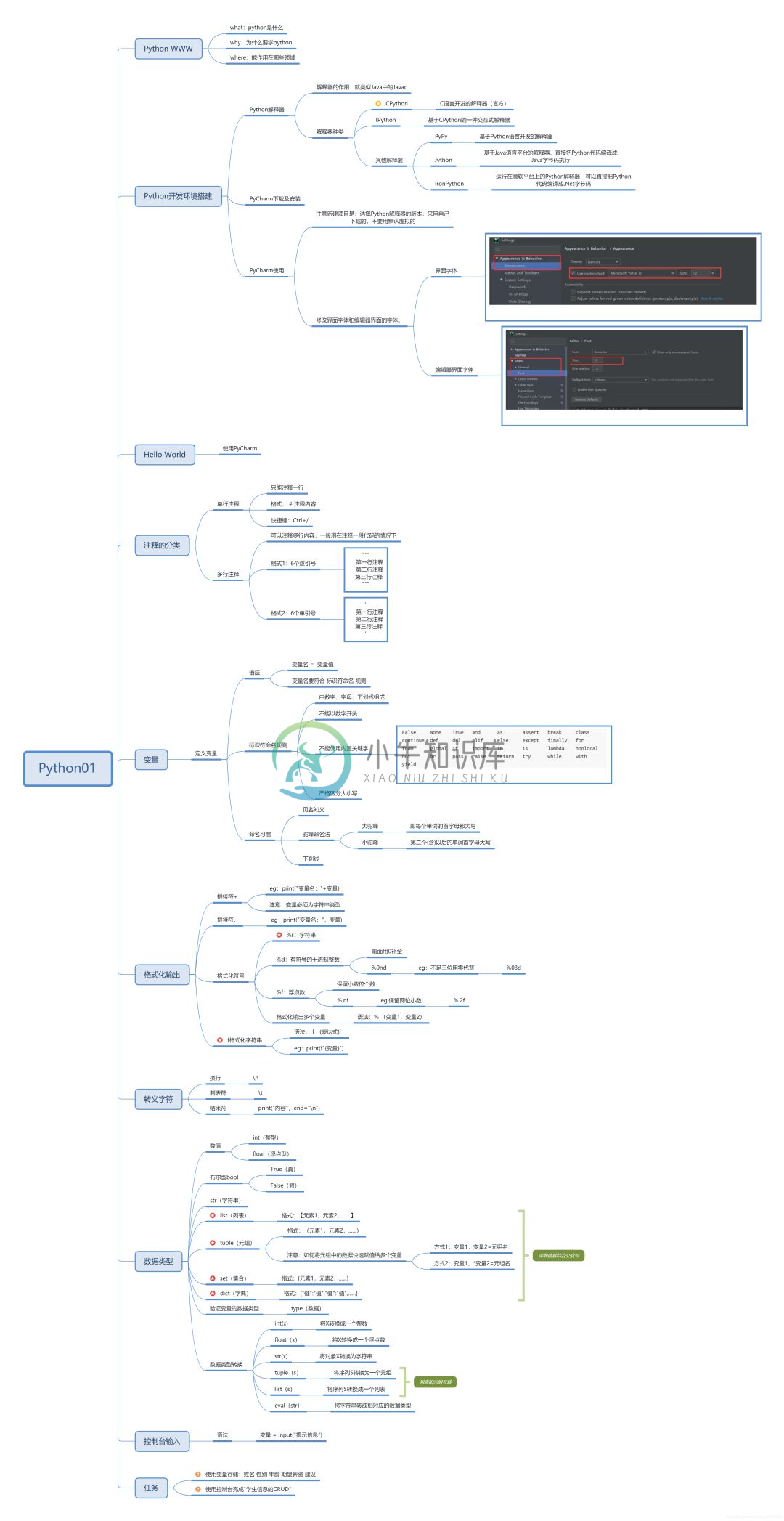

Python:必看学习路线图

Python:必看学习路线图导语:这是我刚开始学习python时的一套学习路线,从入门到上手。一、Python入门、环境搭建、变量、数据类型二、Python运算符、条件结构、循环结构三、Python函数四、做一次综合练习,做一个控制台的员工管理"""需求:员工管理系统功能:1.添加员工信息2.删除员工信息3.修改员工信息4.查看单个员工信息5.查看所有员工信息6.退出技术:函数、数据类型(字典列表)、循环、条件语句

-

机器学习:聚类分析

监督学习使用标记数据对 (x,y) 学习函数:X\rightarrow Y 。但是,如果我们没有标签呢?这类没有标签的学习方式被称为无监督学习。 无监督学习:如果训练样本全部无标签,则是无监督学习。例如聚类算法,就是根据样本间的相似性对样本集进行聚类试图使类内差距最小化,类间差距最大化。 主要用途: 自动组织数据。 理解某些数据中的隐藏结构。 在低维空间中表示高维数据。