AWS EMR纱线簇上的Jupyterhub pyspark3

我正在AWS EMRhtml" target="_blank">集群上使用pyspark3内核运行Jupyterhub。正如我们可能知道的那样,EMR上的Jupyterhub pyspark3使用Livy会话在AWS EMR YARN调度程序上运行工作负载。我的问题是关于火花的配置:执行器内存/内核、驱动程序内存/内核等。

配置中已经有默认配置。Jupyter的json文件:

...

"session_configs":{

"executorMemory":"4096M",

"executorCores":2,

"driverCores":2,

"driverMemory":"4096M",

"numExecutors":2

},

...

我们可以改写此配置使用spackMagic:

%%configure -f

{"conf":{"spark.pyspark.python": "python3",

"spark.pyspark.virtualenv.enabled": "true",

"spark.pyspark.virtualenv.type":"native",

"spark.pyspark.virtualenv.bin.path":"/usr/bin/virtualenv",

"spark.executor.memory":"2g",

"spark.driver.memory": "2g",

"spark.executor.cores": "1",

"spark.num.executors": "1",

"spark.driver.maxResultSize": "2g",

"spark.yarn.executor.memoryOverhead": "2g",

"spark.yarn.driver.memoryOverhead": "2g",

"spark.yarn.queue": "default"

}

}

火花默认值中也有配置。EMR集群主节点中的conf文件。

spark.executor.memory 2048M

spark.driver.memory 2048M

spark.yarn.driver.memoryOverhead 409M

spark.executor.cores 2

...

当我启动SparkSession以便在纱线集群中运行spark应用程序时,将使用哪种配置?

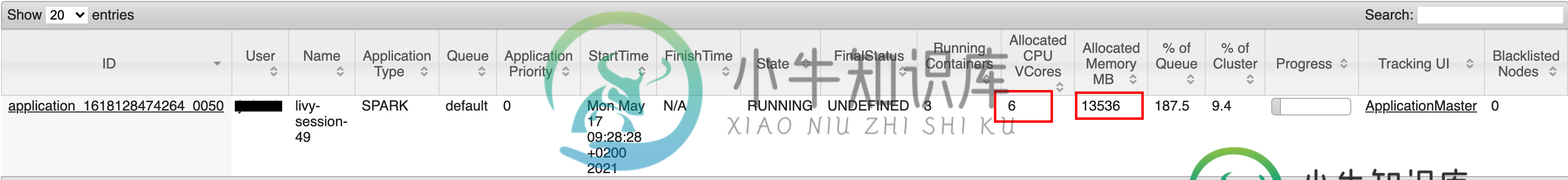

请在YARN Scheduler上找到正在运行的火花应用程序的图像:

共有1个答案

根据我的经验和这个告诉如何修改spark配置的链接,似乎将使用您通过%%configure-f所做的修改(当然,如果您将此作为第一个命令,它将使用此配置启动会话)。

-

我正在使用spark submit执行以下命令: spark submit script\u测试。py—主纱线—部署模式群集spark submit script\u测试。py—主纱线簇—部署模式簇 这工作做得很好。我可以在Spark History Server UI下看到它。但是,我无法在RessourceManager UI(纱线)下看到它。 我感觉我的作业没有发送到集群,但它只在一个节点上

-

我在Cloudera CDH5.3集群上运行Spark,使用YARN作为资源管理器。我正在用Python(PySpark)开发Spark应用程序。 我正在运行一个提交命令,如下所示: 如何确保作业在集群中并行运行?

-

作为Apache Flink的新手,以及流处理框架的一般情况下,我有几个关于它的问题,特别是关于并行性的问题。 首先,这是我的代码: 当我想在集群上运行它时,我运行以下命令: 2.为什么Flink没有为这一步使用所有可能的线程? 我注意到源、窗口和接收器由不同的从服务器处理,但我仍然希望在集群上并行处理。 我在这篇文章中读到:https://stackoverflow.com/a/32329010

-

aws上的3台机器(32个内核和64 GB内存) 我手动安装了带有hdfs和yarn服务的Hadoop2(没有使用EMR)。 机器#1运行hdfs-(NameNode&SeconderyNameNode)和yarn-(resourcemanager),在masters文件中定义 问题是,我认为我做错了,因为这项工作需要相当多的时间,大约一个小时,我认为它不是很优化。 我使用以下命令运行flink:

-

我正面临一个问题,当提交一个火花作业罐子在纱。当我用-master yarn-client提交它时,它工作得很好,并给出了我预期的结果 命令如下所示; ./spark-submit--类main.mainclass--主纱--客户端--驱动程序--内存4G--执行器--内存4G--num-执行器4--执行器-核心2 job.jar其他--选项