Mediabird

集体学习平台

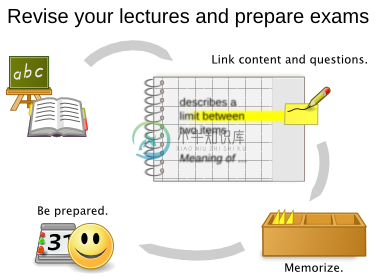

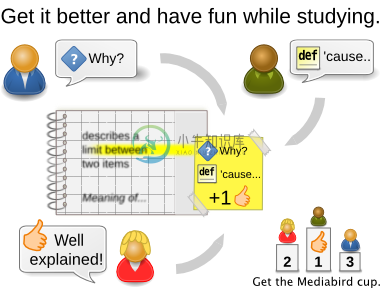

Mediabird 是一个用于集体学习的平台。用户可以对希望学习和讨论问题进行笔记记录。 Mediabird重点关注有关学习过程本身的问题。这样可以为以后重复研究重要的思想过程。也可以联系起来相关的问题,研究问题。这样,其他学生可以识别的问题,使他们的同学更容易在这个平台的帮助下进行学习。

-

“三个臭皮匠顶个诸葛亮”。集成学习就是利用了这样的思想,通过把多分类器组合在一起的方式,构建出一个强分类器;这些被组合的分类器被称为基分类器。事实上,随机森林就属于集成学习的范畴。通常,集成学习具有更强的泛化能力,大量弱分类器的存在降低了分类错误率,也对于数据的噪声有很好的包容性。

-

从下图,我们可以对集成学习的思想做一个概括。对于训练集数据,我们通过训练若干个个体学习器,通过一定的结合策略,就可以最终形成一个强学习器,以达到博采众长的目的。 也就是说,集成学习有两个主要的问题需要解决,第一是如何得到若干个个体学习器,第二是如何选择一种结合策略,将这些个体学习器集合成一个强学习器。 2. 集成学习之个体学习器 上一节我们讲到,集成学习的第一个问题就是如何得到若干个个体学习器。这

-

集成学习基本问题 集成学习的核心是将多个 集成学习的基本思想 结合多个学习器组合成一个性能更好的学习器 集成学习为什么有效? 不同的模型通常会在测试集上产生不同的误差;如果成员的误差是独立的,集成模型将显著地比其成员表现更好。 集成学习的基本策略 Boosting 方法 基于串行策略:基学习器之间存在依赖关系,新的学习器需要根据上一个学习器生成。 基本思路: 先从初始训练集训练一个基学习器;初始训

-

集成学习(ensemble learning)的主要思想是利用一定的手段学习出多个分类器,然后将多个分类器进行组合预测。核心思想就是如何训练处多个弱分类器以及如何将这些弱分类器进行组合。若集成中只包含同种类型的个体学习器,则这样的集成是“同质”的,其个体学习器称为“基学习器”。若包含的是不同类型的个体学习器,则称为“异质”,其基学习器称为“组件学习器”。 集成学习通过将多个学习器进行结合,常可获得

-

平台列表 Google Cloud AI Cloud Machine Learning Engine 托管的机器学习服务 AutoML 自动化机器学习 机器学习API,如 Jobs, Video Intelligence, Vision, Speech, Natual Language 以及 Tanslation 等 Amazon Machine Learning SageMaker 自动化机器学

-

现在要讲的方法可以来整合训练模型的输出。这里要用到偏差-方差(Bias-Variance)分析,以及决策树的样本来探讨一下每一种方法所做的妥协权衡。 要理解为什么从继承方法推导收益函数(benefit),首先会议一些基本的概率论内容。加入我们有n个独立同分布(independent, identically distributed,缩写为i.i.d.) 的随机变量$X_i$,其中的$0\le i<