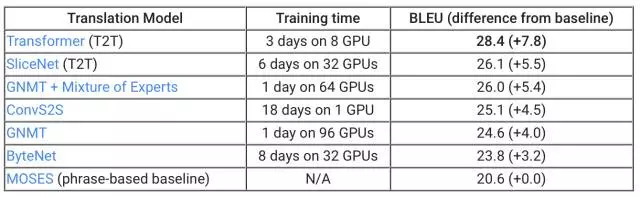

Tensor2Tensor 是一个模块化和可扩展的库和二进制文件,用于在 TensorFlow 中训练深度学习模型,并专注于序列任务。T2T 由 Google Brain 的研究人员和工程师积极使用和维护,力求最大限度地提高思想领域并最大限度地减少执行延迟。

T2T 能够帮助人们为各种机器学习程序创建最先进的模型,可应用于多个领域,如翻译、语法分析、图像信息描述等,大大提高了研究和开发的速度。

-

原文链接:https://cloud.tencent.com/developer/article/1153079 Tensor2Tensor的使用是比较方便的,对于系统中可以支持的问题,直接给系统设置好下面的信息就可以运行了:数据,问题(problem),模型,超参集合,运行设备。这里的实现其实是采用了设计模型中的工厂模式,即给定一个问题名字,返回给相应的处理类;给定一个超参名,返回一套超参的对

-

前言 tensor2tensor(t2t)是google基于tensorflow新开源的深度学习库,该库将深度学习所需要的元素(数据集、模型、学习率、超参数等)封装成标准化的统一接口,在使用其做模型训练时可以更加的灵活。 当前环境 mac 10.13.3 tensorflow 1.6.0 tensor2tensor 1.5.5 安装模块 源码下载:https://github.com/tensor

-

使用tensor2tensor建立decoder报错: 使用tensor2tensor建立decoder报错: ```python # Build RNN cell decoder_cell = tf.nn.rnn_cell.LSTMCell(num_units=self.args.rnn_dim) # Helper

-

tensor2tensor to train all the need is attention model 参数定义: 通过 create_experiment调用train_utils.create_hparams,调用函数problem_hparams.problem_hparams,之后调用transormer,transformer调用common_hparams得到基本的模型参数,并在

-

1. 环境 自定义训练数据训练transformer,实现中文到英文的翻译 环境: tensorflow 1.14 python 3.6.x tensor2tensor 2.自定义数据训练Tensor2Tensor 2.1 自定义一个用户目录(参数--t2t_usr_dir的值) 该目录下主要存放以下文件: (1). 自定义问题文件 (myproblem.py) (2). 创建 __init__.

-

更换tensor2tensor版本(v1.11.0)遇到的问题: 1.No module named 'tensorflow_probability' ------------------------------------分析----------------------------------------------------------- /tensor2tensor/lay

-

tensor2tensor在GTX1650上的安装 如题,在做一个NLP类型的项目,需要用到google公司的tensor2tensor,简称t2t(弱弱吐槽一下t2t的环境有点难搞),于是在自己的笔记本上先尝试了一下t2t的安装 硬件环境 NVIDIA GeForce GTX1650 软件环境 Anaconda(我用的是4.8.3,其实conda版本没多大要求) python3.6(3.7总是报

-

Tensor2Tensor(Transformer)使用方法 安装环境 安装CUDA 9.0 (一定是9.0,不能是9.2) 安装TensorFlow (现在是1.8) 安装Tensor2Tensor 开始使用 数据预处理:这一步骤是根据自己任务自己编写一些预处理的代码,比如字符串格式化,生成特征向量等操作。 编写自定义problem: 编写自定义的problem代码,一定需要在自定义类名前加

-

ImportError: This version of TensorFlow Probability requires TensorFlow version >= 1.13.1; Detected an installation of version 1.12.0. Please upgrade TensorFlow to proceed. 本机使用GTX1080ti 目前Tensorflow稳

-

https://ai.googleblog.com/2017/06/accelerating-deep-learning-research.html https://colab.research.google.com/github/tensorflow/tensor2tensor/blob/master/tensor2tensor/notebooks/hello_t2t.ipynb#scrollT

-

下面列出了要深度掌握Tensor2Tensor系统时,可能因为其实现特点,会遇到的一些问题: 1. 系统支持多任务,任务混杂,导致代码结构比较复杂。在实现的时候,要考虑到整体的结构,所以会存在各种封装、继承、多态的实现。可能你只想用其中的一个功能,理解该功能对应的代码,但是却需要排除掉大量的不相关的代码。 2. 系统基于Tensorflow封装较高的API。使用了Tensorflow中比较

-

本节将讨论优化与深度学习的关系,以及优化在深度学习中的挑战。在一个深度学习问题中,我们通常会预先定义一个损失函数。有了损失函数以后,我们就可以使用优化算法试图将其最小化。在优化中,这样的损失函数通常被称作优化问题的目标函数(objective function)。依据惯例,优化算法通常只考虑最小化目标函数。其实,任何最大化问题都可以很容易地转化为最小化问题,只需令目标函数的相反数为新的目标函数即可

-

主要内容 课程列表 专项课程学习 辅助课程 论文专区 课程列表 课程 机构 参考书 Notes等其他资料 卷积神经网络视觉识别 Stanford 暂无 链接 神经网络 Tweet 暂无 链接 深度学习用于自然语言处理 Stanford 暂无 链接 自然语言处理 Speech and Language Processing 链接 专项课程学习 下述的课程都是公认的最好的在线学习资料,侧重点不同,但推

-

Google Cloud Platform 推出了一个 Learn TensorFlow and deep learning, without a Ph.D. 的教程,介绍了如何基于 Tensorflow 实现 CNN 和 RNN,链接在 这里。 Youtube Slide1 Slide2 Sample Code

-

现在开始学深度学习。在这部分讲义中,我们要简单介绍神经网络,讨论一下向量化以及利用反向传播(backpropagation)来训练神经网络。 1 神经网络(Neural Networks) 我们将慢慢的从一个小问题开始一步一步的构建一个神经网络。回忆一下本课程最开始的时就见到的那个房价预测问题:给定房屋的面积,我们要预测其价格。 在之前的章节中,我们学到的方法是在数据图像中拟合一条直线。现在咱们不

-

深度学习的总体来讲分三层,输入层,隐藏层和输出层。如下图: 但是中间的隐藏层可以是多层,所以叫深度神经网络,中间的隐藏层可以有多种形式,就构成了各种不同的神经网络模型。这部分主要介绍各种常见的神经网络层。在熟悉这些常见的层后,一个神经网络其实就是各种不同层的组合。后边介绍主要基于keras的文档进行组织介绍。

-

Python 是一种通用的高级编程语言,广泛用于数据科学和生成深度学习算法。这个简短的教程介绍了 Python 及其库,如 Numpy,Scipy,Pandas,Matplotlib,像 Theano,TensorFlow,Keras 这样的框架。

-

你拿起这本书的时候,可能已经知道深度学习近年来在人工智能领域所取得的非凡进展。在图像识别和语音转录的任务上,五年前的模型还几乎无法使用,如今的模型的表现已经超越了人类。

-

主要内容:机器学习,深度学习,机器学习与深度学习的区别,机器学习和深度学习的应用人工智能是近几年来最流行的趋势之一。机器学习和深度学习构成了人工智能。下面显示的维恩图解释了机器学习和深度学习的关系 - 机器学习 机器学习是让计算机按照设计和编程的算法行事的科学艺术。许多研究人员认为机器学习是实现人类AI的最佳方式。机器学习包括以下类型的模式 - 监督学习模式 无监督学习模式 深度学习 深度学习是机器学习的一个子领域,其中有关算法的灵感来自大脑的结构和功能,称为人工神经网络。