写在前面:不要找我要训练数据,我是遵纪守法的好公民,训练数据已经删除。

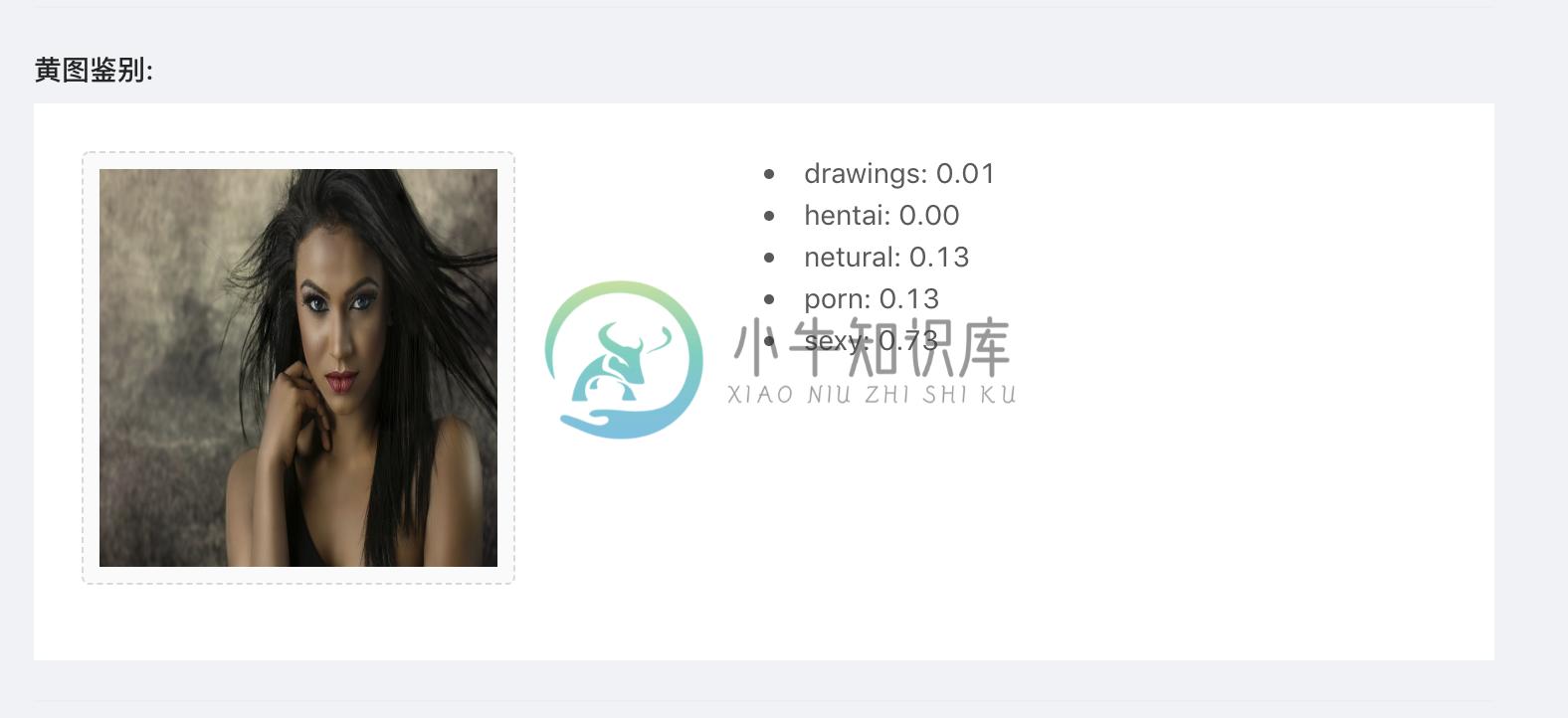

几天前看到 GitHub 上用于黄图鉴别的数据, 就 down 回来做了个黄图鉴别的模型,现模型已开源,在线demo

数据

训练数据共五个类别:

porn - pornography images hentai - hentai images, but also includes pornographic drawings sexy - sexually explicit images, but not pornography. Think nude photos, playboy, bikini, beach volleyball, etc. neutral - safe for work neutral images of everyday things and people drawings - safe for work drawings (including anime)

训练数据的数量如下:

drawing: 18251 hentai: 42649 netural: 44677 porn: 108114 sexy: 17253

使用

可以直接下载代码和训练好的模型来用 下载代码和模型

git clone https://github.com/rockyzhengwu/nsfw.git

训练好的模型在 /data/目录下。

cd nsfw python nsfw_predict.py /tmp/test/test.jpeg

输出结果:

{'class': 'sexy', 'probability': {'drawings': 0.008320281, 'hentai': 0.0011919827, 'neutral': 0.13077603, 'porn': 0.13146976, 'sexy': 0.72824186}}

class: 图片所属列表 probability: 各类别所属的概率得分

也可以使用 Tensorflow Serving 部署,详情可以查看nsfw

模型

模型部分采用 Resnet ,主要参考了 Tensorflow 官方的代码 做了少许修改。详情见 resnet目录下。 尝试了微调和训练一个相对简单的新模型,微调的效果并不好,反而速度会慢很多。我想是因为这些图片和ImageNet 数据集相差太大的缘故。最终发布的模型使用Resnet-32, 准确率 90% 。

如有建议可邮件: zhengwu@midday.me

-

由于业务需要对发布者的头像进行鉴黄风控,使用yahoo 开源的nsfw 模型进行部署上线。前期直接使用github开源的模型open_nsfw,在java上部署,但由于不能满足业务需求,需要对模型进行重新训练。本篇主要是关注tensorflow模型的搭建 1 函数 get_weights 加载模型各层的预训练参数 通过上述开源代码提供的参数open_nsfw-weights.npy,根据每层的na

-

简介 使用雅虎开源的 TensorFlow 2 Open-NSFW 模型,NSFW:not safe for work,工作场所不宜 实践 1.环境准备, Python 3.7 及以上,安装 opennsfw2 库。图片素材请参考 小结中地址进行下载。 pip install opennsfw2 2.代码实践 图片识别 代码如下: import opennsfw2 as n2 # 将自动下载预

-

本篇博文重点介绍 Centos:6.9 Docker部署Caffe, 测试open_nsfw实例, 意在学习caffe的快速安装, 这里以cpu版本的caffe安装为例, 简单应用 open_nsfw 鉴黄库, 当前使用图片和视频的项目越来越多, 在此基础上, 进一步封装可以商用, 节省成本。 1. Docker部署caffe [harry@k8s-master01 open_nsfw]$ doc

-

nsfw Teaching a machine to recognize indecent content wasn’t difficult in retrospect, but it sure was tough the first time through. 回想起来,教一台机器识别不雅内容并不难,但第一次肯定很难。 Here are some lessons learned, and som

-

NSFW Data Scraper 注意:小心使用-数据集有噪音 Description 这是一组脚本,允许自动收集以下(松散定义)类别的上万个图像,稍后用于训练图像分类器: porn-色情图片 hentai-亨泰图片,还包括色情画 sexy-色情图片,但不是色情图片。想想裸照,花花公子,比基尼等等。 neutral-对日常事物和人的中性形象 drawings-安全工作图纸(包括动画) 下面是每个

-

Discriminator 是一种 schema 继承机制。 他允许你在相同的底层 MongoDB collection 上 使用部分重叠的 schema 建立多个 model。 假设你要在单个 collection 中记录多种 event, 每个 event 都有时间戳字段,但是 click 事件还有 URL 字段, 这时你可以用 model.discriminator() 实现上述要求。 此函

-

A Google Chrome/Firefox extension that blocks NSFW images from the web pages that you load using TensorFlowJS. This extension does NOT collect/send any user data. All the operations on the images are

-

问题内容: 是否可以强制休眠将歧视符列用于继承的继承类型?根据JPA2.0规范,这应该可行,但是我无法在休眠状态下实现。 例: 使用hibernate.hbm2ddl.auto create时,这甚至都不会在表PARENT中创建列TYPE。 我知道InheritanceType.JOINED可以在不定义鉴别符列的情况下工作,但是它是非常无效的,因为在使用鉴别符列中的信息时,休眠需要在父对象和所有子

-

本文向大家介绍GO语言利用K近邻算法实现小说鉴黄,包括了GO语言利用K近邻算法实现小说鉴黄的使用技巧和注意事项,需要的朋友参考一下 Usuage: go run kNN.go --file="data.txt" 关键是向量点的选择和阈值的判定 样本数据来自国家新闻出版总署发布通知公布的《40部淫秽色情网络小说名单》 以上所述就是本文的全部内容了,希望大家能够喜欢。

-

在@inheritage类型Joined中 我有班级成员、员工和学生 因此,当我保存Employee或Student记录,然后检索Person记录时,它给我的鉴别器列值为NULL,但在重新启动服务器后,它给我相应的值 如果我手动设置鉴别器列值的值,然后保存和检索,那么它会给我这个值(我需要手动设置鉴别器列值吗?)那么使用鉴别器列有什么好处呢 为什么我不应该使用一个具有列类型的employee和st

-

身份鉴别管理测试包括如下方面: 角色定义测试 (OTG-IDENT-001) 用户注册过程测试 (OTG-IDENT-002) 帐户权限变化测试 (OTG-IDENT-003) 帐户枚举测试 (OTG-IDENT-004) 弱用户名策略测试 (OTG-IDENT-005)