Dejavu 是一个 Python 库,用于音频指纹和识别的算法。Dejavu 听一次音频后就会记录该音频的指纹信息,然后可通过麦克风对输入的音频进行识别是否同一首歌。

-

我在试着让Dejavu来处理覆盆子(覆盆子皮3)。我正在尝试将麦克风输入的音频与mysql数据库中的文件进行匹配。我已经测试过,可以用pyaudio录制,但是我需要设置sample rate=24000&CHUNK=4056。我几乎使用了Dejavu示例附带的默认代码。在 当我运行代码时,我得到以下错误:IOError:[Errno Invalid sample rate]-9997 有人对如何解

-

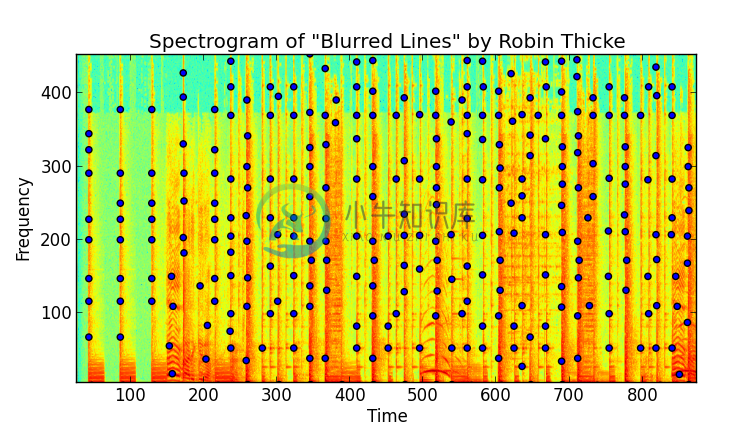

音频识别可以识别出一段未知的音频属于哪个音乐的,从第几秒开始。目前音频识别主要使用音频指纹技术,音频指纹技术通过特定的算法将一段音频中独一无二的数字特征以标识符的形式提取出来,用于识别海量的声音样本或跟踪定位样本在数据库中的位置。其中dejavu是一个非常好的音频指纹的开源项目: 项目地址:https://github.com/worldveil/dejavu dejavu将音频通过FFT(快速傅

-

该错误表现为 Matplotlib 不能显示中文,因为 Matplitlib 默认情况下是不支持中文字体,需要提供 SimHei.ttf 文件。 一、下载SimHei.ttf文件 这里提供下载链接:https://www.uslogger.com/details/3 二、找出Matplotlib存放ttf文件的路径 进入 python 脚本,执行以下操作: >>> import matplotli

-

Introduction Dejavu is a thread-safe Object-Relational Mapper for python application.It 's designed to provide the *Model* third part of an MVC application. When you build an application using dejavu,

-

欢迎关注 『Python』 系列,持续更新中 欢迎关注 『Python』 系列,持续更新中 Chardet字符编码探测器,可以自动检测文本、网页、xml的编码。 colorama主要用来给文本添加各种颜色,并且非常简单易用。 Prettytable主要用于在终端或浏览器端构建格式化的输出。 difflib,[Python]标准库,计算文本差异 Levenshtein,快速计算字符串相似度。 fuz

-

问题 在linux新的python环境,安装了matplotlib,但是使用中文字体时找不到。 问题代码: import matplotlib.pyplot as plt plt.rcParams['font.sans-serif'] = ['SimHei'] # 中文字体设置 报错: findfont: Font family ['sans-serif'] not found. Falli

-

问题内容: 我有一把吉他,我需要我的电脑能够分辨出正在演奏的音符,并识别出音调。可以在python中做到吗,也可以在pygame中做到吗?能够在pygame中做到这一点将非常有帮助。 问题答案: 要识别音频信号的频率,可以使用FFT(快速傅立叶变换)算法。据我所知,PyGame无法记录音频,也不支持FFT转换。 首先,您需要从声卡捕获原始采样数据。这种数据称为PCM(脉冲编码调制)。在Python

-

4.5 系统指纹识别 现在一些便携式计算机操作系统使用指纹识别来验证密码进行登录。指纹识别是识别系统的一个典型模式,包括指纹图像获取、处理、特征提取和对等模块。如果要做渗透测试,需要了解要渗透测试的操作系统的类型才可以。本节将介绍使用Nmap工具测试正在运行的主机的操作系统。 4.5.1 使用Nmap工具识别系统指纹信息 使用Nmap命令的-O选项启用操作系统测试功能。执行命令如下所示: [ema

-

4.6 服务的指纹识别 为了确保有一个成功的渗透测试,必须需要知道目标系统中服务的指纹信息。服务指纹信息包括服务端口、服务名和版本等。在Kali中,可以使用Nmap和Amap工具识别指纹信息。本节将介绍使用Nmap和Amap工具的使用。 4.6.1 使用Nmap工具识别服务指纹信息 使用Nmap工具查看192.168.41.136服务上正在运行的端口。执行命令如下所示: 从输出的信息中可以查看到目

-

我想开发一个模块,它将使用Android中的语音到文本支持。我发现了许多与RecogenerIntent等相关的文档和演示。但我发现所有这些演示都只是在10秒左右的时间里播放声音。但我想让我的演示运行5-10分钟以上。如果不是离线运行,我不会有任何问题,因为我的应用程序总是在线运行。 我也看过Android上的Pocketsphinx,但效果不太好。此外,它只支持Android Studio,而不

-

我在设计一个可以同时录制语音和将语音转换为文本的应用程序时遇到了这个bug。我使用Google API进行语音识别部分,并使用audioRecorder对象进行录音。它没有成功,因此我转而使用onBufferReceived()来检索过程中的字节(当用户说话时)。Google API代码现在是我代码的onResults()部分,它可以在没有UI的情况下进行语音识别。 这是代码

-

我已经搜索了Google的所有可用文档,但我找不到Python音频流上的流式语音识别示例。 目前,我正在Django中使用Python语音识别从用户那里获取音频,然后收听音频。然后,我可以保存文件并运行google语音识别,或者直接从创建的音频实例中运行。 有人能指导我如何对音频流执行流式语音识别吗?

-

问题内容: 整整一整天,我一直在编程领域投入时间来进行指纹匹配/识别算法/实现。尽管有点模糊,因为我似乎找不到任何真正相关的东西。 我基本上是在寻找两件事: 指纹识别:验证图像实际上是一个指纹,因此可以与另一个指纹匹配 指纹匹配:从项目中匹配两个指纹以查看实际是否相等 所有操作都将在图像上完成,因此我与硬件无关。我发现了一些东西,例如Java Fingerprint SDK等,并且在Stackov

-

在页面上添加视频、声音、动画等,可以增强用户体验。在HTML5之前,为网页添加多媒体的唯一办法,就是使用第三方的插件(如,Adobe Flash等)。 HTML5中,提供了对多媒体的原生支持,只需通过 video元素,就可以向网页嵌入视频、电影或音频资源,通过 audio元素向网页嵌入音频资源,省时省力。 视频 早就听说HTML提供了对视频的原生支持,你可能已经迫不及待想体验一下了。 在HTML5