《传音》专题

-

Spring存储过程传递数组

我正在从Spring中调用一个存储过程,但是我需要向存储过程传递一个字符串数组。然而,到目前为止,我遇到了一个又一个错误。你知道哪里出了问题吗? 我尝试运行以下测试。 这是我得到的stacktrace。

-

Android可恢复上传至Google Drive

我正在测试Android的驱动器API,以便上传一个文件,该文件可以显示上传的进度,并能够在失败时恢复上传(文件大小>30 MB) 与以下问题:上传下载的大文件到谷歌驱动器给错误,上传进度监听器没有激发(谷歌驱动器API)我能够得到上传进度,他们提到那些是可恢复的上传。但是,我没有看到任何寻找上传错误和恢复逻辑的代码,因此,如果我杀死应用程序并“恢复”上传,它只是从头开始。

-

用Flask上传和下载文件

我试图用PythonAnywhere和Flask编写一个非常简单的webapp,它允许用户上传文本文件,生成csv文件,然后让用户下载csv文件。不一定要花哨,只要管用就行了。我已经编写了从驱动器上的txt文件生成csv的程序。 现在,我的函数用以下命令打开驱动器上的文件:

-

在scala中传递两列给udf?

我有一个包含两列的数据帧,一列是数据,另一列是该数据字段中的字符计数。 我想根据count列中的值更改列数据的值。如何实现这一点?我尝试使用一个udf: 这似乎是失败的,这是正确的做法吗?

-

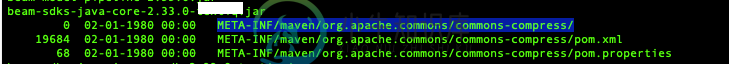

排除渐变传递依赖项

排除渐变传递依赖项我试图从gradle构建中排除嵌套的传递依赖项。依赖结构看起来像 org.apache.beam:beam-sdks-java-core:2.33.0-自定义 我按照gradle exclude的公认解决方案排除了依赖性,但它对我不起作用。 这不排除依赖项。当我将其更改为时,依赖项仍然没有被排除。 关于如何排除这种依赖关系的任何建议?它在旧版本中拉动。

-

代理wso2 esb中的TCP传输

当使用此代码发送soap xml时,我希望通过TCP传输向代理服务发送请求 它工作得很好,我的生意还在继续。 但是当我发送两个xml而不关闭套接字时,如下所示:

-

Firebase云消息传递onLaunch回调

我的应用程序结构有点乱,但我必须先添加这个补丁,然后我会重新构建整个逻辑。问题是我首先检查是否有Firebase用户,然后如果有,我使用StreamBuilder从FiRecovery获取当前用户配置文件,然后我有_firebaseMessaging.configure方法,因为onLaunch和onResume我使用这个回调: 因为我需要将用户发送到这个屏幕,在那里他从Firebase获取消息。

-

修改2解析传出数据

你好StackOverflow的伙计们!这是我的第一个帖子,真的是我的大问题与改造2,我希望一些人帮助解决。 这是我的接口类: 和apimanager类: 我以这种方式使用代码: 最后,我的HttpLoggingInterceptor显示,我在restApi中找不到什么和如何解析它 我找不到从restApi改版2.1.0到restApi的内容,以及哪一部分是我的字符串或图像数据?我确实根据stac

-

Spring WebClient下载和上传文件

我需要创建一个从APIendpoint下载文件并将其上传到另一个APIendpoint的进程。该文件的最大大小为100MB,但我们将有许多进程并行运行。我试图用Spring WebClient实现它,而不需要将文件存储在内存中。当前代码将文件存储在内存中,因为使用大文件的测试会抛出OutofMemoryError。

-

将参数传递到Docker容器

我的输出: 我有损失“!

-

Facebook Graph API视频上传权限

我正在开发一个应用程序,集成W/Facebook发布视频,然后显示在我们的应用程序之外的FB。 我们有一个应用程序的脸书页面,通过FB Graph API(PHP)上传/发布到FB页面的流/时间线/专辑工作得很好,因为它上传视频,将隐私设置为公共,并将一个故事发布到时间线。(我已经通过应用程序的测试用户测试了非页面管理员发帖。一切顺利。) 目前,如果我发布到我自己的个人资料(使用发布请求到/me/

-

如何将Spring Pageable传递给FaignClient

正如我在本期中所写:https://github.com/spring-cloud/spring-cloud-openfeign/issues/375在这个问题上:Spring data Pageable不适用于外部客户端 我在包含@requestbody元素的POST请求中发送可分页对象时遇到一些问题。 首先,我尝试发送嵌入在RequestBody中的Pageable,因为它是在使用spring

-

@主体中的QueryMap传递参数

我有一个简单的POJO: 和一个简单的假冒客户端: 根据拉动请求#667,我期望这被翻译为: 但我得到的是: 请注意,参数在请求主体中传递,而不是作为传递。 它试图调用的endpoint定义为: 我错过了什么?如何使用将其作为查询参数传递?

-

扩展方案 - 通过kafka传输

本节作者:jingbli Kafka 是一个高吞吐量的分布式发布订阅日志服务,具有高可用、高性能、分布式、高扩展、持久性等特性。目前已经在各大公司中广泛使用。和之前采用 Redis 做轻量级消息队列不同,Kafka 利用磁盘作队列,所以也就无所谓消息缓冲时的磁盘问题。此外,如果公司内部已有 Kafka 服务在运行,logstash 也可以快速接入,免去重复建设的麻烦。 如果打算新建 Kafka 系

-

扩展方案 - 通过redis传输

Redis 服务器是 logstash 官方推荐的 broker 选择。Broker 角色也就意味着会同时存在输入和输出俩个插件。 读取 Redis 数据 LogStash::Inputs::Redis 支持三种 data_type(实际上是redis_type),不同的数据类型会导致实际采用不同的 Redis 命令操作: list => BLPOP channel => SUBSCRIBE pa