python根据用户需求输入想爬取的内容及页数爬取图片方法详解

本次小编向大家介绍的是根据用户的需求输入想爬取的内容及页数。

主要步骤:

1.提示用户输入爬取的内容及页码。

2.根据用户输入,获取网址列表。

3.模拟浏览器向服务器发送请求,获取响应。

4.利用xpath方法找到图片的标签。

5.保存数据。

代码用面向过程的形式编写的。

关键字:requests库,xpath,面向过程

现在就来讲解代码书写的过程:

1.导入模块

import parsel # 该模块主要用来将请求后的字符串格式解析成re,xpath,css进行内容的匹配 import requests # 爬虫主要的包 from urllib.request import urlretrieve # 本文用来下载图片 import os # 标准库,本文用来新建文件夹

每个模块的作用都已经备注了。

2.提示用户输入内容和页数

if not os.path.exists("王一博图片"):

os.mkdir("王一博图片") # 判断有没有该文件夹,如果没有就创建改文件夹

k = input("请输入你想搜索的关键字:")

num = int(input("请输入你想搜索的页数:"))

3.准备好url和header

header = {"user-agent":

"Mozilla/5.0 (Linux; Android 6.0; Nexus 5 Build/MRA58N) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/84.0.4147.89 Mobile Safari/537.36"

}

base_url = "https://www.duitang.com/search/?kw=" + k + "&type=feed#!s-p"

title_url = []

n = 0

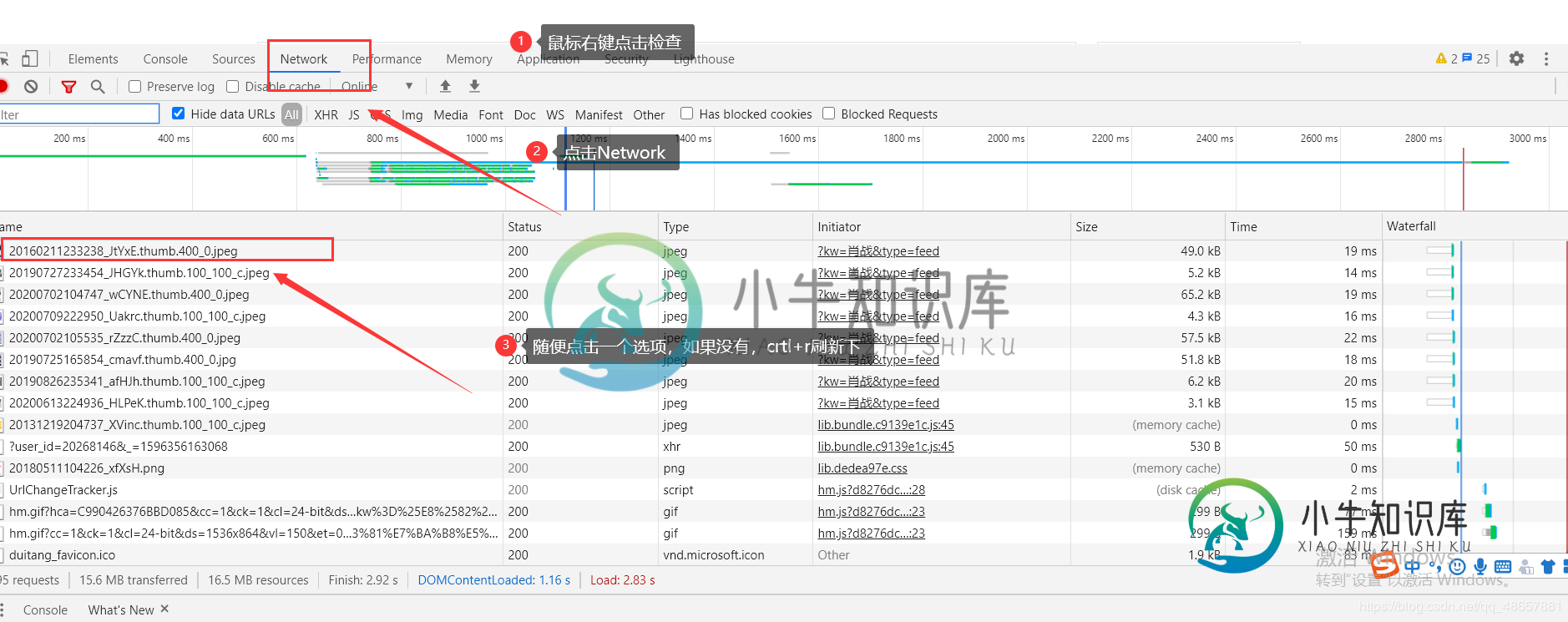

user-agent是服务器识别浏览器的重要参数,我们就用这个来蒙骗服务器,user-agent在浏览器里可以找到

那么现在我们就关注右边

这样header就找到了,注意要以字典的形式

4.发送请求、

for i in range(num): title_url = base_url + str(i) respons = requests.get(title_url, headers=header).text html = parsel.Selector(respons) # 解析数据 -- parsel 转化为Selector对象,Selector对象具有xpath的方法,能够对转化的数据进行处理 pic_url = html.xpath('//div[@class="mbpho"]/a/img/@src').extract()

一切准备就绪后,就可以发送请求了。request.get.text返回的是网页的源代码,然后将源代码转换为Selector对象,再通过xpath的方法找到图片的网址。

xpath的方法可以参考:https://zhuanlan.zhihu.com/p/29436838

5.保存数据

获取图片的图片的链接后,我们就可以保存了。

for url in pic_url:

n = n + 1

file_path = "王一博图片" + '/' + str(n)+".jpg"

urlretrieve(url, file_path) # 下载图片,具体的用法可以去搜索下,很简单的

print("第%d张图片下载成功" % n)

注意:这里的for循环是在上面的循环里嵌套的。

最后来看看全部的代码吧!

import parsel # 该模块主要用来将请求后的字符串格式解析成re,xpath,css进行内容的匹配 import requests from urllib.request import urlretrieve # 本文用来下载图片 import os # 标准库,本文用来新建文件夹 if not os.path.exists("王一博图片"): os.mkdir("王一博图片") # 判断有没有该文件夹,如果没有就创建改文件夹 k = input("请输入你想搜索的关键字:") num = int(input("请输入你想搜索的页数:")) header = {"user-agent": "Mozilla/5.0 (Linux; Android 6.0; Nexus 5 Build/MRA58N) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/84.0.4147.89 Mobile Safari/537.36" } base_url = "https://www.duitang.com/search/?kw=" + k + "&type=feed#!s-p" title_url = [] n = 0 for i in range(num): title_url = base_url + str(i) respons = requests.get(title_url, headers=header).text html = parsel.Selector(respons) pic_url = html.xpath('//div[@class="mbpho"]/a/img/@src').extract() # print(pic_url) for url in pic_url: n = n + 1 file_path = "王一博图片" + '/' + str(n)+".jpg" urlretrieve(url, file_path) # 下载图片,具体的用法可以去搜索下,很简单的 print("第%d张图片下载成功" % n)

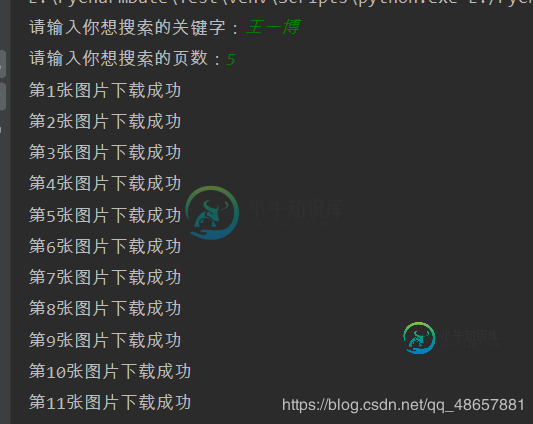

来看看运行的结果,以搜索王一博,搜索5页为例。

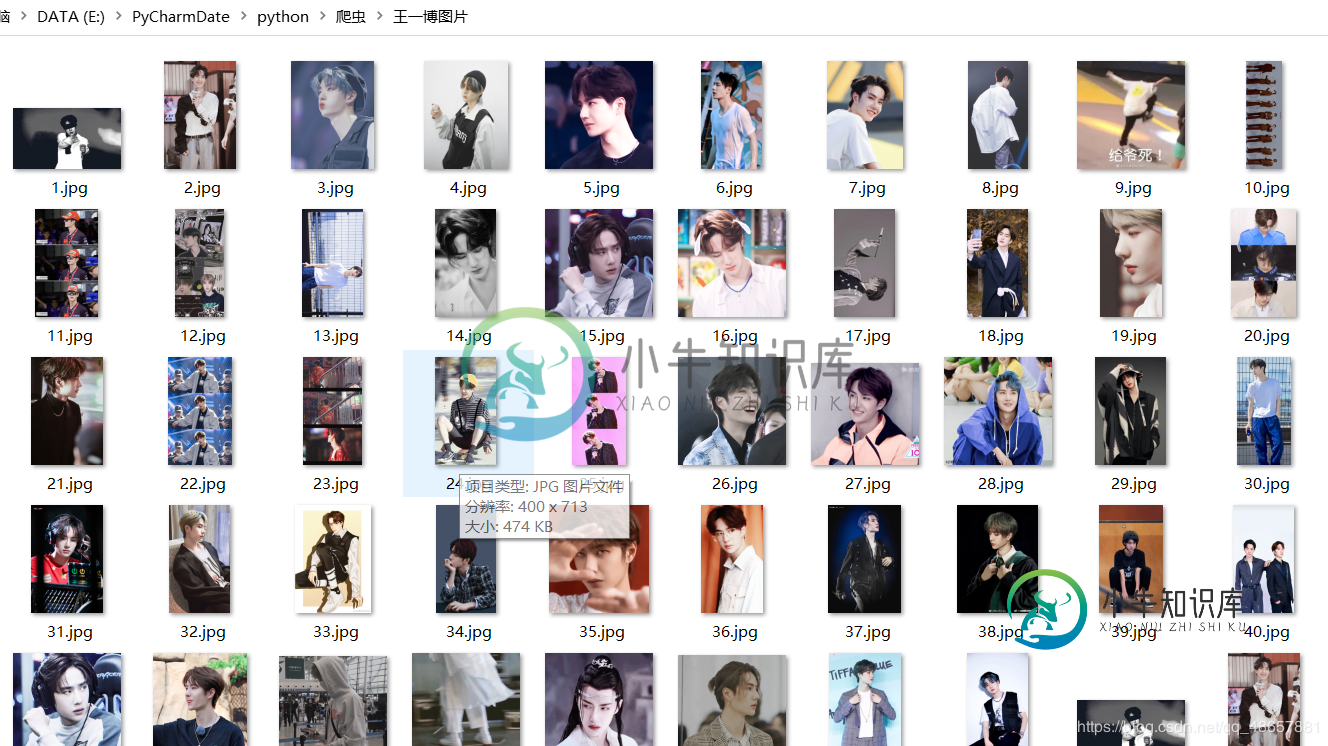

然后你就发信多了一个王一博的文件夹了,点开就可以看见王一博的帅照了。

到此这篇关于python根据用户需求输入想爬取的内容及页数爬取图片方法详解的文章就介绍到这了,更多相关python爬取图片方法内容请搜索小牛知识库以前的文章或继续浏览下面的相关文章希望大家以后多多支持小牛知识库!

-

本文向大家介绍Python使用爬虫爬取静态网页图片的方法详解,包括了Python使用爬虫爬取静态网页图片的方法详解的使用技巧和注意事项,需要的朋友参考一下 本文实例讲述了Python使用爬虫爬取静态网页图片的方法。分享给大家供大家参考,具体如下: 爬虫理论基础 其实爬虫没有大家想象的那么复杂,有时候也就是几行代码的事儿,千万不要把自己吓倒了。这篇就清晰地讲解一下利用Python爬虫的理论基础。 首

-

本文向大家介绍Python爬取网页中的图片(搜狗图片)详解,包括了Python爬取网页中的图片(搜狗图片)详解的使用技巧和注意事项,需要的朋友参考一下 前言 最近几天,研究了一下一直很好奇的爬虫算法。这里写一下最近几天的点点心得。下面进入正文: 你可能需要的工作环境: Python 3.6官网下载 本地下载 我们这里以sogou作为爬取的对象。 首先我们进入搜狗图片http://

-

本文向大家介绍python爬取NUS-WIDE数据库图片,包括了python爬取NUS-WIDE数据库图片的使用技巧和注意事项,需要的朋友参考一下 实验室需要NUS-WIDE数据库中的原图,数据集的地址为http://lms.comp.nus.edu.sg/research/NUS-WIDE.htm 由于这个数据只给了每个图片的URL,所以需要一个小爬虫程序来爬取这些图片。在图片的下载过程中建

-

本文向大家介绍python爬虫爬取网页数据并解析数据,包括了python爬虫爬取网页数据并解析数据的使用技巧和注意事项,需要的朋友参考一下 1.网络爬虫的基本概念 网络爬虫(又称网络蜘蛛,机器人),就是模拟客户端发送网络请求,接收请求响应,一种按照一定的规则,自动地抓取互联网信息的程序。 只要浏览器能够做的事情,原则上,爬虫都能够做到。 2.网络爬虫的功能 网络爬虫可以代替手工做很多事情,比如可以

-

本文向大家介绍易语言爬取网页内容方法,包括了易语言爬取网页内容方法的使用技巧和注意事项,需要的朋友参考一下 写个辅助工具的时候需要提取网页里面的某些内容,我这里便把方法告诉大家,希望对大家有所帮助,记得投票给我哦! 1、在新建的windos窗口程序中画: 两个编辑框、一个按钮。 再添加模块如图中三步! 我们来实现,在一个编辑框中输入网址后,点击按钮,然后取到指定内容到编辑框2中。 2、比如我们来取

-

本文向大家介绍Python大数据之从网页上爬取数据的方法详解,包括了Python大数据之从网页上爬取数据的方法详解的使用技巧和注意事项,需要的朋友参考一下 本文实例讲述了Python大数据之从网页上爬取数据的方法。分享给大家供大家参考,具体如下: myspider.py : items.py : middlewares.py : pipelines.py : settings.py