《字节跳动商业化》专题

-

自定义异常跳过Spring批处理作业无法正常工作

如果Spring批处理作业业务逻辑出现ArrayIndexOutOfBoundsException,我必须从我的自定义映射器FieldSetMapper of reader FlatFileItemReader中跳过一个自定义异常(CSVFieldMappingException)。为此,我添加了作业步骤的配置,如下所示。 但这不起作用,因为每当我抛出自定义RunTimeException时,就会

-

jenkins作业中git-repo的动态选择

在jenkins job中,是否可以有多个git存储库并根据参数动态选择存储库?

-

作业启动网关和持久队列

我向连接到JobLaunchingGateway的spring-integration通道发送一条消息,对于每个消息,JobLaunchingGateway尝试启动一个新的TaskExecutor。 让通道由一个持久队列(例如ActiveMQ)支持,让任务执行器池大小等于2。 我想对系统进行配置,以便当executor池大小已经使用时,新消息不会被JobLaunchingGateway使用,而是保

-

jar cron作业未运行(手动运行)

第一次使用cron作业,我在linux上相对较新,我似乎无法让它工作,如果我只是在命令行中手动运行它,它工作得很好,但不是作为cron作业。 我是这样设置的: 合同-e 插入模式 */3****root(cd/home/ec2 user/;java-jar-feedPuller-1.jar)(每3分钟测试一次) 保存并退出 它说它已经创建了一个新的cron作业选项卡 现在,当我做crontab-l

-

Jenkins节点是否可以优先进行构建作业

问题内容: 我在jenkins中有一组构建作业,可以在3个构建节点中的任何一个中运行。它们都带有通用标签“ ubuntu_build”。每个节点都有许多执行程序,因此允许某些构建在计算机上并行执行。该安装程序运行正常,可以完成预期的工作,但我想对其进行改进。 3个构建节点具有不同的性能。第一个是第二个的两倍,第二个是第三个的两倍。(称它们为fast_node,regular_node,slow_n

-

使用 Groovy 脚本在 Jenkins 从节点中运行作业

我对是否可以在从属节点中使用Groovy脚本运行Jenkins作业感到困惑。我提到了一个 StackOverflow 答案 [1],它说 System Groovy 脚本作业可以在主站而不是从站中运行,并且要在从站中运行作业,它必须是 Groovy 脚本而不是 System Groovy 脚本。有人可以澄清我是否可以使用系统时髦脚本运行从属作业吗?由于我正在尝试通过Groovy脚本,因此无法访问几

-

如何将3个字节(24位)从内存移动到寄存器?

我可以使用MOV指令将存储在内存中的数据项移动到我选择的通用寄存器中。 现在,不要向我开枪,但以下是如何实现的:

-

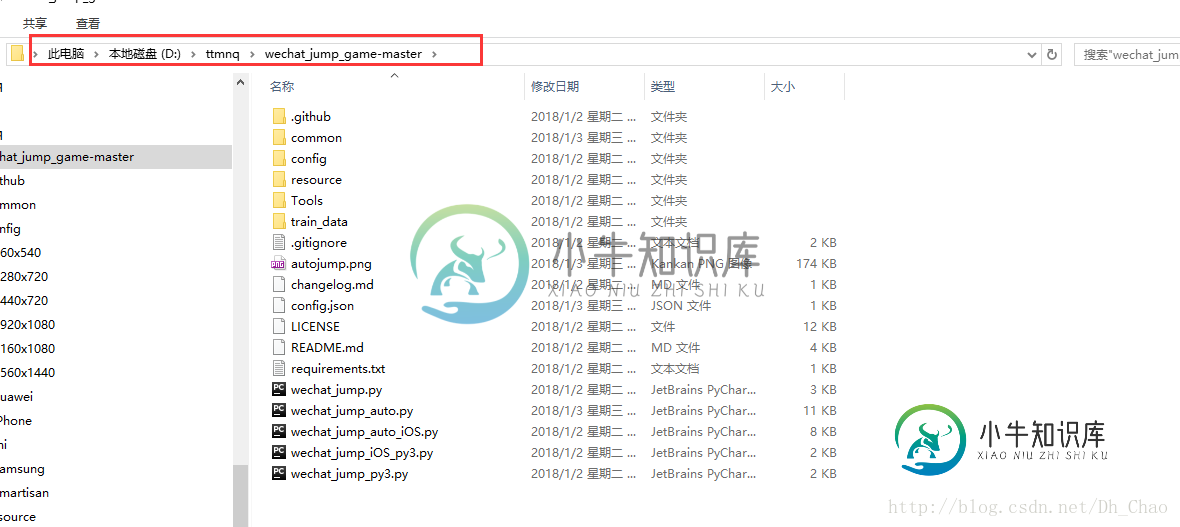

微信小程序跳一跳游戏 python脚本跳一跳刷高分技巧

微信小程序跳一跳游戏 python脚本跳一跳刷高分技巧本文向大家介绍微信小程序跳一跳游戏 python脚本跳一跳刷高分技巧,包括了微信小程序跳一跳游戏 python脚本跳一跳刷高分技巧的使用技巧和注意事项,需要的朋友参考一下 前言 小程序跳一跳最近很火,之前爆出微信游戏小程序漏洞,网上也不乏大神。这里就用一大神的python脚本来刷下高分。 跳一跳python脚本传送门 配置过程 注: 电脑环境未配置python环境,请自行谷歌或者百度配置,这里

-

将Java字符串拆分为1024个字节

问题内容: 在Java中将字符串拆分为1024个字节的块的有效方法是什么?如果有多个块,则需要在所有后续块中重复标头(固定大小的字符串)。 问题答案: 字符串和字节是完全不同的两件事,因此要将字符串拆分为字节与将绘画拆分为经文一样没有意义。 您实际上想做什么? 要在字符串和字节之间进行转换,您需要指定一种编码,该编码可以对String中的所有字符进行编码。根据编码和字符,其中一些可能跨越一个以上的

-

将Java字符串转换为字节数组

问题内容: 我有一个要加密的字节数组,然后转换为字符串,以便可以传输。当我收到字符串时,我必须将字符串转换回字节数组,以便可以对其进行解密。我检查了接收到的字符串是否与发送的字符串(包括长度)匹配,但是当我使用诸如str.getBytes()之类的东西将其转换为字节数组时,它与我的原始字节数组不匹配。 示例输出: 任何想法如何将接收到的字符串转换为与发送的字节数组匹配的字节数组? 谢谢 问题答案:

-

在Go中将字节转换为字符串

问题内容: 我是Go的新手,正在尝试执行以下操作: 我搜索了很多,但真的不知道该怎么做。 我知道这行不通: 问题答案: 这不是实现它的最有效方法,但是您可以简单地编写: 被称为:

-

如何将字节字符串转换为int?

问题内容: 如何在python中将字节字符串转换为int? 这样说: 我想出了一个聪明/愚蠢的方法: 我知道必须有内置的东西或在标准库中可以更简单地执行此操作… 这与转换可以使用int(xxx,16)的十六进制数字字符串不同,但是我想转换一个实际字节值的字符串。 更新: 我有点喜欢James的回答,因为它不需要导入另一个模块,但是Greg的方法更快: 我的骇客方法: 进一步更新: 有人在评论中问导

-

Python:将字符串转换为字节数组

问题内容: 假设我有一个4字符串,并且我想将此字符串转换为字节数组,其中字符串中的每个字符都转换为等效的十六进制。例如 我正在尝试让我的输出成为 有没有简单的方法可以做到这一点? 问题答案: 编码功能可以为您提供帮助,编码返回字符串的编码版本 或者你可以使用数组模块

-

Python 3-编码/解码vs字节/字符串

问题内容: 我是python3的新手,来自python2,并且我对unicode基本概念有些困惑。我读了一些不错的文章,使事情变得更加清楚,但是我看到python 3上有2种方法可以处理编码和解码,而且我不确定要使用哪种方法。 因此,Python 3中的想法是,每个字符串都是unicode,并且可以按字节进行编码和存储,或者可以再次解码回unicode字符串。 但是有两种方法可以做到: 会生成,但

-

字符流与字节流的区别在哪?

字节流与字符流主要的区别是他们的的处理方式字节流是最基本的,采用ASCII编码,所有的InputStream和OutputStream的子类都是,主要用在处理二进制数据,它是按字节来处理的但实际中很多的数据是文本,又提出了字符流的概念,采用Unicode编码.它是按虚拟机的encode来处理