易语言调用接口来实现机器人聊天的功能

常量数据表

.版本 2 .常量 常量1, "<文本长度: 41>", , AI [现行时间]: Hi俺寂寞空虚冷 陪陪俺吧 .常量 常量2, "<文本长度: 25>", , 我 [现行时间]: [内容] .常量 常量3, "<文本长度: 24>", , AI [现行时间]: [内容] .常量 常量4, "<文本长度: 8>", , "text":"

聊天机器人源码

此功能需要加载精易模块

.版本 2 .支持库 EThread .程序集 窗口程序集_启动窗口 .程序集变量 发送, 文本型 .子程序 _发送按钮_被单击 .局部变量 修改, 文本型 修改 = 子文本替换 (#常量2, “[现行时间]”, 到文本 (取现行时间 ()), , , 真) 对话编辑框.加入文本 (#换行符 + 子文本替换 (修改, “[内容]”, 内容编辑框.内容, , , 真)) 发送 = 内容编辑框.内容 发送 = 编码_URL编码 (发送, , 真) 内容编辑框.内容 = “” 启动线程 (&对话, , ) .子程序 __启动窗口_创建完毕 对话编辑框.加入文本 (子文本替换 (#常量1, “[现行时间]”, 到文本 (取现行时间 ()), , , 真)) .子程序 对话 .局部变量 fh, 文本型 fh = 到文本 (网页_访问 (“http://www.tuling123.com/openapi/api?key=a32a544d1cfd3cc1f964f3de6caca9f0&info=” + 发送)) fh = 编码_URL解码 (fh, 真) 加入机器人 (文本_取出中间文本 (fh, #常量4, #引号 + “}”)) .子程序 加入机器人 .参数 内容, 文本型 .局部变量 修改, 文本型 修改 = 子文本替换 (#常量3, “[现行时间]”, 到文本 (取现行时间 ()), , , 真) 对话编辑框.加入文本 (#换行符 + #换行符 + 子文本替换 (修改, “[内容]”, 内容, , , 真)) .子程序 _内容编辑框_按下某键, 逻辑型 .参数 键代码, 整数型 .参数 功能键状态, 整数型 .如果 (键代码 = #回车键) _发送按钮_被单击 () .否则 .如果结束

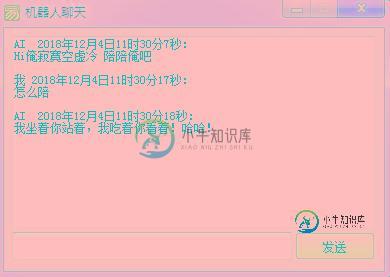

运行结果:

总结

以上就是这篇文章的全部内容了,希望本文的内容对大家的学习或者工作具有一定的参考学习价值,谢谢大家对小牛知识库的支持。如果你想了解更多相关内容请查看下面相关链接

-

本文向大家介绍Python如何实现机器人聊天,包括了Python如何实现机器人聊天的使用技巧和注意事项,需要的朋友参考一下 今天午休的时候,无意之中看了一篇博客,名字叫Python实现机器人,感觉挺有的意思的。 于是用其写了一个简单的Python聊天,源码如下所示: 注意:如果出现某某模块找不到的时候,记得使用pip安装对应的模块。 效果图如下所示: 唯一美中不足的是英文,不过没关系,国内有图灵机

-

本文向大家介绍python 实现语音聊天机器人的示例代码,包括了python 实现语音聊天机器人的示例代码的使用技巧和注意事项,需要的朋友参考一下 前言 在不远的将来,实现一定程度上的语音支持将成为日常科技的基本要求,整合了语音识别的python程序提供了其他技术无法比拟的交互性和可访问性。最重要的是,在python程序中实现语音识别非常简单。整个代码实现下来还不到150行。 原理简介 许多现代语

-

本文向大家介绍基于Vue2实现的仿手机QQ单页面应用功能(接入聊天机器人 ),包括了基于Vue2实现的仿手机QQ单页面应用功能(接入聊天机器人 )的使用技巧和注意事项,需要的朋友参考一下 概述 使用Vue2进行的仿手机QQ的webapp的制作,在ui上,参考了设计师kaokao的作品,作品由个人独立开发,源码中进行了详细的注释。 由于自己也是初学Vue2,所以注释写的不够精简,请见谅。 项目地址

-

本文向大家介绍利用GO语言实现多人聊天室实例教程,包括了利用GO语言实现多人聊天室实例教程的使用技巧和注意事项,需要的朋友参考一下 前言 运用go里面的net包中的相关方法来实现一个基于tcp的简单多人聊天室,用一个服务器来管理,主要反馈客户端是否连接成功并显示客户端输入的内容,并且发送给每一个在服务器上连接的客服端,下面话不多说了,来一起看看详细的介绍吧。 示例代码 服务器代码 本来打算用系统的

-

译者:毛毛虫 作者: Matthew Inkawhich 在本教程中,我们探索了一个好玩和有趣的循环序列到序列的模型用例。我们将用 Cornell Movie-Dialogs Corpus处的电影剧本来训练一个简单的聊天机器人。 在人工智能研究领域中对话模型模型是一个非常热门的话题。聊天机器人可以在各种设置中找到,包括客户服务应用和在线帮助。这些机器人通常由基于检索的模型提供支持,这些输出是某些形

-

seq2seq模型原理 主要参考《Sequence to Sequence Learning with Neural Networks》这篇论文,核心思想如下图: ABC是输入语句,WXYZ是输出语句,EOS是标识一句话结束,图中的训练单元是lstm,lstm的特点是有长短时记忆,所以能够根据输入的多个字来确定后面的多个字,有关lstm的知识可以参考《http://deeplearning.net