如何使用spack-avro包从spack-shell读取avro文件?

我正在尝试使用Apache Avro数据源指南中描述的< code>spark-avro包。

当我提交以下命令时:

val df = spark.read.format("avro").load("~/foo.avro")

我收到一个错误:

java.util.ServiceConfigurationError: org.apache.spark.sql.sources.DataSourceRegister: Provider org.apache.spark.sql.avro.AvroFileFormat could not be instantiated

at java.util.ServiceLoader.fail(ServiceLoader.java:232)

at java.util.ServiceLoader.access$100(ServiceLoader.java:185)

at java.util.ServiceLoader$LazyIterator.nextService(ServiceLoader.java:384)

at java.util.ServiceLoader$LazyIterator.next(ServiceLoader.java:404)

at java.util.ServiceLoader$1.next(ServiceLoader.java:480)

at scala.collection.convert.Wrappers$JIteratorWrapper.next(Wrappers.scala:43)

at scala.collection.Iterator$class.foreach(Iterator.scala:891)

at scala.collection.AbstractIterator.foreach(Iterator.scala:1334)

at scala.collection.IterableLike$class.foreach(IterableLike.scala:72)

at scala.collection.AbstractIterable.foreach(Iterable.scala:54)

at scala.collection.TraversableLike$class.filterImpl(TraversableLike.scala:247)

at scala.collection.TraversableLike$class.filter(TraversableLike.scala:259)

at scala.collection.AbstractTraversable.filter(Traversable.scala:104)

at org.apache.spark.sql.execution.datasources.DataSource$.lookupDataSource(DataSource.scala:630)

at org.apache.spark.sql.DataFrameReader.load(DataFrameReader.scala:194)

at org.apache.spark.sql.DataFrameReader.load(DataFrameReader.scala:178)

... 49 elided

Caused by: java.lang.NoSuchMethodError: org.apache.spark.sql.execution.datasources.FileFormat.$init$(Lorg/apache/spark/sql/execution/datasources/FileFormat;)V

at org.apache.spark.sql.avro.AvroFileFormat.<init>(AvroFileFormat.scala:44)

at sun.reflect.NativeConstructorAccessorImpl.newInstance0(Native Method)

at sun.reflect.NativeConstructorAccessorImpl.newInstance(NativeConstructorAccessorImpl.java:62)

at sun.reflect.DelegatingConstructorAccessorImpl.newInstance(DelegatingConstructorAccessorImpl.java:45)

at java.lang.reflect.Constructor.newInstance(Constructor.java:423)

at java.lang.Class.newInstance(Class.java:442)

at java.util.ServiceLoader$LazyIterator.nextService(ServiceLoader.java:380)

... 62 more

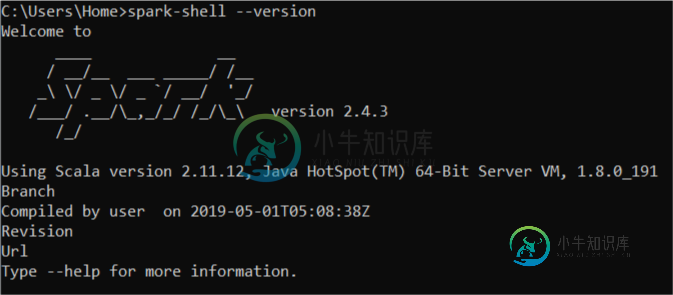

我已经尝试了不同版本的org.apache.spark: Spark-avro_2.12:2.4.0包(2.4.0、2.4.1和2.4.2),我目前使用Spark 2.4.1,但都不工作。

我使用以下命令启动spark shell:

spark-shell --packages org.apache.spark:spark-avro_2.12:2.4.0

共有3个答案

当我遇到同样的问题时,我注意到的另一件事是,它第一次运行良好,之后显示错误。因此,通过向docker文件添加rm命令来清除缓存。对我来说这就足够了。

以防万一,如果有人对pyspark 2.7和spark 2.4.3感兴趣

包装下工程

bin/pyspark --packages org.apache.spark:spark-avro_2.11:2.4.3

TL;dr由于Spark 2.4.x提供了对读写Apache Avro数据的内置支持,但spark-avro模块是外部的,默认情况下不包含在spark-submit或spark-shell中,所以应该确保使用相同的Scala版本(例如2.12),适用于< code>spark-shell和< code> - packages。

出现异常的原因是,您使用的<code>spark shell--packages

使用-包org.apache.spark: spak-avro_2.11:2.4.0,你应该没问题。

-

Spack 是一个 Slackware Linux 和它的衍生品系统的独立软件包生成工具。提供一个简单清晰、安全灵活的制作软件包,减少代码工作量。

-

问题内容: 我正在尝试使用PySpark 2.4.0从Kafka读取avro消息。 spark-avro外部模块可以为读取avro文件提供以下解决方案: 但是,我需要阅读流式Avro消息。库文档建议使用 from_avro() 函数,该函数仅适用于Scala和Java。 是否有其他模块支持读取从Kafka流式传输的Avro消息? 问题答案: 您可以包括spark-avro软件包,例如使用(调整版本

-

我正在从Cloudera包裹中运行带有Spark 0.9.0的CDH 4.4。 我有一堆Avro文件是通过Pig的AvroStorage UDF创建的。我想在 Spark 中加载这些文件,使用通用记录或载入 Avro 文件的架构。到目前为止,我已经尝试过这个: 这适用于一个文件,但它不能扩展——我将所有数据加载到本地RAM中,然后从那里跨spark节点分发。

-

我在一个文件中有一个二进制格式的avro消息。 obj^a^d^vavro.schema∞^b{“type”:“record”,“name”:“rec”,“namespace”:“ns”,“fields”:[{“name”:“id”,“type”:[“int”,“null”]},{“name”:“name”,“type”:[“string”,“null”]},{“name”:“foo_id”,“t

-

我有一个带有日期的简单POJO,在导入Google BigQuery之前,它将作为Avro存储在存储器中。日期转换为long,我试图使用@AvroSchema覆盖日期字段的模式生成,以便BigQuery了解字段的类型。 简单的POJO: 这最终得到以下AVRO-Schema: 这些似乎是错误的,应该是简单的{“name”:“tm”,“type”:“long”,“logicalType”:“time

-

我有一个avro文件,我想在将其转换为代表性对象后读取和操作它 我曾尝试在Java Spark中使用RDD和DataSet加载它,但在这两种情况下,我都无法转换为所需的对象 作为数据集 此操作失败,错误为“bean类中不能有循环引用,但得到了类org.apache.avro.Schema的循环引用” 作为RDD 如何将此RDD对象转换为RDD对象或数据集对象? 我对这个很陌生,所以如果我缺少一些基