Kafka批处理侦听器反序列化消息不正确

我正在使用以下配置的批处理侦听,但我的消息反序列化错误:

@KafkaListener(

id = "${kafka.buyers.product-sales-pricing.id}",

topics = "${kafka.buyers.product-sales-pricing.topic}",

groupId = "${kafka.buyers.group-id}",

concurrency = "${kafka.buyers.concurrency}"

)

public void listen( @Payload List<String> messages,

@Header( KafkaHeaders.RECEIVED_PARTITION_ID ) List<Integer> partitions,

@Header( KafkaHeaders.OFFSET ) List<Long> offsets ) throws IOException

{}

在yml中:

spring:

kafka:

bootstrapServers: localhost:29092

consumer:

enable-auto-commit: false

autoOffsetReset: earliest

keyDeserializer: org.apache.kafka.common.serialization.StringDeserializer

valueDeserializer: org.apache.kafka.common.serialization.StringDeserializer #spring message converter will take care of deserialization

max-poll-records: 5

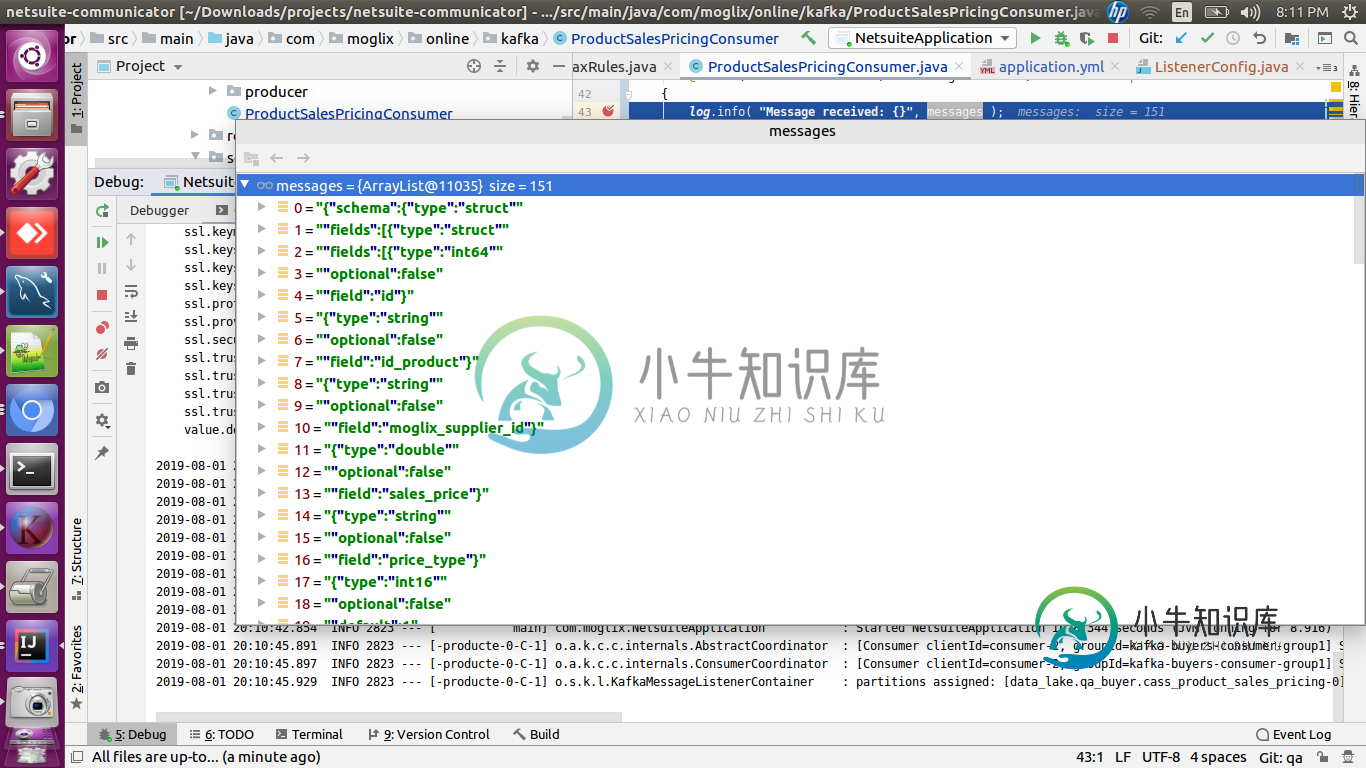

使用上面的方法,我轮询了5条消息,但收到了超过100条消息,当我选中它时,将列表中的一条消息反序列化为多条消息。

我检查了我的投票配置没有工作。有人能给我建议解决办法吗

以下是我的日志:

2019-08-01 20:10:42.777 INFO 2823 --- [ main] o.a.k.clients.consumer.ConsumerConfig : ConsumerConfig values:

auto.commit.interval.ms = 5000

auto.offset.reset = earliest

bootstrap.servers = [localhost:29092]

check.crcs = true

client.id =

connections.max.idle.ms = 540000

default.api.timeout.ms = 60000

enable.auto.commit = false

exclude.internal.topics = true

fetch.max.bytes = 52428800

fetch.max.wait.ms = 500

fetch.min.bytes = 1

group.id = kafka-buyers-consumer-group1

heartbeat.interval.ms = 3000

interceptor.classes = []

internal.leave.group.on.close = true

isolation.level = read_uncommitted

key.deserializer = class org.apache.kafka.common.serialization.StringDeserializer

max.partition.fetch.bytes = 1048576

max.poll.interval.ms = 300000

max.poll.records = 5

metadata.max.age.ms = 300000

metric.reporters = []

metrics.num.samples = 2

metrics.recording.level = INFO

metrics.sample.window.ms = 30000

partition.assignment.strategy = [class org.apache.kafka.clients.consumer.RangeAssignor]

receive.buffer.bytes = 65536

reconnect.backoff.max.ms = 1000

reconnect.backoff.ms = 50

request.timeout.ms = 30000

retry.backoff.ms = 100

sasl.client.callback.handler.class = null

sasl.jaas.config = null

sasl.kerberos.kinit.cmd = /usr/bin/kinit

sasl.kerberos.min.time.before.relogin = 60000

sasl.kerberos.service.name = null

sasl.kerberos.ticket.renew.jitter = 0.05

sasl.kerberos.ticket.renew.window.factor = 0.8

sasl.login.callback.handler.class = null

sasl.login.class = null

sasl.login.refresh.buffer.seconds = 300

sasl.login.refresh.min.period.seconds = 60

sasl.login.refresh.window.factor = 0.8

sasl.login.refresh.window.jitter = 0.05

sasl.mechanism = GSSAPI

security.protocol = PLAINTEXT

send.buffer.bytes = 131072

session.timeout.ms = 10000

ssl.cipher.suites = null

ssl.enabled.protocols = [TLSv1.2, TLSv1.1, TLSv1]

ssl.endpoint.identification.algorithm = https

ssl.key.password = null

ssl.keymanager.algorithm = SunX509

ssl.keystore.location = null

ssl.keystore.password = null

ssl.keystore.type = JKS

ssl.protocol = TLS

ssl.provider = null

ssl.secure.random.implementation = null

ssl.trustmanager.algorithm = PKIX

ssl.truststore.location = null

ssl.truststore.password = null

ssl.truststore.type = JKS

value.deserializer = class org.apache.kafka.common.serialization.StringDeserializer

共有1个答案

在您的情况下,您错过了一个批量监听配置:

spring:

kafka:

listener:

type: BATCH # this configuration is required in spring boot application without this spring boot return single message(without batch)

fetch-min-size: 10 # without this you will get 1 message some time but this is optional in your case.

我敢打赌,在你的问题中,如果你从kafkaListner类中删除List,你的配置将会起作用。

希望这对你有帮助。

-

Spring Kafka批处理消费者只能收到一两条消息,我们已经将fetch.min.bytes增加到9000 即使在增加值后,我们只收到1或2条消息,我们是否还需要增加fetch.min.bytes和fetch.max.wait.ms的值,或者我们是否需要添加任何其他配置,或者我们是否需要减少最大轮询记录大小?在本地环境中,我们收到10条消息,但在AWS MSK集群中,我们收到1或2条消息 消费

-

我试图阅读和打印从Kafka使用Apache Flink的原型消息。 我遵循官方文件,但没有成功:https://nightlies.apache.org/flink/flink-docs-master/docs/dev/datastream/fault-tolerance/serialization/third_party_serializers/ Flink消费者代码是: 反序列化器代码是:

-

我正在实现spring kafka批处理侦听器,它读取来自kafka主题的消息列表,并将数据发布到REST服务。我想了解在REST服务停止的情况下的偏移管理,不应该提交批处理的偏移,应该为下一次轮询处理消息。我已经阅读了spring kafka文档,但在理解侦听器错误处理程序和批量查找当前容器错误处理程序之间的区别时存在困惑。我使用的是spring-boot-2.0.0。M7及以下版本是我的代码。

-

我正在使用 发送和 对于现在从rappid mq接收消息,我希望使用类似以下内容的侦听器: 问题是onMessage监听器与Messages一起工作是否有可能在类似的函数中接收简单的可序列化对象?

-

主要目标是聚合两个Kafka主题,一个压缩慢速移动数据,另一个每秒接收一次的快速移动数据。 我已经能够在简单的场景中使用消息,例如KV(Long, String),使用如下内容: 但是,当您需要从 AVRO 反序列化时,这似乎不是方法。我有一个KV(字符串,AVRO),我需要消费。 我尝试从AVRO模式生成Java类,然后将它们包含在“应用”中,例如: 但这似乎不是正确的方法。 是否有任何文档/示

-

null null