如何打开Objective C(iOS)中的安装语音设置页

我希望我的定制应用程序能够打开iOS原生设置页面,特别是安装新的声音到您的设备的设置。

我如何在目标C中做到这一点?

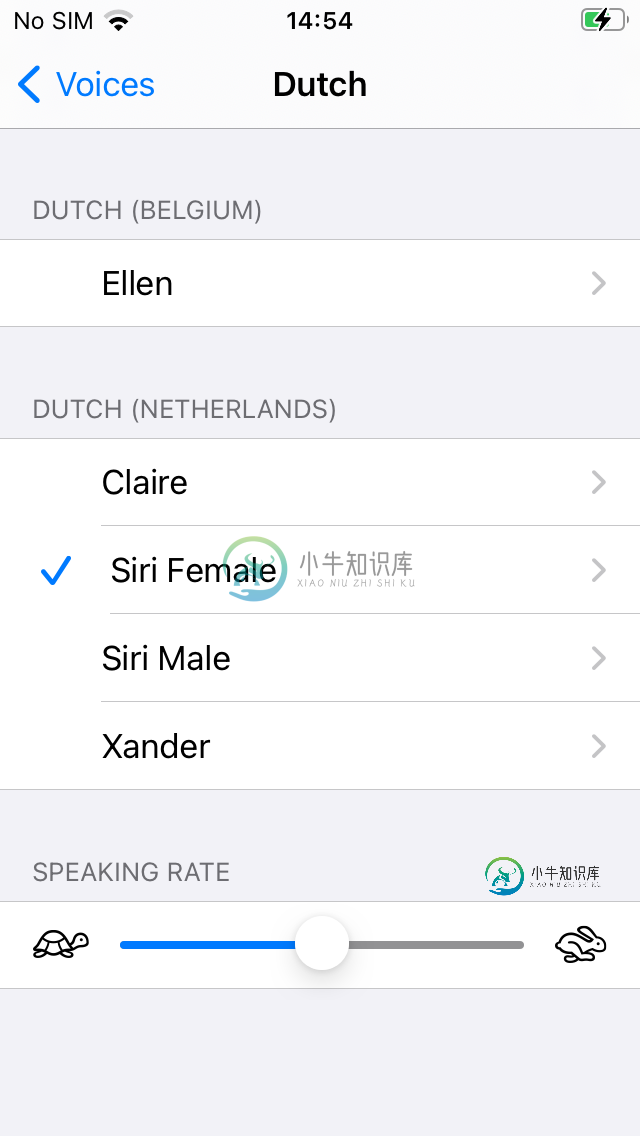

我看到您可以使用UIApplicationOpenSettingsURLString打开设置,但我需要转到用户当前语言的特定安装语音设置页面,该页面如下所示:

此页面位于:设置->辅助功能->口语内容->语音->(您的语言)

进入语音页面,用户必须选择语言也可以。

我想我可以尝试使用open()objective C函数来打开一个自定义URI方案,但是我需要知道我到底需要哪个URI方案。

编辑:这是我当前正在尝试的操作:

NSString *voiceSettings = @"prefs:root=ACCESSIBILITY&path=SPEECH_TITLE#QuickSpeakAccents";

NSString *cleanQuery = [voiceSettings stringByAddingPercentEscapesUsingEncoding:NSUTF8StringEncoding];

[[UIApplication sharedApplication] openURL:[NSURL URLWithString: [NSString stringWithFormat:cleanQuery]] options:@{} completionHandler:nil];

但是,它失败的原因是:

Failed to open URL prefs:root=ACCESSIBILITY&path=SPEECH_TITLE#QuickSpeakAccents: Error Domain=NSOSStatusErrorDomain Code=-10814 "(null)" UserInfo={_LSLine=229, _LSFunction=-[_LSDOpenClient openURL:options:completionHandler:]}

我是不是漏了什么?

共有1个答案

UIApplicationOpenSettingSurlString是打开内置Settings.app的唯一支持方式。任何其他方法都是一个黑客,并且会因为私有API的使用而面临审查被拒绝的风险。

参见例如,使用app-prefs:root是否被认为是私有API?

-

我一直在android中开发语音识别API,发现当语言设置更改时,语音结果会发生变化,有没有办法通过编程进行设置?或者是否打算在语音语言设置屏幕上使用午餐?或者其他什么?注意:我试图使用这个额外的意图: 但这是无效的

-

我有一个在XCode/目标C开发的iOS应用程序。它使用iOS语音应用编程接口来处理连续语音识别。它正在工作,但是我想在语音开始时将麦克风图标变成红色,我还想检测语音何时结束。 我实现了接口SFSpeechRecognitionTaskDelegate,该接口提供了onDetectedSpeechStart和speechRecognitionTask:Did假想Transcription:的回调,

-

如何将音频转录成文本在iOS10使用Speech.framework?

-

我试着用将文本转换为语音,但不起作用。 我正在使用64位Windows7和VisualStudio2010(我想是用.NETFramework 4.0吧?) 该方案: 发生在第

-

主要内容:在 Linux 上安装,在 Mac 上安装,在 Windows 上安装,从源代码安装在你开始使用 Git 前,需要将它安装在你的计算机上。 即便已经安装,最好将它升级到最新的版本。 你可以通过软件包或者其它安装程序来安装,或者下载源码编译安装。 注意: 写本文作时使用的 Git 版本为 2.0.0。 我们使用的大部分命令仍然可以在很古老的 Git 版本上使用,但也有少部分命令不好用或者在旧版本中的行为有差异。 因为 Git 在保持向后兼容方面表现很好,本书使用的这些命令在 2.0

-

完成GitBook的安装只需要几分钟。 GitBook.com GitBook.com为您提供简单高效的图书在线撰写、发布和托管方案, 你可以通过GitBook.com进行在线编辑、或者使用GitBook 本地编辑器在本地电脑上编辑。 本地安装 要求 GitBook的安装非常简单。您的系统只需满足这两个要求: NodeJS(推荐使用v4.0.0及以上版本) Windows,Linux,Unix或M