Kafka消费者无法在偏移提交后读取所有消息(错误=偏移超出范围

我创建了以批处理方式接收消息的ConsumerConfig:

allow.auto.create.topics = false

auto.commit.interval.ms = 5000

auto.offset.reset = latest

bootstrap.servers = [localhost:9092]

check.crcs = true

client.dns.lookup = default

client.id =

client.rack =

connections.max.idle.ms = 540000

default.api.timeout.ms = 60000

enable.auto.commit = false

exclude.internal.topics = true

fetch.max.bytes = 52428800

fetch.max.wait.ms = 500

fetch.min.bytes = 1

group.id = cm-persistence-notification

group.instance.id = null

heartbeat.interval.ms = 3000

interceptor.classes = []

internal.leave.group.on.close = true

isolation.level = read_uncommitted

key.deserializer = class org.apache.kafka.common.serialization.StringDeserializer

max.partition.fetch.bytes = 1048576

max.poll.interval.ms = 300000

max.poll.records = 1000

metadata.max.age.ms = 300000

metric.reporters = []

metrics.num.samples = 2

metrics.recording.level = INFO

metrics.sample.window.ms = 30000

partition.assignment.strategy = [class org.apache.kafka.clients.consumer.RangeAssignor]

receive.buffer.bytes = 65536

reconnect.backoff.max.ms = 1000

reconnect.backoff.ms = 50

request.timeout.ms = 30000

retry.backoff.ms = 100

sasl.client.callback.handler.class = null

sasl.jaas.config = null

sasl.kerberos.kinit.cmd = /usr/bin/kinit

sasl.kerberos.min.time.before.relogin = 60000

sasl.kerberos.service.name = null

sasl.kerberos.ticket.renew.jitter = 0.05

sasl.kerberos.ticket.renew.window.factor = 0.8

sasl.login.callback.handler.class = null

sasl.login.class = null

sasl.login.refresh.buffer.seconds = 300

sasl.login.refresh.min.period.seconds = 60

sasl.login.refresh.window.factor = 0.8

sasl.login.refresh.window.jitter = 0.05

sasl.mechanism = GSSAPI

security.protocol = PLAINTEXT

send.buffer.bytes = 131072

session.timeout.ms = 10000

ssl.cipher.suites = null

ssl.enabled.protocols = [TLSv1.2, TLSv1.1, TLSv1]

ssl.endpoint.identification.algorithm = https

ssl.key.password = null

ssl.keymanager.algorithm = SunX509

ssl.keystore.location = null

ssl.keystore.password = null

ssl.keystore.type = JKS

ssl.protocol = TLS

ssl.provider = null

ssl.secure.random.implementation = null

ssl.trustmanager.algorithm = PKIX

ssl.truststore.location = null

ssl.truststore.password = null

ssl.truststore.type = JKS

value.deserializer = class org.apache.kafka.common.serialization.StringDeserializer

Spring启动配置:

public KafkaListenerContainerFactory<ConcurrentMessageListenerContainer<String, String>> cmPersistenceListenerContainerFactory(

KafkaProperties kafkaProperties )

{

ConcurrentKafkaListenerContainerFactory<String, String> containerFactory =

new ConcurrentKafkaListenerContainerFactory<>();

Map<String, Object> consumerProperties = kafkaProperties.buildConsumerProperties();

consumerProperties.put( ConsumerConfig.MAX_POLL_RECORDS_CONFIG, "1000" );

consumerProperties.put( ConsumerConfig.ENABLE_AUTO_COMMIT_CONFIG, false );

consumerProperties.put( ConsumerConfig.ALLOW_AUTO_CREATE_TOPICS_CONFIG, false );

containerFactory

.setConsumerFactory(

new DefaultKafkaConsumerFactory<>(

consumerProperties, new StringDeserializer(), new StringDeserializer() ) );

containerFactory.setBatchListener( true );

containerFactory.getContainerProperties().setCommitLogLevel(LogIfLevelEnabled.Level.INFO);

containerFactory.getContainerProperties().setAckMode( AckMode.MANUAL_IMMEDIATE );

return containerFactory;

}

@Bean

public KafkaAdmin kafkaAdmin( KafkaProperties kafkaProperties )

{

return new KafkaAdmin( kafkaProperties.buildAdminProperties() );

}

侦听器类 :

@KafkaListener( id = "batch-listener-0", topics = "topic1", groupId = "test", containerFactory = KafkaConsumerConfiguration.CONTAINER_FACTORY_NAME )

public void receive(

@Payload List<String> messages,

@Header( KafkaHeaders.RECEIVED_MESSAGE_KEY ) List<String> keys,

@Header( KafkaHeaders.RECEIVED_PARTITION_ID ) List<Integer> partitions,

@Header( KafkaHeaders.RECEIVED_TOPIC ) List<String> topics,

@Header( KafkaHeaders.OFFSET ) List<Long> offsets,

Acknowledgment ack )

{

long startTime = System.currentTimeMillis();

handleNotifications( messages ); // will take more than 5s to process all messages

long endTime = System.currentTimeMillis();

long timeElapsed = endTime - startTime;

LOGGER.info( "Execution Time :{}", timeElapsed );

ack.acknowledge();

LOGGER.info( "Acknowledgment Success" );

}

我在处理消息后使用手动确认。

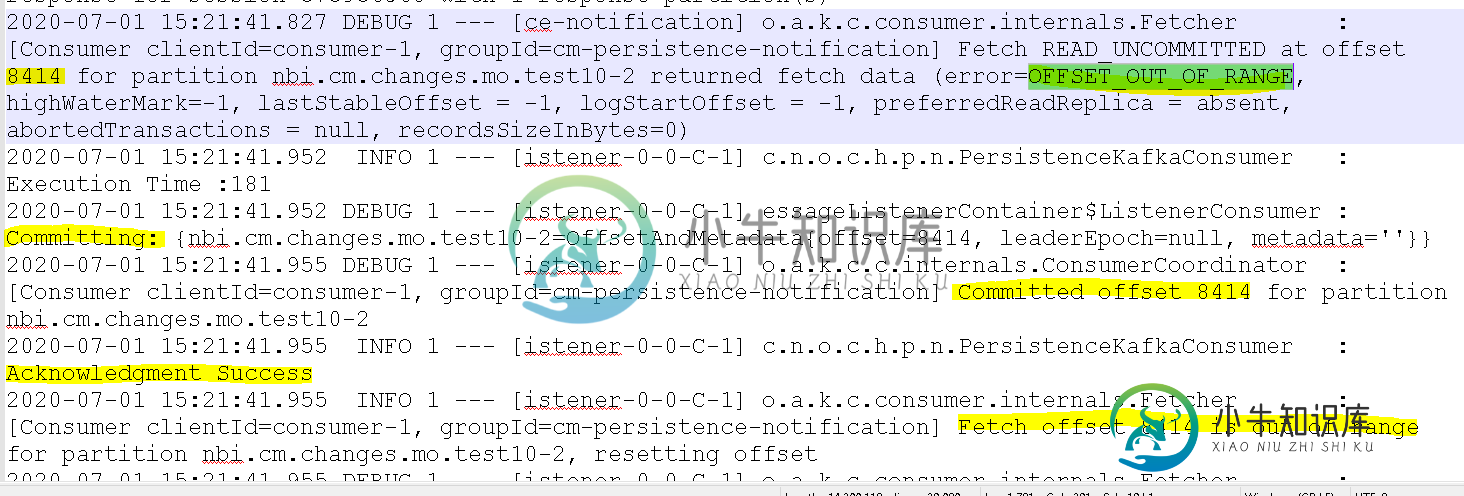

我找到了一些调试日志:

在上面的调试日志中,***获取偏移量发生在偏移量提交之前,该偏移量未提交,因此它返回offset_OUT_OF_RANGE,之后使用者无法接收任何消息。是否有任何方法处理使用者代码中的此错误,或如何仅在提交后获取偏移量****

共有1个答案

得到答案:

分区日志文件在一些之后被删除,但消费者仍在寻找已删除的日志文件,

-

我已经将enable.auto.commit设置为true,并将auto.commit.interval.ms设置为10,000(即10秒)。现在我的问题是--消费者是每个记录的提交偏移量,还是根据10秒内消耗的记录数提交并提前偏移量?

-

我对SpringBoot中的Kafka批处理侦听器有问题。 这是@KafkaListener 对于我的问题,这个解决方案不起作用,因为提交批处理。对于我的解决方案,我需要提交单个消息的偏移量。 我尝试使用

-

null 当侦听器处理记录后返回时提交偏移量。 如果侦听器方法抛出异常,我会认为偏移量不会增加。但是,当我使用下面的code/config/command组合对其进行测试时,情况并非如此。偏移量仍然会得到更新,并且继续处理下一条消息。 我的配置: 验证偏移量的命令: 我使用的是kafka2.12-0.10.2.0和org.springframework.kafka:spring-kafka:1.1

-

我有Kafka流应用程序。我的应用程序正在成功处理事件。 如何使用重新处理/跳过事件所需的偏移量更改Kafka committed consumer offset。我试过如何更改topic?的起始偏移量?。但我得到了“节点不存在”错误。请帮帮我。

-

我是Storm世界的新手。在我的拓扑中,我使用Kafka的数据,并使用。 通过一些测试,我得到了以下警告消息: 2015-10-01 23:31:51.753 s.k.KafkaUtils[警告]获取了偏移量超出范围的获取请求:[85970]2015-10-01 23:31:51.755 s.k.PartitionManager[警告]使用新偏移量:0 我的\\\\\\\\\\\\\\\\\\\\

-

我已经开始让我的制作人向Kafka发送数据,也让我的消费者提取相同的数据。当我在ApacheNIFI中使用ConsumerKafka处理器(kafka版本1.0)时,我脑海中很少有与kafka consumer相关的查询。 Q.1)当我第一次启动ConsumeKafka处理器时,我如何从开始和当前消息中读取消息? 问题2)以及在Kafka消费者关闭的情况下,如何在最后一条消费信息之后阅读信息? 在