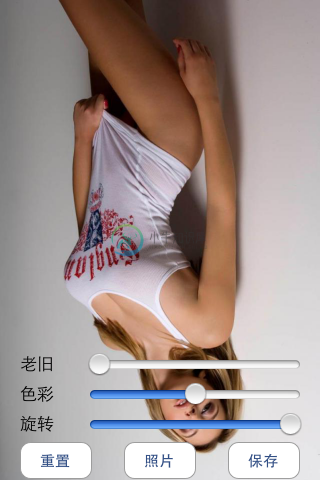

iOS5新增图形处理框架:Core Image。它使我们很容易就能处理图片的各种效果,比如色彩、曝光、饱和度、变形等等。而且可以直接使用GPU,效率奇高。本代码教你如何使用CoreImage框架,并实现了三种常用效果的渲染。 [Code4App.com]

-

文章说明 本系列文章旨在对 Github 上 malin9402 提供的代码进行说明,在这篇文章中,我们会对 YOLOv3 项目中的 image_demo.py 文件进行说明。这个程序的作用是对输入的图片中的内容进行目标检测,并在图上标注检测框。 如果只是想运行 Github 上的代码,可以参考对 YOLOv3 代码的说明一文。 导入需要的库 import cv2 import numpy as

-

Core Image 前言 貌似公司最近的项目都是和图片处理有关,拍拍项目中需要将图片处理成buffer传到图像匹配拼接算法中,需要从原图中抠出一定范围的图像再贴到新的背景图中,需要对静态图片进行滤镜操作等等,所以对这方面接触的相对多一些。 抛开各种各样的图像编解码知识,其实图像数据本身就是一个Byte数组,每一个颜色通道都可以用一个UInt32来表示。我们都知道,拿RGBA图像来说,我们可以用一

-

• CoreImage 是苹果公司为了简化图片处理的难度而开发出来的类库。 • 随着 iOS 版本升级以及硬件性能的不断提升, CoreImage 将支持越来越多的滤镜。 • 大部分的滤镜都很 容易 使用。 // 0. 导入CIImage图片 CIImage *ciImage = [[CIImage alloc] initWithImage:[UIImage imageNamed:@"de

-

Core Image 是 IOS 的图片处理框架,有使用方便、易于管理,性能优异的特点。 用途 在照片、视频处理,把滤镜作为最后一步,添加水印 给照相机提供实时效果 面部检测,自动滤镜增益,图片分析算法 更多 理解Core Image 框架 CIImage 带便图像的对象 CIFilter 表示滤镜,使用key-value coding设置输入值,滤镜强度和输入的CIImage 包含了一个对输入图

-

CoreImage面向App提供了人脸检测相关的API。 CoreImage可以通过hasMouthPosition判断是否出现了嘴巴,hasLeftEyePosition判断是否出现了左眼,hasRightEyePosition判断是否出现了右眼,leftEyeClosed判断左眼是否睁开,rightEyeClosed判断右眼是否睁开。 以下资料是开发者开发的一些demo. 英文网址 https

-

•不同的滤镜可以组合在一起使用。 •可以动态的修改滤镜组合中单个滤镜的参数来实现一种动态调整的效果。 // 0. 导入CIImage图片 CIImage *ciImage = [[CIImage alloc] initWithImage:[UIImage imageNamed:@"demo"]]; // 1. 创建出Filter滤镜 CIFilter *filt

-

1.CoreImage 滤镜的使用(马赛克模糊) CoreImage是苹果公司为了简化图片处理的难度而开发出来的类库。 随着iOS版本升级以及硬件性能的不断提升,CoreImage将支持越来越多的滤镜 - (void)hFilter { // 0. 导入CIImage图片 CIImage *ciImage = [[CIImagealloc] initWithImage:[UIIma

-

昨天转了一篇人脸识别的博客。。 今天试了一下,demo下载地址 http://download.csdn.net/detail/stackhero/4298193