NAudio 是一款开源的用于.NET平台下的音频处理类库。提供了很多的简易方法来操作音频数据。

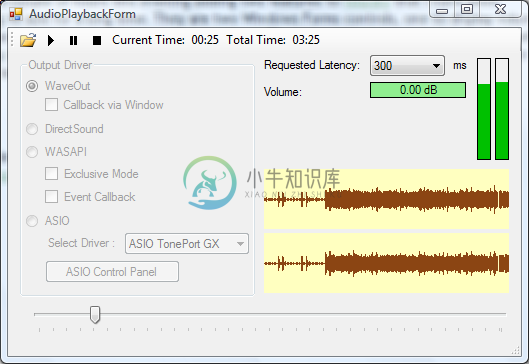

下图是一个用该类库开发的Mp3播放器程序的界面

-

在使用C#进行录音和播放录音功能上,使用NAudio是个不错的选择。 NAudio是个开源,相对功能比较全面的类库,它包含录音、播放录音、格式转换、混音调整等操作,具体可以去Github上看看介绍和源码,附:Git地址 我使用到的是录制和播放wav格式的音频,对应调用NAudio的WaveFileWriter和WaveFileReader类进行开发,从源码上看原理就是 根据上层传入的因

-

官方网站:http://naudio.codeplex.com/ 源码:https://github.com/naudio/NAudio NuGet安装: Install-Package NAudio 目前了解可以做的事情: 1、录音。 2、合并MP3文件。 3、播放MP3文件。 相当网址: WPF使用NAudio录音 - wzwyc - 博客园 http://www.cnblogs.com/

-

NAudio音频相关开发 一个有用的音频和 MIDI 相关类的库,旨在加速音频相关实用程序的开发,例如 .NET 中的录音机或转换器 NAudio 2.1.0 的新功能: 改进了定位,使其更易于在非 Windows 平台上使用 AudioFileReader 将使用 MediaFoundationReader 作为 MP3 的默认值 现在支持的最低 Win 10 版本为 uap

-

帮助文件与示例 https://github.com/naudio/NAudio DEMO文件,源代码 https://markheath.net/category/naudio waveout与waveoutevent区别;触发事件的方式不同:一个是回调式,一个是事件触发式(推荐使用后者代替老方式) 读取wav文件 WaveFileReader 读取mp3文件 mp3FileReader

-

一直做得比较多的是Web,客户端一直接触的比较少,现在因为组内有历史产品是用Winform写的,在开发过程中遇到些坑介绍下。 想看NAudio使用介绍的同学可以直接跳到方案二 应用背景和需求: Winform中嵌套了webbrowser用来显示聊天信息,Winform用计时器主动拉服务器新消息后直接生成html添加到webbrowser。 现在从服务器获取的消息类型中增加了语音类型。语音类型消息为

-

引用库 Install-Package NAudio -Version 1.10.0 直接上代码 百度找解决方案找了3天,花33积分下载号称全网唯一能用的代码也不行。谷歌30分钟解决问题。发现有蛮多朋友需要,所以这里分享一下。 class Program { static void Main(string[] args) { var

-

using NAudio.Wave; using System; using System.Collections.Generic; namespace WinFromBaidu { class NAudioRecorder { #region var /// <summary> /// 录音机对象 /// </s

-

NAudio用法详解(2)Wave方式播放声音 NAudio播放声音有4种方式,分别是: WaveOut; WasapiOut; DirectSoundOut; AsioOut. 本篇介绍WaveOut方式。 Wave方式播放的本质 Wave方式播放最终调用的函数如下。 [DllImport("winmm.dll")] public static extern Mm

-

naudio支持4种输出方式 public const int //DirectX DirectSound = 0, //微软的一种方式 WasapiOut = 1, //默认的设备 WaveOut = 2, //声卡厂商的

-

NAudio用法详解(5)底层库详解_waveInOpen 本篇翻译自以下地址: https://docs.microsoft.com/zh-cn/windows/win32/api/mmeapi/nf-mmeapi-waveinopen 为了便于大家批评指正,原文大部分并未删除。为了简单理解,有些复杂的描述,并未翻译,大部分情况下不影响使用。 方框内的内容为本人额外的补充说明。 上篇中,本人部分

-

NAudio 播放流、字节数组(非wav、mp3、aiff格式) 1. 问题 http或websocket通信返回的音频数据流,导出到音频文件,然后再用AudioFileReader读取文件流,可以播放比较多格式的音频(例如:webm)。但是如果不创建临时文件,改如何直接播放流MemoryStream? 2. 举例 1、返回的音频流是webm时,临时文件法可以正常播放,猜测可以分析读取文件流的方式

-

目前需要用whsiper做语音转录服务,whisper限制25M的大小,请问该如何做这个事情? 目前的需求是 Android iOS Web 都需要这个功能, 目前有几种方案: 方案1 做一个音频分割服务器,然后在做一个转录服务。前端拿到语音文件之后,把语音文件传给音频分割服务器,分割服务器根据波形进行分割,分割完之后传给转录接口。 问题: 这样做的话是不是会造成语音上传多次导致时间较长的问题,因

-

问题内容: 任何人都有关于如何使用Hbase处理非结构化数据(如音频,视频和图像)的想法。我为此做了很多尝试,但我没有任何想法。请提供任何帮助。 问题答案: 选项1:将图像转换为字节数组,您可以准备放置请求并插入到表中。同样,也可以实现音频和视频文件。 参见https://docs.oracle.com/javase/7/docs/api/javax/imageio/package- summar

-

我使用Pocketsphinx的语音识别与西班牙语声学模型和JSGF语法,与体面的结果到目前为止。 然而,我得到了错误的音频识别结果,至少在我看来,这些音频似乎完全可以理解(根据声学模型参数,没有那么多背景噪声、采样频率和比特深度等)。 此外,这些未被正确识别的音频与被正确识别的音频似乎没有太大区别(事实上,我觉得它们听起来几乎一样)。 所以,我猜音频中有什么东西使它更难识别,也许是一些噪声频率或

-

6. 音视频管理 点击开始直播按钮,学员端将看到讲师视频画面,并可参与互动连麦。同时云端将自动录制直播内容。在直播过程中,讲师可参与聊天,管理自己的音视频等。 聊天 参与文字聊天,支持发送本地图片。 摄像头 可切换前置/后置摄像头,或关闭摄像头,此时学员端将无法看到讲师的画面。 麦克风 关闭麦克风,学员端将无法听到讲师的声音。 菜单栏 展开更多功能菜单,包括提取文档、点名签到、课堂设置等。 下课

-

问题内容: 我正在制作音频播放器。它具有暂停,倒带和时间搜索功能。如何以及由谁处理音频元素? 我可以把它放在商店旁边。我不能将其直接放在状态上,因为它可能会被克隆。然后,在减速器中,我可以与其进行交互。问题是,如果我需要将时间滑块与音频同步,则需要使用动作不断地轮询商店。从语义上讲,这也没有任何意义。 我可以创建一个自定义的React组件Audio,它可以完成我所说的一切。问题没有解决。如何刷新滑

-

本文向大家介绍iOS使用音频处理框架The Amazing Audio Engine实现音频录制播放,包括了iOS使用音频处理框架The Amazing Audio Engine实现音频录制播放的使用技巧和注意事项,需要的朋友参考一下 iOS 第三方音频框架The Amazing Audio Engine使用,实现音频录制、播放,可设置配乐。 首先看一下效果图: 下面贴上核心控制器代码: 以上就是

-

音频概述 没有音频的游戏是不完整的,例如背景音乐或音响效果。Unity 的音频系统灵活而强大。它可以导入大多数标准音频文件格式,并且为播放 3D 空间中的声音提供了复杂的功能,以及可选的音响效果,例如回音和过滤。Unity 还可以记录来自用户机器上任意可用麦克风的音频,以便在游戏过程中使用,或者用于存储和传输。 基础理论 在现实生活中,声音由对象发出,并被听众听到。声音被感知的方式取决于许多因素。

-

有人可以请给我一个Android辅助功能服务实时音频处理的示例代码。我需要处理呼叫音频。但不知道如何实现这一点。请分享您对此的看法 请查看以下清单: 请在下面查找可访问性xml: PFB服务: