Java爬虫抓取视频网站下载链接

本篇文章抓取目标网站的链接的基础上,进一步提高难度,抓取目标页面上我们所需要的内容并保存在数据库中。这里的测试案例选用了一个我常用的电影下载网站(http://www.80s.la/)。本来是想抓取网站上的所有电影的下载链接,后来感觉需要的时间太长,因此改成了抓取2015年电影的下载链接。

一 原理简介

其实原理都跟第一篇文章差不多,不同的是鉴于这个网站的分类列表实在太多,如果不对这些标签加以取舍的话,需要花费的时间难以想象。

分类链接和标签链接都不要,不通过这些链接去爬取其他页面,只通过页底的所有类型电影的分页去获取其他页面的电影列表即可。同时,对于电影详情页面,仅仅只是抓取其中的电影标题和迅雷下载链接,并不进行深层次的爬行,详情页面的一些推荐电影等链接通通不要。

最后就是将所有获取到的电影的下载链接保存在videoLinkMap这个集合中,通过遍历这个集合将数据保存到MySQL里

二 代码实现

实现原理已经在上面说了,并且代码中有详细注释,因此这里就不多说了,代码如下:

package action; import java.io.BufferedReader; import java.io.IOException; import java.io.InputStream; import java.io.InputStreamReader; import java.net.HttpURLConnection; import java.net.MalformedURLException; import java.net.URL; import java.sql.Connection; import java.sql.PreparedStatement; import java.sql.SQLException; import java.util.LinkedHashMap; import java.util.Map; import java.util.regex.Matcher; import java.util.regex.Pattern; public class VideoLinkGrab { public static void main(String[] args) { VideoLinkGrab videoLinkGrab = new VideoLinkGrab(); videoLinkGrab.saveData("http://www.80s.la/movie/list/-2015----p"); } /** * 将获取到的数据保存在数据库中 * * @param baseUrl * 爬虫起点 * @return null * */ public void saveData(String baseUrl) { Map<String, Boolean> oldMap = new LinkedHashMap<String, Boolean>(); // 存储链接-是否被遍历 Map<String, String> videoLinkMap = new LinkedHashMap<String, String>(); // 视频下载链接 String oldLinkHost = ""; // host Pattern p = Pattern.compile("(https?://)?[^/\\s]*"); // 比如:http://www.zifangsky.cn Matcher m = p.matcher(baseUrl); if (m.find()) { oldLinkHost = m.group(); } oldMap.put(baseUrl, false); videoLinkMap = crawlLinks(oldLinkHost, oldMap); // 遍历,然后将数据保存在数据库中 try { Connection connection = JDBCDemo.getConnection(); for (Map.Entry<String, String> mapping : videoLinkMap.entrySet()) { PreparedStatement pStatement = connection .prepareStatement("insert into movie(MovieName,MovieLink) values(?,?)"); pStatement.setString(1, mapping.getKey()); pStatement.setString(2, mapping.getValue()); pStatement.executeUpdate(); pStatement.close(); // System.out.println(mapping.getKey() + " : " + mapping.getValue()); } connection.close(); } catch (SQLException e) { e.printStackTrace(); } } /** * 抓取一个网站所有可以抓取的网页链接,在思路上使用了广度优先算法 对未遍历过的新链接不断发起GET请求, 一直到遍历完整个集合都没能发现新的链接 * 则表示不能发现新的链接了,任务结束 * * 对一个链接发起请求时,对该网页用正则查找我们所需要的视频链接,找到后存入集合videoLinkMap * * @param oldLinkHost * 域名,如:http://www.zifangsky.cn * @param oldMap * 待遍历的链接集合 * * @return 返回所有抓取到的视频下载链接集合 * */ private Map<String, String> crawlLinks(String oldLinkHost, Map<String, Boolean> oldMap) { Map<String, Boolean> newMap = new LinkedHashMap<String, Boolean>(); // 每次循环获取到的新链接 Map<String, String> videoLinkMap = new LinkedHashMap<String, String>(); // 视频下载链接 String oldLink = ""; for (Map.Entry<String, Boolean> mapping : oldMap.entrySet()) { // System.out.println("link:" + mapping.getKey() + "--------check:" // + mapping.getValue()); // 如果没有被遍历过 if (!mapping.getValue()) { oldLink = mapping.getKey(); // 发起GET请求 try { URL url = new URL(oldLink); HttpURLConnection connection = (HttpURLConnection) url .openConnection(); connection.setRequestMethod("GET"); connection.setConnectTimeout(2500); connection.setReadTimeout(2500); if (connection.getResponseCode() == 200) { InputStream inputStream = connection.getInputStream(); BufferedReader reader = new BufferedReader( new InputStreamReader(inputStream, "UTF-8")); String line = ""; Pattern pattern = null; Matcher matcher = null; //电影详情页面,取出其中的视频下载链接,不继续深入抓取其他页面 if(isMoviePage(oldLink)){ boolean checkTitle = false; String title = ""; while ((line = reader.readLine()) != null) { //取出页面中的视频标题 if(!checkTitle){ pattern = Pattern.compile("([^\\s]+).*?</title>"); matcher = pattern.matcher(line); if(matcher.find()){ title = matcher.group(1); checkTitle = true; continue; } } // 取出页面中的视频下载链接 pattern = Pattern .compile("(thunder:[^\"]+).*thunder[rR]es[tT]itle=\"[^\"]*\""); matcher = pattern.matcher(line); if (matcher.find()) { videoLinkMap.put(title,matcher.group(1)); System.out.println("视频名称: " + title + " ------ 视频链接:" + matcher.group(1)); break; //当前页面已经检测完毕 } } } //电影列表页面 else if(checkUrl(oldLink)){ while ((line = reader.readLine()) != null) { pattern = Pattern .compile("<a href=\"([^\"\\s]*)\""); matcher = pattern.matcher(line); while (matcher.find()) { String newLink = matcher.group(1).trim(); // 链接 // 判断获取到的链接是否以http开头 if (!newLink.startsWith("http")) { if (newLink.startsWith("/")) newLink = oldLinkHost + newLink; else newLink = oldLinkHost + "/" + newLink; } // 去除链接末尾的 / if (newLink.endsWith("/")) newLink = newLink.substring(0, newLink.length() - 1); // 去重,并且丢弃其他网站的链接 if (!oldMap.containsKey(newLink) && !newMap.containsKey(newLink) && (checkUrl(newLink) || isMoviePage(newLink))) { System.out.println("temp: " + newLink); newMap.put(newLink, false); } } } } reader.close(); inputStream.close(); } connection.disconnect(); } catch (MalformedURLException e) { e.printStackTrace(); } catch (IOException e) { e.printStackTrace(); } try { Thread.sleep(1000); } catch (InterruptedException e) { e.printStackTrace(); } oldMap.replace(oldLink, false, true); } } // 有新链接,继续遍历 if (!newMap.isEmpty()) { oldMap.putAll(newMap); videoLinkMap.putAll(crawlLinks(oldLinkHost, oldMap)); // 由于Map的特性,不会导致出现重复的键值对 } return videoLinkMap; } /** * 判断是否是2015年的电影列表页面 * @param url 待检查URL * @return 状态 * */ public boolean checkUrl(String url){ Pattern pattern = Pattern.compile("http://www.80s.la/movie/list/-2015----p\\d*"); Matcher matcher = pattern.matcher(url); if(matcher.find()) return true; //2015年的列表 else return false; } /** * 判断页面是否是电影详情页面 * @param url 页面链接 * @return 状态 * */ public boolean isMoviePage(String url){ Pattern pattern = Pattern.compile("http://www.80s.la/movie/\\d+"); Matcher matcher = pattern.matcher(url); if(matcher.find()) return true; //电影页面 else return false; } }

注:如果想要实现抓取其他网站的一些指定内容的话,需要将其中的一些正则表达式根据实际情况进行合理修改

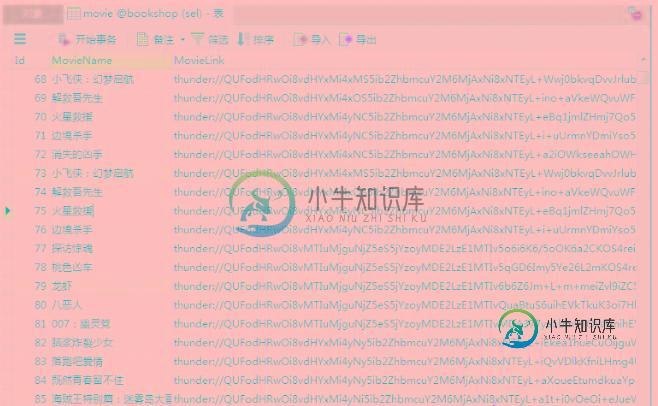

三 测试效果

以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支持小牛知识库。

-

本文向大家介绍使用Python编写简单网络爬虫抓取视频下载资源,包括了使用Python编写简单网络爬虫抓取视频下载资源的使用技巧和注意事项,需要的朋友参考一下 我第一次接触爬虫这东西是在今年的5月份,当时写了一个博客搜索引擎,所用到的爬虫也挺智能的,起码比电影来了这个站用到的爬虫水平高多了! 回到用Python写爬虫的话题。 Python一直是我主要使用的脚本语言,没有之一。Python的语言简洁

-

本文向大家介绍Java爬虫实战抓取一个网站上的全部链接,包括了Java爬虫实战抓取一个网站上的全部链接的使用技巧和注意事项,需要的朋友参考一下 前言:写这篇文章之前,主要是我看了几篇类似的爬虫写法,有的是用的队列来写,感觉不是很直观,还有的只有一个请求然后进行页面解析,根本就没有自动爬起来这也叫爬虫?因此我结合自己的思路写了一下简单的爬虫。 一 算法简介 程序在思路上采用了广度优先算法,对未遍历过

-

主要内容:导入所需模块,拼接URL地址,向URL发送请求,保存为本地文件,函数式编程修改程序本节讲解第一个 Python 爬虫实战案例:抓取您想要的网页,并将其保存至本地计算机。 首先我们对要编写的爬虫程序进行简单地分析,该程序可分为以下三个部分: 拼接 url 地址 发送请求 将照片保存至本地 明确逻辑后,我们就可以正式编写爬虫程序了。 导入所需模块 本节内容使用 urllib 库来编写爬虫,下面导入程序所用模块: 拼接URL地址 定义 URL 变量,拼接 url 地址。代码如下所示:

-

本文向大家介绍Java爬虫 信息抓取的实现,包括了Java爬虫 信息抓取的实现的使用技巧和注意事项,需要的朋友参考一下 今天公司有个需求,需要做一些指定网站查询后的数据的抓取,于是花了点时间写了个demo供演示使用。 思想很简单:就是通过Java访问的链接,然后拿到html字符串,然后就是解析链接等需要的数据。技术上使用Jsoup方便页面的解析,当然Jsoup很方便,也很简单,一行代码就能知道怎么

-

我正在尝试开发一个小的网络爬虫,它下载网页并搜索特定部分的链接。但当我运行这段代码时,“href”标记中的链接会变短。如: 原文链接:“/kids-toys-action-figures-accessories/b/ref=toys_hp_catblock_actnfig?ie=utf8&node=165993011&pf_rd_m=atvpdkikx0der&pf_rd_s=merchandis

-

本文向大家介绍python爬虫线程池案例详解(梨视频短视频爬取),包括了python爬虫线程池案例详解(梨视频短视频爬取)的使用技巧和注意事项,需要的朋友参考一下 python爬虫-梨视频短视频爬取(线程池) 示例代码 知识点扩展: Python爬虫下载视频(梨视频) 梨视频示例:Ctrl+Alt+L格式化代码 到此这篇关于python爬虫线程池案例详解(梨视频短视频爬取)的文章就介绍到这了,更多